Was ist eigentlich ein Large Language Model (LLM)?

Können Maschinen wirklich verstehen, was wir schreiben? Diese Frage führt direkt zum Kern der Large Language Models. Diese Systeme sind die Basis für KI-getriebene Kommunikation. Sie ermöglichen es, neue Texte eigenständig zu generieren, was vor wenigen Jahren noch unmöglich schien.

Large Language Models sind Computerprogramme, die Sprache lernen und verarbeiten. Sie nutzen künstliche Intelligenz, um Texte zu verstehen und neue Inhalte zu erschaffen. OpenAI mit ChatGPT, Google mit Bard und Anthropic mit Claude zeigen, wie weit diese Technologie bereits fortgeschritten ist.

Sie arbeiten mit Milliarden von Datenmustern. Diese Muster ermöglichen es ihnen, Sätze zu vervollständigen, Fragen zu beantworten und komplexe Aufgaben zu bewältigen. Die Grundlage für KI-getriebene Kommunikation stützt sich dabei auf mathematische Konzepte, die wir in diesem Artikel genauer erklären.

Das Besondere an LLMs liegt in ihrer Fähigkeit zur eigenständigen Generierung neuer Texte. Sie lernen nicht auswendig, sondern erkennen Muster und Zusammenhänge. Dadurch entstehen originale Antworten auf Ihre Fragen, obwohl das Modell diese exakte Kombination vorher nie gesehen hat.

In den kommenden Abschnitten führen wir Sie durch die Welt dieser intelligenten Systeme. Wir zeigen Ihnen, wie LLMs entstehen, wie sie funktionieren und wo Sie von ihnen profitieren können. Lassen Sie sich von der Zukunft der Künstlichen Intelligenz inspirieren.

Wichtigste Erkenntnisse

- Large Language Models sind KI-Systeme, die Sprache verstehen und generieren lernen

- Sie bilden eine Grundlage für KI-getriebene Kommunikation in modernen Anwendungen

- Die eigenständige Generierung neuer Texte basiert auf mathematischen Mustern und Milliarden von Parametern

- Bekannte Beispiele sind ChatGPT, Bard und Claude von führenden Technologieunternehmen

- LLMs verändern berufliche Workflows in fast allen Branchen grundlegend

- Ihre Leistung hängt eng mit der Anzahl ihrer Parameter zusammen

- Das Verständnis dieser Technologie wird für berufliche Entwicklung zunehmend wichtig

Was ist eigentlich LLM

Large Language Models, kurz LLMs, verändern, wie wir mit Technologie kommunizieren. Sie sind mehr als nur Programme, die Wörter bearbeiten. Sie verstehen, was wir schreiben, und geben kluge Antworten.

Wir erklären, was diese Technologie so besonders macht. Und warum sie für Geschäftsanwendungen so wichtig ist.

Definition und Grundkonzept

LLMs sind künstliche neuronale Netze, inspiriert vom menschlichen Gehirn. Sie arbeiten mit geschichteten Knoten, ähnlich wie Neuronen. Diese Modelle haben Millionen bis Milliarden von Parametern, die sie während des Trainings lernen.

Diese Parameter dienen als umfassendes Gedächtnis. Sie ermöglichen es dem Modell, komplexe Sprachmuster zu verstehen und anzuwenden.

Was LLMs besonders macht, ist ihre Größe und Vielseitigkeit. Sie lernen aus riesigen Textdatenmengen. So erfassen sie subtile Bedeutungen und Beziehungen zwischen Worten.

Diese Fähigkeit macht sie zu Experten im Natural Language Processing. Sie können menschliche Sprache automatisch verstehen und bearbeiten.

Abgrenzung zu anderen KI-Systemen

Regelbasierte KI-Systeme folgen festen Regeln, die von Menschen geschrieben werden. Machine-Learning-Modelle verbessern sich durch Daten, bleiben aber oft spezialisiert. Large Language Models sind etwas Besonderes:

- Sie können sich auf viele Sprachaufgaben einbringen

- Sie lernen komplexe Sprachmuster aus Daten

- Sie benötigen weniger Spezialisierung für neue Aufgaben

- Sie nutzen Milliarden von Parametern statt weniger hundert

LLMs analysieren nicht nur Texte. Sie können auch kreativ neue Inhalte generieren. Sie schreiben Texte, beantworten Fragen und unterstützen komplexe Denkprozesse.

Diese Fähigkeit macht sie unverzichtbar für moderne Geschäftsanwendungen. Im Gegensatz zu anderen Systemen verstehen LLMs den Sinn hinter Worten. Sie können dieses Verständnis auf neue Situationen übertragen.

Der entscheidende Unterschied liegt in ihrer Größe, Vielseitigkeit und Flexibilität. Sie können mit neuen Herausforderungen umgehen, ohne neu programmiert zu werden. Damit eröffnen sie neue Wege für die digitale Transformation in Ihrem Unternehmen.

Die Entwicklungsgeschichte der Large Language Models

Die Geschichte der Large Language Models beginnt mit großen Schritten in der KI. Wir erklären, wie diese Technologie entstand und sich entwickelte. So verstehen Sie, warum LLMs heute so stark sind.

Ein wichtiger Moment war 2018, als Google BERT einführte. Dieses Modell brachte neue Wege zum Sprachverständnis. Es zeigte, dass man Sprache wirklich verstehen kann, nicht nur Text generieren.

OpenAI entwickelte parallel die GPT-Serie. Von GPT-1 bis GPT-3 im Jahr 2020 gab es große Fortschritte. Jede Version verbesserte sich erheblich.

2022 war ein Wendepunkt. ChatGPT machte LLMs für alle zugänglich. Millionen begannen, mit dieser Technologie zu arbeiten.

Es gab auch Open-Source-Modelle wie BLOOM und LLaMA. Diese Modelle machten KI-Technologie für alle zugänglich.

Andere Länder wie China machten ebenfalls Fortschritte. Modelle wie Qwen und DeepSeek zeigen, dass Spitzenforschung weltweit stattfindet. Das treibt die Branche voran.

| Jahr | Meilenstein | Entwickler | Bedeutung |

|---|---|---|---|

| 2018 | BERT Encoder-Modell | Neue Standards im Sprachverständnis | |

| 2019 | GPT-2 | OpenAI | Verbesserte Textgenerierung |

| 2020 | GPT-3 | OpenAI | Bahnbrechende Leistung und Skalierung |

| 2022 | ChatGPT Start | OpenAI | Wendepunkt für breite Öffentlichkeit |

| 2022 | BLOOM und LLaMA | Hugging Face / Meta | Open-Source-Demokratisierung |

| 2023+ | Qwen und DeepSeek | Alibaba / DeepSeek | Globale Wettbewerbsfähigkeit |

Large Language Models sind nicht über Nacht entstanden. Sie entstanden durch jahrelange Forschung und Verbesserungen. Die Innovation beschleunigt sich weiter.

Wir erleben einen Moment in der Technologiegeschichte. Alte Grenzen fallen. Das eröffnet neue Möglichkeiten in der Arbeit und Karriere.

Wie funktioniert ein Large Language Model

Large Language Models nutzen ein spannendes Prinzip. Es besteht aus drei Schritten. Sie verarbeiten Texteingaben durch spezielle Techniken. So erzeugen sie kohärente und kontextbezogene Ausgaben.

Tokenisierung: Vom Text zum Token

Der erste Schritt ist die Tokenisierung. Wörter werden in kleinere Einheiten zerlegt – sogenannte Tokens. Ein Token kann ein Zeichen, ein Wort oder ein Wortfragment sein.

Die Tokenisierung macht Texte maschinenlesbar. Aktuelle LLMs nutzen intelligente Verfahren statt einfacher Aufteilungen:

- Byte-Pair Encoding (BPE) – Zeichenkombinationen werden zusammengefasst

- Wordpiece – Spezialisiert auf Wort-Untergrenzen

- Unigram – Wahrscheinlichkeitsbasiert

- Sentencepiece – Sprachunabhängig

Diese Methoden finden einen guten Kompromiss zwischen Tokenzahl und semantischem Informationsgehalt.

Embedding: Vom Token zum Vektor

Im zweiten Schritt findet das Embedding statt. Jedes Token wird in einen mathematischen Vektor umgewandelt. Dieser Vektor repräsentiert die Bedeutung des Tokens.

Die Einbettung ermöglicht es, Texten zu arbeiten. Semantisch ähnliche Wörter erhalten ähnliche Vektoren. So versteht das Modell, dass “Hund” und “Welpe” inhaltlich verwandt sind.

| Token | Vektorgröße | Praktische Bedeutung |

|---|---|---|

| “Künstliche” | 768 Dimensionen | Erfasst grammatikalische und semantische Eigenschaften |

| “Intelligenz” | 768 Dimensionen | Repräsentiert technologisches Konzept |

| “Modell” | 768 Dimensionen | Verknüpft mit Systemkontext |

Vorhersage des nächsten Tokens

Der dritte Schritt ist die Berechnung der Wahrscheinlichkeit des nächsten Tokens. Dies ist der Kern der LLMs. Hier findet die eigentliche Generierung statt.

Der Prozess arbeitet so:

- Das Modell analysiert alle bisherigen Tokens

- Es berechnet Wahrscheinlichkeitswerte für alle möglichen Folge-Token

- Eine Strategie zur Auswahl der Ausgabe bestimmt, welches Token gewählt wird

- Dieser Ablauf wiederholt sich, bis die Antwort vollständig ist

Die Strategien zur Auswahl der Ausgabe sind entscheidend. Sie können das wahrscheinlichste Token wählen oder auch kreativere Varianten berücksichtigen. Diese Wiederholung ermöglicht es LLMs, kohärente und kontextbezogene Texte zu erzeugen.

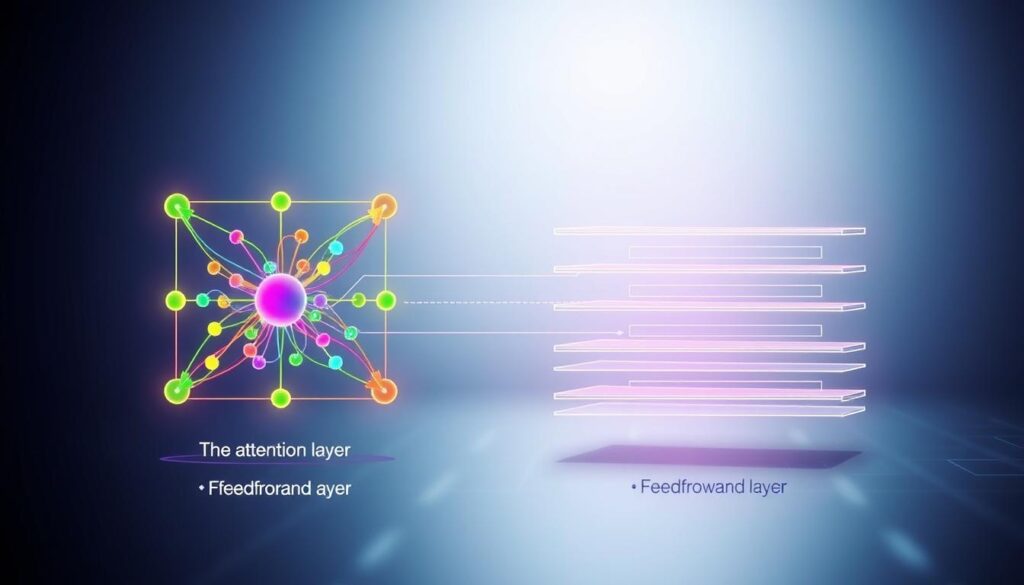

Die Transformer-Architektur als Grundlage

Die Transformer-Architektur ist das Rückgrat moderner Large Language Models. Sie macht es Sprachmodellen leichter, Text zu verarbeiten. Dabei verstehen sie die Beziehungen zwischen Wörtern.

Im Gegensatz zu früheren Modellen können Transformer alle Teile einer Eingabe gleichzeitig betrachten. Das macht sie schneller beim Training.

Sie werden verstehen, warum diese Architektur heute der Standard für LLMs ist. Sie kombiniert mehrere spezialisierter Schichten. So generieren sie präzise Ausgaben.

Selbstaufmerksamkeitsmechanismus

Der Selbstaufmerksamkeitsmechanismus ist das Herzstück eines Transformers. Jedes Token bekommt eine Relevanzsbewertung. Diese sagt aus, wie wichtig es für andere Token im Kontext ist.

Dadurch verstehen die Modelle, welche Wörter zusammenpassen.

Dieser Mechanismus arbeitet in drei Schritten:

- Jeder Token wird in drei Vektoren umgewandelt: Query, Key und Value

- Die Aufmerksamkeitsgewichte werden berechnet, indem Query mit Key multipliziert werden

- Diese Gewichte werden verwendet, um die Value-Vektoren zu kombinieren

So kann die Aufmerksamkeitsebene komplexe Abhängigkeiten zwischen Wörtern erkennen. Das ist unabhängig von ihrer Position im Text.

Neuronale Netzwerkschichten im Detail

Ein Transformer besteht aus mehreren Schichten. Jede Schicht hat spezialisierte Komponenten für unterschiedliche Aufgaben.

| Schichttyp | Funktion | Ausgabe |

|---|---|---|

| Einbettungsebene | Konvertiert Token in semantische Vektoren | Numerische Darstellung der Wortbedeutung |

| Aufmerksamkeitsebene | Bewertet Beziehungen zwischen Token | Kontextuelle Gewichte für jeden Token |

| Feedforward-Ebene | Transformiert Einbettungen in abstrakte Merkmale | Erkannte Muster und höhere Abstraktionen |

| Wiederkehrende Ebene | Verbindet Ausgaben mehrerer Transformer-Blöcke | Verfeinerte Repräsentation des gesamten Textes |

Die Einbettungsebene schafft die Grundlage mit semantischen Vektoren. Die Aufmerksamkeitsebene hilft, sich auf wichtige Teile der Eingabe zu konzentrieren. Die Feedforward-Ebene transformiert diese weiter und erkennt höhere Abstraktionen.

Die wiederkehrende Ebene verbindet diese Komponenten über mehrere Blöcke. So arbeiten sie zusammen, um Kontext zu verstehen und präzise Ausgaben zu erzeugen.

Durch diese mehrschichtige Architektur können Transformer-Modelle effizienter trainiert werden. Das ist anders als frühere Architekturen.

Der Trainingsprozess von LLMs

Das Training von Large Language Models ist systematisch. Es wandelt unstrukturierte Daten in intelligente Sprachverarbeitung um. Zuerst sammelt man Text aus vielen Quellen wie Wikipedia und Webseiten. Diese Daten sind die Basis für das unüberwachte Lernen.

Das Modell entdeckt dabei Sprachmuster und Konzepte selbstständig.

Der technische Ablauf ist klar strukturiert. Zuerst wird Text in Vektoren umgewandelt, die das Modell verarbeiten kann. Dann startet das Modell mit willkürlichen Gewichten, die später optimiert werden.

- Vorhersage des nächsten Wortes basierend auf den bisherigen Eingaben

- Vergleich der Vorhersage mit dem tatsächlichen nächsten Wort

- Berechnung der Vorhersagefehler

- Anpassung aller Modellparameter

Die Einsatz einer Verlustfunktion misst die Differenz zwischen der Modellausgabe und dem echten nächsten Wort. Dies leitet den Lernprozess. Durch die Optimierung der Modellparameter werden die Gewichte angepasst, um genauer vorherzusagen.

Dieser Prozess wiederholt sich über Millionen von Schritten.

| Trainingsphase | Fokus | Datentyp |

|---|---|---|

| Unüberwachtes Lernen | Grundlegende Sprachmuster erkennen | Unstrukturierte Textdaten (Petabytes) |

| Selbstüberwachtes Lernen | Präzisere Konzeptidentifikation | Gekennzeichnete Daten |

| Parameteroptimierung | Genauigkeit maximieren | Numerische Darstellungen |

Die Qualität der Trainingsdaten ist entscheidend. Ungenaue Daten führen zu schlechten Vorhersagen. Beim Einsatz von LLMs in Unternehmen ist das Training sehr wichtig.

Das Modell muss Millionen von Parametern korrekt optimiert haben, um zuverlässig zu funktionieren.

Das Training ist kein einmaliger Prozess. Unternehmen verfeinern trainierte Modelle für spezifische Aufgaben. Dies ist ein Thema, das wir später vertiefen werden.

Die Grundlagen, die Sie hier lernen, sind das Fundament für alle Optimierungen.

Parameter und ihre Bedeutung für die Leistungsfähigkeit

Parameter sind das Herzstück moderner KI-Systeme. Sie sind Variablen im neuronalen Netz, die während des Trainings gelernt werden. Sie repräsentieren das “Wissen” des Modells. Moderne LLMs haben Milliarden solcher Parameter.

GPT-3 zum Beispiel hat 175 Milliarden Parameter. Größere Modelle haben noch mehr. Diese vielen Parameter sind wichtig für die Leistung.

Milliarden von Parametern verstehen

Moderne LLMs haben Milliarden Parameter. GPT-3 hat 175 Milliarden. Größere Modelle haben noch mehr. Diese Zahlen scheinen viel, aber sie sind wichtig.

Warum sind sie wichtig? Mehr Parameter bedeuten, dass das Modell komplexere Muster erkennen kann. Es kann auch nuanciertere Zusammenhänge verstehen.

- Mehr Parameter ermöglichen es dem Modell, komplexere Muster zu erfassen

- Das System kann nuanciertere Zusammenhänge in Texten verstehen

- Die Fähigkeit zur Generalisierung auf neue Aufgaben verbessert sich deutlich

- Subtile sprachliche Nuancen werden besser erkannt und reproduziert

Zusammenhang zwischen Parameterzahl und Modellqualität

Je mehr Parameter ein Modell hat, desto besser ist es. Aber es gibt einen Haken. Der Zusammenhang zwischen Parameterzahl und Modellqualität ist nicht einfach.

Es gibt Skalierungsgesetze. Diese zeigen, wie Modellgröße, Trainingsdaten und Rechenaufwand zusammenhängen. Sie zeigen, dass Sie nicht einfach mehr Parameter hinzufügen können.

| Aspekt | Auswirkung auf Leistung | Ressourcenbedarf |

|---|---|---|

| Parameterzahl erhöhen | Verbesserte Mustererkennung | Deutlich höher |

| Trainingsdaten erweitern | Bessere Generalisierung | Mittelhoch |

| Rechenaufwand optimieren | Effizientere Nutzung | Variabel |

Parameterzahl ist nicht alles. Auch Architektur, Trainingsdaten und Feinabstimmung sind wichtig. Ein Modell mit Milliarden Parametern kann schlecht sein, wenn es schlechte Daten hat.

Diese Erkenntnisse helfen Ihnen, LLM-Angebote besser zu verstehen. Sie können nun entscheiden, welches Modell für Ihre Bedürfnisse am besten passt.

Vortrainierung und Feinabstimmung von Sprachmodellen

Um ein Large Language Model zu entwickeln, müssen mehrere Trainingsphasen durchlaufen werden. Zuerst wird das Modell auf großen Datensätzen trainiert. In dieser Phase lernt es grundlegendes Sprachwissen und allgemeine Zusammenhänge.

Dieser Prozess ist sehr rechenintensiv und kann Wochen oder Monate dauern. Er kostet auch Millionen von Dollar. Das Modell lernt dabei Muster aus Milliarden Wörtern und entwickelt ein tiefes Verständnis für Sprache.

Nach dem Vortraining kommt die zweite Phase: das Instruction Tuning. Hier lernt das Modell, Anweisungen genau zu befolgen und hilfreiche Antworten zu geben. Diese Phase macht das Modell benutzerfreundlicher.

Es wird sicherstellen, dass das System verständlich kommuniziert und zuverlässig reagiert.

Die dritte Phase ist das Fine-Tuning. Hier wird das Modell für spezifische Aufgaben oder Domänen angepasst. So kann es in Ihrem Bereich präzisere Ergebnisse liefern.

| Trainingsphase | Fokus | Dauer | Kosten | Ziel |

|---|---|---|---|---|

| Vortraining (Pre-Training) | Grundlegendes Sprachwissen, allgemeine Zusammenhänge | Wochen bis Monate | Millionen Dollar | Universelles Sprachverständnis |

| Instruction Tuning | Präzises Befolgen von Anweisungen | Tage bis Wochen | Höhere fünfstellig | Benutzerfreundlichkeit |

| Fine-Tuning | Spezifische Aufgaben und Domänen | Stunden bis Tage | Niedrige fünfstellig | Branchenspezifische Optimierung |

Es gibt auch moderne Alternativen zur klassischen Anpassung. Modelle wie GPT-3 und GPT-4 können durch Prompt Engineering angepasst werden. Diese Methode spart Zeit und Ressourcen.

Sie lernen, wann Fine-Tuning sinnvoll ist und wann Prompt Engineering genügt. Dies ist wichtig für die kosteneffiziente Nutzung von LLMs in Ihrem Unternehmen. Berücksichtigen Sie dabei:

- Verfügbarkeit hochwertiger Trainingsdaten für Ihr Fachgebiet

- Budget für Rechenressourcen und Zeit

- Erforderliche Genauigkeit und Spezialisierung

- Häufigkeit von Modell-Updates und Anpassungen

- Sicherheitsanforderungen und Datenschutz

Die richtige Kombination dieser Trainingsphasen macht den Unterschied zwischen einem generischen Modell und einem spezialisierten System. Ihr Verständnis dieser Prozesse hilft Ihnen, fundierte Entscheidungen zu treffen.

Dekodierungsstrategien und Textgenerierung

Wie ein Large Language Model Text erzeugt, hängt von der Dekodierungsstrategie ab. Nach dem Training entscheidet das Modell, welches Token es auswählt. Diese Entscheidung beeinflusst die Qualität und Kreativität der Texte.

Jede Strategie hat ihre Vorteile. Manche sind schnell, andere kreativ. Die richtige Wahl hängt vom Anwendungsfall ab.

Greedy Search und Top-K Sampling

Greedy Search wählt immer das wahrscheinlichste Token. Dieser Prozess ist schnell, aber die Ergebnisse sind oft gleich.

Diese Methode ist gut für Fakten. Aber sie kann zu wiederholten oder vorhersehbaren Texten führen.

Top-K Sampling wählt zufällig aus den k wahrscheinlichsten Token. Dies schafft natürlichere und kreativere Texte. Die Ergebnisse variieren bei jeder Generierung.

- Greedy Search: Deterministisch, schnell, teilweise repetitiv

- Top-K Sampling: Variabel, kreativer, besser für narrative Texte

Beam Search und Contrastive Search

Beam Search verfolgt mehrere Sequenzen parallel. Es bewertet ganze Sequenzen und wählt die wahrscheinlichste aus. Dies ist gut für Übersetzungen und Zusammenfassungen.

Diese Strategie benötigt mehr Zeit, liefert aber bessere Ergebnisse für komplexe Aufgaben.

Contrastive Search wägt Wahrscheinlichkeit und Ähnlichkeit mit dem Kontext ab. Ziel ist es, Wiederholungen zu vermeiden und kohärente Texte zu erzeugen.

| Strategie | Geschwindigkeit | Kreativität | Beste Anwendung |

|---|---|---|---|

| Greedy Search | Sehr schnell | Niedrig | Faktische Antworten, Q&A |

| Top-K Sampling | Schnell | Hoch | Kreative Texte, Storytelling |

| Beam Search | Mittel | Mittel | Übersetzungen, Zusammenfassungen |

| Contrastive Search | Mittel | Hoch | Vielfältige, kohärente Texte |

Die richtige Dekodierungsstrategie verbessert die Ausgabequalität von LLMs. Für Chatbots sind Sampling-Methoden gut. Für technische Dokumentation passt Greedy Search besser.

Verstehen Sie diese Strategien, um LLMs effektiv einzusetzen. So erreichen Sie die besten Ergebnisse für Ihre Bedürfnisse.

Hardware-Anforderungen für den Betrieb von LLMs

Der Betrieb von LLMs braucht viel Daten und teure Grafikprozessoren. Diese spezialisierten Komponenten sind das Herz moderner KI-Systeme. Es ist wichtig, die technischen Anforderungen zu kennen, wenn Sie LLMs in Ihrem Unternehmen nutzen wollen.

Grafikprozessoren (GPUs) sind ideal für die Berechnungen in neuronalen Netzen. Sie können Tausende von Rechenoperationen gleichzeitig durchführen. Das macht sie perfekt für das Training und die Nutzung von Sprachmodellen.

Die wichtigsten Hardware-Hersteller im Überblick

Nvidia führt mit Hopper und Blackwell den Markt an. Diese Technologien bieten die beste Leistung für KI. AMD, Intel und Cerebras bieten Alternativen wie die Instinct-Serie, Gaudi-Plattform und CS-1, CS-2, CS-3.

- Nvidia Hopper und Blackwell – Marktführer mit optimierter Tensor-Performance

- AMD Instinct-Serie – Kosteneffiziente Alternative mit guter Rechenleistung

- Intel Gaudi-Plattform – Spezialisiert auf Trainings- und Inferencing-Aufgaben

- Cerebras CS-1, CS-2 und CS-3 – Innovative Architektur mit großem Speicher auf einem Chip

- Google TPUs – Tensor Processing Units für spezialisierte KI-Workloads

Das Training großer Modelle braucht oft Tausende von GPUs. Dies kann Wochen oder Monate dauern und kostet Millionen. Auch der Betrieb erfordert viel Ressourcen, besonders bei vielen Nutzern.

Wirtschaftliche und geopolitische Dimensionen

Die “Chipkrise” und Exportbeschränkungen beeinflussen die Verfügbarkeit und Kosten. Diese Faktoren beeinflussen Ihre Entscheidungen direkt. Mehr Infos finden Sie in unserem Guide zu Hardware-Realität und was Ihr Rechner leisten kann.

Es kommt auf Ihre Entscheidung an: Betreiben Sie LLMs selbst oder nutzen Sie Cloud-Services? Diese Wahl hängt von Ihren Bedürfnissen, Datenschutz und Budget ab.

| Hardware-Lösung | Trainings-Kapazität | Kosteneffizienz | Verfügbarkeit |

|---|---|---|---|

| Nvidia Hopper/Blackwell | Sehr hoch | Premium | Limitiert |

| AMD Instinct-Serie | Hoch | Moderat | Gut |

| Intel Gaudi-Plattform | Mittel bis hoch | Moderat | Verfügbar |

| Cerebras CS-Serie | Hoch | Premium | Spezialisiert |

| Google TPUs | Sehr hoch | Cloud-basiert | Cloud-abhängig |

Die richtige Hardware-Wahl ist entscheidend für den Erfolg Ihrer KI-Initiative. Planen Sie Ihre Infrastruktur gut und berücksichtigen Sie technische und finanzielle Faktoren.

Multimodale Large Language Models

Die Zukunft der künstlichen Intelligenz liegt in der Fähigkeit, verschiedene Informationsquellen gleichzeitig zu verarbeiten. Multimodale Large Language Models vereinen diese Kraft. Sie können Text, Bilder, Audio und Videos verstehen und miteinander verbinden.

Text ist eine der am häufigsten verwendeten Modalitäten für die Kommunikation mit KI-Systemen. Bilder sind eine wesentliche Quelle visueller Informationen, die mit Convolutional Neural Networks verarbeitet werden. Die Audiomodalität umfasst Informationen aus Sprachaufnahmen. Videos kombinieren visuelle und auditive Informationen in einer einzigen Datenstrom.

Diese Integration ermöglicht völlig neue Anwendungsmöglichkeiten. Ein multimodales System kann ein Bild analysieren und dazu einen passenden Text generieren. Es versteht gesprochene Sprache und reagiert intelligent darauf. Es fasst Videoinhalte zusammen und beantwortet Fragen dazu.

Für Ihr Unternehmen eröffnen sich dadurch beeindruckende Chancen – von der automatischen Produktbeschreibung bis zur intelligenten Videoanalyse.

Integration von Text, Bild und Audio

Die Integration verschiedener Datentypen funktioniert durch spezialisierte Verarbeitungstechniken. Jede Modalität benötigt eigene Verfahren:

- Bilder werden durch Convolutional Neural Networks analysiert

- Sprachaufnahmen nutzen spezialisierte Audioverarbeitungstechniken

- Text wird durch bewährte Token-basierte Methoden verarbeitet

- Videos nutzen sowohl visuelle als auch auditive Verarbeitung gleichzeitig

Diese verschiedenen Datenströme werden anschließend in einer gemeinsamen Repräsentation zusammengeführt. Diese Fusion ermöglicht es dem Modell, Zusammenhänge zwischen Modalitäten zu verstehen und komplexe Aufgaben zu lösen.

BLIP-2 und Vision-Language-Modelle

BLIP-2 verkörpert einen innovativen Ansatz: Bootstrapping Language-Image Pretraining. Dieses Modell kombiniert vortrainierte Vision-Modelle mit Sprachmodellen sehr effizient. Die meisten modernen Vision-Language-Modelle benötigen während des Trainings einen hohen Rechenaufwand.

Um die Kosten zu senken, bleiben die unimodalen vortrainierten Modelle während des Vortrainings eingefroren. Nur die Verbindungsschicht wird trainiert – das spart enorme Ressourcen.

BLIP-2 ist ein Beispiel für Bootstrapping Language-Image Pretraining, das zeigt, wie intelligent Design Trainingskosten reduziert. Ähnliche Vision-Language-Modelle wie CLIP verstehen Text und Bilder gemeinsam. Sie ermöglichen:

- Automatische Bildbeschreibungen in mehreren Sprachen

- Visuelle Frage-Antwort-Systeme

- Intelligente Bildsuche mit natürlicher Sprache

- Erstellung von Bildern aus Textbeschreibungen

Diese multimodalen Fähigkeiten transformieren die Art, wie Unternehmen mit Daten arbeiten. Sie ermöglichen völlig neue Geschäftsmodelle und Kundenerfahrungen.

Bekannte LLM-Implementierungen und Anbieter

Der Markt für Large Language Models wächst schnell. Es gibt viele Anbieter, von etablierten bis zu neuen. Jeder bietet spezielle Stärken. Wir helfen Ihnen, die beste Wahl zu treffen.

OpenAI führt mit der GPT-Serie. ChatGPT hat 2022 die künstliche Intelligenz neu definiert. OpenAI arbeitet an GPT-5 und integriert seine Modelle in Microsoft Copilot. Das macht OpenAI sehr attraktiv für Unternehmen.

Google hat mit Gemini und Gemma neue Modelle entwickelt. Am 26. Januar 2024 übertraf Gemini Pro das GPT-4. Das zeigt den Wettbewerb.

Anthropics Claude fokussiert sich auf Sicherheit. Die Claude-Serie wird für ihre Zuverlässigkeit geschätzt. Claude achtet auf ethische Grenzen.

xAI von Elon Musk bietet Grok an. Dieses Modell ist leistungsfähig und hat Humor.

Open-Source-Modelle werden immer beliebter. Meta’s LLaMA-Sprachmodelle revolutionieren die Open-Source-Welt. Sie können diese Modelle selbst auf Servern laufen lassen.

Mistral AI aus Frankreich hat Mixtral 8x7b entwickelt. Im Januar 2024 war Mixtral 8x7b das leistungsfähigste offene LLM. Das zeigt, dass Open-Source wettbewerbsfähig ist.

Chinesische Anbieter wie Qwen von Alibaba verändern den Markt. Qwen entwickelt sich schnell weiter. DeepSeek, 01 AI und Zhipu AI bieten hochleistungsfähige Modelle. Sie investieren viel in KI-Forschung.

Vergleich der führenden Anbieter

Es gibt viele Modelle auf dem Markt. Jedes hat Vorteile für verschiedene Anwendungen:

| Anbieter | Modell | Typ | Besonderheit | Zugang |

|---|---|---|---|---|

| OpenAI | GPT-4, ChatGPT | Proprietär | Marktführer, hohe Leistung | API, Web-Interface |

| Gemini Pro, Gemma | Proprietär | Multimodal, Januar 2024 über GPT-4 | API, Web-Interface | |

| Anthropic | Claude | Proprietär | Sicherheitsfokus, zuverlässig | API, Web-Interface |

| xAI | Grok | Proprietär | Echtzeit-Informationen, Humor | X-Plattform |

| Meta | LLaMA-Sprachmodelle | Open-Source | Kostenlos, vollständige Kontrolle | Download, lokal |

| Mistral AI | Mixtral 8x7b | Open-Source | LMSYS-Leaderboard Champion | Download, lokal |

| Alibaba | Qwen | Proprietär/Open | Mehrsprachig, schnelle Entwicklung | API, Download |

| DeepSeek | DeepSeek LLM | Open-Source | Kosteneffizient, kompetitiv | Download, lokal |

| 01 AI | Yi-Modelle | Open-Source | Hochleistung, Mehrsprachigkeit | Download, lokal |

| Zhipu AI | ChatGLM | Open-Source | Chinesisch optimiert, kostenfrei | Download, API |

Proprietäre versus Open-Source-Lösungen

Es gibt zwei Strategien:

- Proprietäre Modelle bieten hohe Leistung ohne Aufwand

- ChatGPT und Gemini funktionieren sofort über APIs

- Sie zahlen pro Anfrage oder per Subscription

- OpenAI setzt die Standards mit ChatGPT

- Open-Source-Modelle geben vollständige Kontrolle

- Meta’s LLaMA-Sprachmodelle laufen auf Ihren Servern

- Sie sparen Gebühren, brauchen aber Hardware

- Mixtral 8x7b zeigt die Leistungsfähigkeit Open-Source

Das LMSYS Chatbot Arena Leaderboard hilft bei der Auswahl. Es bewertet Modelle nach echten Nutzer-Vergleichen. So sehen Sie, welches Modell am besten passt.

Chinesische Anbieter wie Qwen von Alibaba treten in den globalen Wettbewerb ein. Diese Modelle sind oft kostenlos und leistungsfähig. Sie bieten neue Möglichkeiten für internationale Teams.

Wählen Sie basierend auf Ihren Anforderungen. Möchten Sie sofort die beste Leistung? Nutzen Sie ChatGPT oder Gemini Pro. Wollen Sie Kontrolle und Kosteneffizienz? Wählen Sie LLaMA-Sprachmodelle oder Mixtral 8x7b.

Praktische Anwendungsbereiche von Large Language Models

Large Language Models verändern viele Branchen und Geschäftsprozesse. Sie helfen Unternehmen, Aufgaben zu automatisieren und die Qualität zu steigern. Sie werden in der Kundenbetreuung und der medizinischen Forschung eingesetzt. Diese Technologie bietet Lösungen für Geschäftsprobleme.

Einsatz in Kundenservice und Marketing

Kundenservice-Chatbots revolutionieren die Kommunikation mit Kunden. Sie beantworten Fragen rund um die Uhr und lösen Probleme selbstständig. Sie verbessern die Kundenbetreuung erheblich.

Im Marketing sind LLMs sehr nützlich:

- Textgenerierung für Werbetexte und Produktbeschreibungen

- Stimmungsanalyse zur Bewertung von Kundenfeedback

- Automatische Erstellung von Social-Media-Inhalten

- Personalisierte Kampagnenideen-Generierung

- Inhaltsklassifizierung für besseres Zielgruppen-Targeting

HubSpot und Salesforce nutzen LLMs für Satzvervollständigung. Das macht die Content-Erstellung schneller und die Kundenkommunikation besser.

Anwendungen im Gesundheitswesen und in der Wissenschaft

Im Gesundheitswesen sind LLMs sehr effektiv. Sie verstehen biologische Strukturen wie Proteine und DNA. Medizinische Chatbots unterstützen Patienten und beantworten Fragen.

LLMs beschleunigen die Medikamentenentwicklung:

| Aufgabe | Nutzen für Forscher | Zeitersparnis |

|---|---|---|

| Proteinstruktur-Analyse | Verständnis von Wechselwirkungen | Wochen statt Monate |

| Impfstoffentwicklung | Schnellere Kandidatenidentifikation | 30-40% schneller |

| Medikamentendesign | Optimierung molekularer Strukturen | 50% Zeiteinsparung |

| Literaturrecherche | Automatische Zusammenfassung von Studien | Tage statt Wochen |

In der Wissenschaft beschleunigen LLMs Forschungsprozesse. Sie helfen durch Informationsabruf bei Suchfunktionen und automatische Textzusammenfassung von Arbeiten. Forscher können sich auf kreative Aspekte konzentrieren.

Im Bankwesen helfen LLMs bei der Aufdeckung von Betrug. Sie erkennen verdächtige Aktivitäten und warnen Sicherheitsteams.

Die Codegenerierung und Textüberarbeitung machen Software-Entwickler produktiver. Sie erhalten automatische Fehleranalysen und Verbesserungsvorschläge.

Herausforderungen und Limitierungen von LLMs

Large Language Models sind beeindruckend, aber sie haben auch große Herausforderungen. Sie brauchen riesige Datenmengen und teure Computer. Das macht es schwer, sie zu nutzen.

Ein großes Problem ist, dass LLMs manchmal falsche Informationen erzeugen. Sie können plausibel klingen, aber faktisch falsch sein. Das ist ein großes Risiko für wichtige Anwendungen.

Ein weiteres Problem ist das Bias-Problem. LLMs können Vorurteile aus den Daten übernehmen. Das ist ein Problem, wenn sie auf Internetdaten trainiert werden.

- Halluzinationen durch ungenaue Generierung

- Gesellschaftliche Biases in Trainingsmaterialien

- Datenschutz- und Sicherheitsrisiken

- Erklärungsmangel bei komplexen Entscheidungen

LLMs sind sehr komplex. Das macht es schwer, ihre Entscheidungen zu verstehen. Ihre Fehlerbehebung ist auch kompliziert.

LLMs können auch die Cybersicherheit gefährden. Sie können bessere Phishing-E-Mails erstellen. Das ist ein Sicherheitsrisiko, das man ernst nehmen muss.

Ein weiteres Problem ist der Model Collapse. Wenn LLMs zu lange mit künstlichen Daten trainieren, können ihre Ergebnisse schlechter werden. Das passiert, wenn sie immer mit synthetischen Daten trainieren.

| Herausforderung | Auswirkung | Lösungsansatz |

|---|---|---|

| Halluzinationen | Falsche Informationen wirken glaubwürdig | Validierung durch Fachexperten |

| Biases in Daten | Verstärkung gesellschaftlicher Vorurteile | Sorgfältige Datenbereinigung |

| Hohe Betriebskosten | Finanzielle Barrieren für Unternehmen | Cloud-basierte Lösungen nutzen |

| Cybersicherheitsrisiken | Neue Angriffsvektoren entstehen | Sicherheitsaudits durchführen |

| Model Collapse | Qualitätsabbau über Zeit | Echte Daten im Training bevorzugen |

Um diese Probleme zu lösen, gibt es Lösungen. Führen Sie kontinuierliche Validierung durch. Machen Sie regelmäßige Sicherheitschecks. Nutzen Sie Überwachungssysteme, um die Leistung zu beobachten. Dokumentieren Sie die Grenzen und Limitierungen.

Das Bewusstsein für diese Herausforderungen ist wichtig. Durch sorgfältige Planung und Überwachung können Sie die Risiken verringern. So nutzen Sie die Vorteile dieser Technologie voll.

Open Source versus proprietäre Large Language Models

Die Wahl zwischen Open-Source- und proprietären Modellen ist wichtig. Proprietäre Modelle, wie GPT-4, Claude oder Gemini, kommen von Firmen. Sie sind nur über APIs oder Cloud-Dienste verfügbar. Sie haben keinen Zugriff auf die Modellarchitektur und sind von den Nutzungsbedingungen abhängig.

Open-Source-Modelle, wie LLaMA, Mistral oder BLOOM, bieten einen anderen Weg. Sie können diese Modelle herunterladen und anpassen. Diese Flexibilität verändert, wie Sie mit künstlicher Intelligenz arbeiten.

Vorteile von Open-Source-Modellen

Open-Source-Modelle haben viele Vorteile:

- Vollständige Kontrolle über Ihre Daten – Ihre Informationen bleiben in Ihrer Hand

- Keine Abhängigkeit von externen Anbietern – Sie sind unabhängig von deren Geschäftsentscheidungen

- Möglichkeit zur lokalen Ausführung ohne Internetverbindung – Arbeiten Sie offline und sicher

- Transparenz der Modellarchitektur – Sie verstehen, wie das System funktioniert

- Keine wiederkehrenden API-Kosten bei hohem Volumen – Skalierbarkeit ohne Kostensteigerung

- Fähigkeit, das Modell für Ihre spezifischen Anwendungen zu optimieren – Maßgeschneiderte Lösungen

Datenschutz und Lizenzierungsfragen

Beim Datenschutz gibt es Unterschiede. Bei proprietären Modellen gehen Ihre Daten an externe Server. Das ist problematisch für sensible Daten. Open-Source-Modelle können Sie in Ihrer eigenen Infrastruktur betreiben. Das erleichtert die DSGVO-Konformität.

Es gibt verschiedene Lizenzmodelle. Von offenen Lizenzen bis zu Hybrid-Modellen. So finden Sie die richtige Lizenz für Ihre Ziele.

| Kriterium | Proprietäre Modelle (GPT-4, Claude, Gemini) | Open-Source-Modelle (LLaMA, Mistral, BLOOM) |

|---|---|---|

| Zugang zur Architektur | Kein Zugriff auf Parameter oder Struktur | Vollständige Einsicht und Transparenz |

| Datenschutz | Daten auf externen Servern | Lokale Infrastruktur möglich |

| Kosten bei hohem Volumen | Wiederkehrende API-Kosten | Einmalige Hardware-Investition |

| Anpassungsfähigkeit | Begrenzte Konfigurierbarkeit | Unbegrenzte Modifizierbarkeit |

| Betriebsverantwortung | Anbieter kümmert sich um Updates | Sie verantworten Wartung und Updates |

| DSGVO-Konformität | Abhängig von Anbieterverpflichtungen | Direkt kontrollierbar |

| Performance | Höchstleistung der besten Modelle | Variabel, oft geringere Performance |

Es gibt Nachteile bei Open Source. Höhere Anfangsinvestitionen und Verantwortung für Wartung. Oft ist die Performance nicht so hoch wie bei proprietären Modellen. Diese Informationen helfen Ihnen, die beste Entscheidung zu treffen.

Zukunftsperspektiven und Weiterentwicklung

Die Zukunft der künstlichen Intelligenz bringt spannende Neuerungen. LLMs werden leistungsfähiger und vielseitiger. Sie können länger Texte verarbeiten und besser im Kontext denken.

Die Trainingsmethoden verbessern sich ständig. Reinforcement Learning from Human Feedback (RLHF) passt Modelle besser an menschliche Wünsche an. Neue Architekturen könnten die Modelle noch effizienter machen.

Wir sprechen über Large Action Models (LAMs). Sie können mehr als nur Text generieren. Sie können sogar Software bedienen oder physische Systeme steuern.

LLMs werden mit anderen Technologien verbunden. Sie werden genauer und aktuell bleiben. Sie können Text, Bild, Audio und Video nahtlos wechseln.

Wir sprechen auch über künstliche allgemeine Intelligenz (AGI). Heutige LLMs sind beeindruckend, aber sie verstehen nicht wirklich. Forscher arbeiten daran, Modelle zu schaffen, die wirklich verstehen und schlussfolgern können.

Ihre Rolle in dieser Entwicklung

Fortlaufende Weiterbildung ist wichtig. Die Technologie entwickelt sich schnell. Wer heute lernt, kann morgen nutzen.

Besuchen Sie unser Trainings- und Informationszentrum für aktuelle KI-Modelle. Dort können Sie mehr lernen und Erfahrungen sammeln. Sie können sich mit Experten austauschen.

- Verfolgen Sie Forschungsveröffentlichungen führender Instituten

- Experimentieren Sie mit Open-Source-Modellen in Ihrer Umgebung

- Bauen Sie Prototypen auf, um praktische Erfahrung zu gewinnen

- Vernetzen Sie sich mit anderen KI-Enthusiasten und Fachleuten

- Besuchen Sie Konferenzen und Workshops zur künstlichen Intelligenz

Die nächsten Jahre werden zeigen, wie KI in den Beruf und Alltag kommt. Ihre Vorbereitung heute entscheidet über Ihren Erfolg in der KI-gestützten Zukunft.

Fazit

Large Language Models sind heute nicht mehr nur Zukunftsmusik. Sie sind schon jetzt in vielen Bereichen nützlich. Beginnen Sie, die verfügbaren LLM-Tools zu erkunden und experimentieren Sie in Ihrem Unternehmen.

Dabei bauen Sie Ihre Kenntnisse auf und sehen, was für Ihre Firma nützlich ist. Eine Entscheidung müssen Sie treffen: Ob Sie sich für proprietäre oder Open-Source-Lösungen entscheiden. Beide haben ihre Vor- und Nachteile.

Open-Source-Modelle bieten Flexibilität und Kontrolle. Proprietäre Lösungen hingegen kommen oft mit besserer Unterstützung. Die Zukunft der LLMs sieht vielversprechend aus. Neue Verbesserungen werden noch mehr Möglichkeiten eröffnen.

Wer heute lernt und Erfahrungen sammelt, wird von zukünftigen Entwicklungen profitieren. Wir helfen Ihnen mit Schulungen und praktischer Unterstützung bei der Einführung von LLM-Lösungen. Nutzen Sie die Chance, Ihre KI-Fähigkeiten zu verbessern und Ihr Unternehmen zukunftssicher zu machen.