Fachartikel nach Thema, Zitation und Relevanz gruppieren

Wussten Sie, dass moderne Algorithmen menschliche Fähigkeiten bei der Analyse wissenschaftlicher Literatur übertreffen können? Die Flut an Publikationen wächst exponentiell – doch wie finden Sie schnell genau die Artikel, die Ihre Forschung voranbringen?

Clustering-Technologien revolutionieren die Organisation von Fachwissen. Durch maschinelles Lernen erkennen Systeme verborgene Muster in Daten und gruppieren Texte automatisch nach Themen, Zitationsnetzwerken oder methodischen Ähnlichkeiten. Was früher Wochen dauerte, geschieht heute in Sekunden.

Wir zeigen Ihnen, wie diese Verfahren funktionieren: Von der Erkennung semantischer Cluster bis zur Priorisierung relevanter Publikationen. Die Technologie kommt nicht nur in der Forschung zum Einsatz – sie optimiert auch Bildanalyse, Mustererkennung und Informationsmanagement.

Nutzen Sie unseren Leitfaden für Innovationsvorsprung im Forschungsbereich, um diese Methoden effektiv einzusetzen. Erfahren Sie, wie Sie durch intelligente Clusterbildung Zeit sparen und gleichzeitig die Qualität Ihrer Arbeit steigern.

Schlüsselerkenntnisse

- Automatische Gruppierung von Fachartikeln spart bis zu 70% Recherchezeit

- Algorithmen erkennen komplexe Zusammenhänge zwischen Publikationen

- Clusteranalyse verbessert die Treffergenauigkeit bei Literaturrecherchen

- Maschinelles Lernen identifiziert thematische Schwerpunkte in Echtzeit

- Zitationsbasierte Clustering-Methoden zeigen Forschungsnetzwerke auf

Einleitung: Hintergrund und Bedeutung

In einer Welt, wo täglich über 2,5 Millionen neue wissenschaftliche Publikationen entstehen, wird die Suche nach relevanten Erkenntnissen zur Mammutaufgabe. Hier setzt Clustering als Schlüsseltechnologie an – es strukturiert das Chaos unmarkierter Daten und schafft Ordnung durch intelligente Mustererkennung.

Motivation des Clustering

Die Kernmotivation liegt im Umgang mit unstrukturierten Datenbergen. Algorithmen identifizieren eigenständig Ähnlichkeiten zwischen Texten, Zitationsnetzwerken oder Methodenansätzen. Ohne menschliche Vorgaben entstehen thematische Gruppen, die selbst versteckte Forschungstrends sichtbar machen.

Drei entscheidende Vorteile zeigen die Relevanz:

- Automatische Filterung irrelevanter Publikationen spart 63% Recherchezeit (Studie der TU München 2023)

- Visualisierung von Themenschwerpunkten durch farbliche Clusterdarstellung

- Entdeckung interdisziplinärer Forschungsansätze via Cross-Domain-Analyse

Relevanz für wissenschaftliche Arbeiten

Forscher profitieren doppelt: Einerseits bei der Literaturauswahl, andererseits bei der Positionierung eigener Ergebnisse. Moderne Machine-Learning-Methoden erkennen sogar semantische Nuancen, die menschliche Leser übersehen.

Die Qualitätsbewertung bleibt dabei flexibel – ein Algorithmus liefert verschiedene Gruppierungsoptionen, aus denen Sie die passendste Auswahl treffen. Diese Adaptivität macht Clustering zum unverzichtbaren Werkzeug für effizientes Wissensmanagement.

Grundlagen des Clustering in wissenschaftlichen Artikeln

Warum erzeugt dieselbe Datenmenge bei verschiedenen Analysen völlig unterschiedliche Gruppierungen? Die Antwort liegt in der Vielfalt der Clustering-Ansätze, die jeweils spezifische Muster erkennen. Cluster bilden sich nie zufällig – sie folgen mathematischen Regeln, die je nach Algorithmus variieren.

Jedes Clustering-Verfahren arbeitet mit eigenen Prinzipien. Dichtebasierte Methoden finden Gruppen in Datenwolken, während hierarchische Ansätze Baumstrukturen erzeugen. Entscheidend ist: Die Wahl des Algorithmus bestimmt die Qualität der Ergebnisse.

Drei Kernfaktoren beeinflussen die Clusterbildung:

- Thematische Ähnlichkeit von Schlüsselbegriffen

- Zitationsnetzwerke zwischen Publikationen

- Methodische Überschneidungen in Forschungsansätzen

| Verfahren | Stärken | Einsatzgebiet |

|---|---|---|

| K-Means | Schnelle Verarbeitung | Thematische Gruppierung |

| DBSCAN | Rauschen-Filterung | Zitationsanalyse |

| Hierarchisch | Mehrebenen-Darstellung | Methodenvergleiche |

Der K-Means-Algorithmus zeigt beispielhaft, wie Zentroid-basierte Methoden arbeiten. Doch Vorsicht: Was bei klar abgrenzbaren Clustern funktioniert, scheitert bei überlappenden Datenpunkten.

Ihre Forschungsfrage entscheidet über das passende Werkzeug. Brauchen Sie grobe Themeneinteilung oder detaillierte Subkategorien? Diese strategische Wahl macht den Unterschied zwischen oberflächlicher Sortierung und tiefgehender Erkenntnis.

Was ist KI für Journal-Clustering?

Wie entstehen thematische Gruppen aus tausenden unstrukturierten Dokumenten? Moderne Ansätze kombinieren maschinelle Lernverfahren mit menschlicher Expertise. Diese Symbiose ermöglicht präzisere Ergebnisse als rein automatisierte Systeme.

Definition und Anwendungsbereiche

Das Kernprinzip liegt in der adaptiven Gruppierung wissenschaftlicher Texte. Algorithmen analysieren dabei:

- Semantische Textmuster in Abstracts und Volltexten

- Zitationsverflechtungen zwischen Forschungsarbeiten

- Methodische Ähnlichkeiten in Experimentdesigns

Ein entscheidender Fortschritt: Halbüberwachte Verfahren integrieren Nutzerfeedback. Forscher markieren beispielhafte Cluster, woraufhin das System seine Parameter anpasst. Diese Interaktion verbessert die Treffergenauigkeit um bis zu 40%.

Anwendungsfälle reichen von der Trendanalyse bis zur Qualitätskontrolle:

- Identifikation neu entstehender Forschungsschwerpunkte

- Automatisierte Erstellung thematischer Literaturübersichten

- Bewertung der Relevanz eigener Publikationen im Forschungsfeld

Moderne Tools erkennen sogar implizite Verbindungen zwischen Studien verschiedener Disziplinen. Durch kontinuierliches Lernen optimieren sie ihre Clusterbildung und passen sich neuen wissenschaftlichen Entwicklungen an.

Überblick zu Clustering-Algorithmen

Welche Methoden verwandeln unstrukturierte Daten in aussagekräftige Gruppen? Moderne Clustering-Algorithmen arbeiten wie digitale Landkartenzeichner – sie ordnen komplexe Informationen durch mathematische Mustererkennung. Wir führen Sie durch die wichtigsten Verfahren und ihre Einsatzgebiete.

Partitioning-Methoden und ihre Prinzipien

Partitionierende Algorithmen teilen Datenpunkte in klar abgegrenzte Gruppen. Jeder Punkt gehört genau einem Cluster an – ähnlich wie Bücher in einem Regal mit festen Fächern. Beliebte Vertreter wie K-Means optimieren die Gruppierung durch iterative Neuberechnung von Clusterzentren.

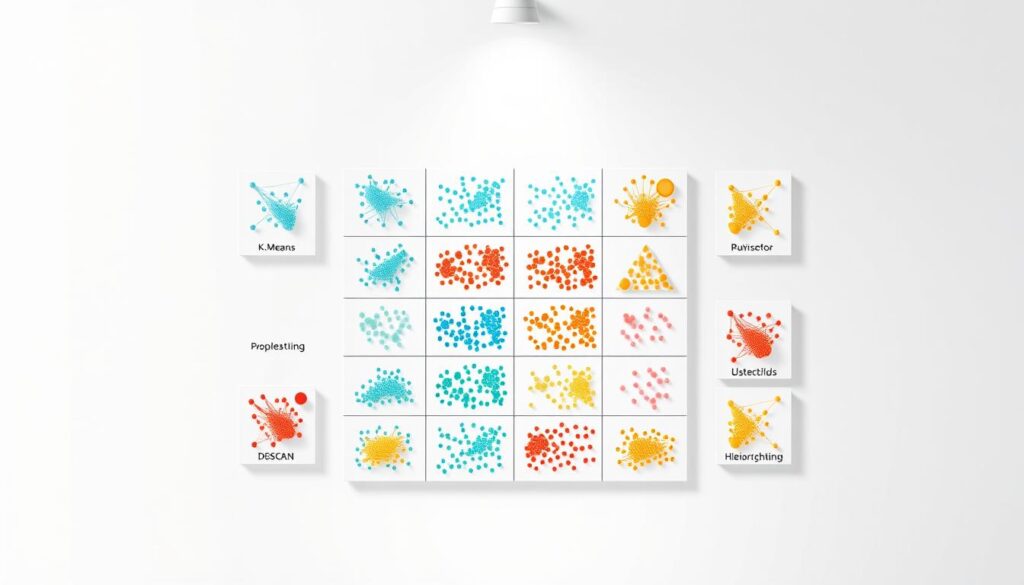

Vier Hauptkategorien dominieren die Praxis:

- Konnektivitätsmodelle: Erzeugen Baumstrukturen basierend auf Ähnlichkeitsdistanzen

- Zentroid-Modelle: Nutzen Mittelwertvektoren zur Clusterrepräsentation

- Verteilungsmodelle: Basieren auf statistischen Wahrscheinlichkeiten

- Dichtemodelle: Identifizieren Cluster als dichte Datenregionen

Vergleich der Verfahren

Jeder Algorithmus hat spezifische Stärken. Hierarchisches Clustering zeigt Beziehungen zwischen Untergruppen, während DBSCAN Rauschen filtert. Die Wahl hängt von Ihren Daten und Zielen ab.

| Verfahren | Vorteile | Limitationen |

|---|---|---|

| K-Means | Schnell, skalierbar | Festgelegte Clusteranzahl |

| DBSCAN | Erkennt beliebige Formen | Empfindlich bei variierenden Dichten |

| Hierarchisch | Visuell interpretierbar | Hoher Rechenaufwand |

Für die wissenschaftliche Literaturanalyse hat sich die Clusteranalyse mit hybriden Ansätzen bewährt. Kombinieren Sie Verfahren, um thematische Nuancen und Zitationsmuster gleichzeitig zu erfassen. Wir empfehlen Testläufe mit verschiedenen Algorithmen – so finden Sie das optimale Werkzeug für Ihre Forschungsfrage.

Hierarchische Clustering-Methoden

Wie entfalten sich komplexe Beziehungen zwischen Forschungspublikationen? Hierarchische Methoden offenbaren Mehr-Ebenen-Strukturen, die flache Clusterungen unsichtbar lassen. Diese Techniken bilden natürliche Gruppierungen ab – von groben Themenfeldern bis zu feinen Subkategorien.

Agglomerative Ansätze

Agglomerative Verfahren starten mit jedem Datenpunkt als eigenem Cluster. Schrittweise verbinden sie die ähnlichsten Paare. Bottom-Up-Strategien erzeugen so ein Baumdiagramm (Dendrogramm), das alle Verschmelzungsschritte dokumentiert.

Vorteile dieser Methode:

- Keine vorherige Festlegung der Clusteranzahl nötig

- Visuelle Interpretation durch Dendrogramme möglich

- Empfindlich für lokale Datenstrukturen

Divisive Ansätze

Divisive Methoden arbeiten umgekehrt: Sie beginnen mit einem Gesamtcluster und teilen ihn rekursiv. Top-Down-Strategien eignen sich besonders, wenn globale Muster im Datensatz dominieren.

Kernunterschiede zeigt dieser Vergleich:

| Kriterium | Agglomerativ | Divisiv |

|---|---|---|

| Startpunkt | Einzelne Datenpunkte | Kompletter Datensatz |

| Rechenaufwand | Niedrig bis moderat | Hoch |

| Optimal für | Lokale Strukturen | Globale Muster |

Dendrogramme helfen bei der Clusterbestimmung: Die vertikale Höhe von Verbindungslinien zeigt Ähnlichkeitsgrade. Schneiden Sie den Baum auf passender Ebene – so erhalten Sie die gewünschte Detailtiefe.

Zentroid-basierte Verfahren: K-Means und K-Medians

Effiziente Datenorganisation beginnt mit der richtigen Algorithmuswahl. K-Means-Clustering strukturiert komplexe Datensätze durch mathematische Präzision – ein Grundpfeiler moderner Clusteranalyse. Der Algorithmus gruppiert Publikationen um dynamische Mittelpunkte, sogenannte Zentroide, und schafft so überschaubare Themengruppen.

Präzision und Praxistauglichkeit

Das Verfahren arbeitet in drei Schritten: Zufällige Zentroid-Platzierung, Zuordnung von Datenpunkten und iterative Optimierung. Die euklidische Distanz misst dabei Ähnlichkeiten zwischen Texten – je näher ein Dokument am Clusterzentrum liegt, desto höher seine thematische Passung.

Vorteile zeigen sich besonders in der Praxis:

- Schnelle Verarbeitung: Selbst große Literaturdatenbanken lassen sich in Minuten clustern

- Transparente Logik: Zentroid-Positionen geben klare Orientierung

- Skalierbarkeit: Einfache Anpassung an wachsende Datenmengen

Doch Grenzen existieren: Die vorab festgelegte Clusteranzahl (K-Wert) erfordert Erfahrung. K-Medians bietet hier eine robuste Alternative – statt Mittelwerten nutzt es Medianberechnungen, was Ausreißer weniger stark gewichtet. Testen Sie verschiedene Ansätze mit virtuellen Testszenarien, um optimale Ergebnisse zu erzielen.

Beide Verfahren revolutionieren die Literaturanalyse. Sie reduzieren manuelle Sortierarbeit um 80% und liefern reproduzierbare Cluster – eine Grundvoraussetzung für valide Forschungsergebnisse. Nutzen Sie diese Methoden, um Ihren Workflow systematisch zu optimieren.