Ethik und Verantwortung in der KI

Wer trägt die Verantwortung, wenn KI falsch entscheidet? Diese Frage wird immer wichtiger in unserer digitalen Welt.

KI verändert unsere Arbeit grundlegend. Sie macht uns effizienter und automatisiert komplexe Aufgaben. Die Veröffentlichung von ChatGPT im Jahr 2022 hat KI für alle greifbar gemacht.

Mit mehr Leistung kommen auch Risiken. Datenverzerrungen und manipulierte Inhalte sind ein Problem. KI-Ethik ist jetzt ein zentrales Thema für Führungskräfte.

KI-Ethik ist nicht mehr nur eine philosophische Frage. Es ist ein Geschäftsproblem. Unternehmen, die sich mit KI-Ethik beschäftigen, schützen ihre Reputation und Vertrauen.

Verantwortung bei KI beginnt mit Verständnis der Technologie. Ohne ethische Überlegungen entstehen hohe Kosten. Rechtliche Probleme, finanzielle Verluste und Schäden für die Reputation sind die Folgen.

Diese Einführung zeigt, warum ethische Grundsätze bei KI wichtig sind. Wir helfen Ihnen, KI-Ethik in Ihr Unternehmen zu integrieren. So sichern Sie langfristigen Erfolg.

Wichtigste Erkenntnisse

- KI-Ethik ist eine geschäftskritische Anforderung und kein optional lösbares Problem mehr.

- Die Veröffentlichung von ChatGPT markierte einen Wendepunkt in der öffentlichen Wahrnehmung von künstlicher Intelligenz.

- Fehlende ethische Standards führen zu rechtlichen, finanziellen und reputationsbezogenen Risiken.

- Verantwortungsvoller KI-Einsatz erfordert tiefes Verständnis für die zugrunde liegende Technologie.

- Ethische KI schafft Wettbewerbsvorteile durch erhöhtes Vertrauen und nachhaltige Innovation.

- Die KI Verantwortung muss früh in der Unternehmensstrategie verankert werden.

- Regulatorische Rahmen wie der EU AI Act prägen die Zukunft von KI-Einsätzen weltweit.

Mehr als nur Technologie: Warum KI auch ein ethisches Thema ist

Künstliche Intelligenz ist mehr als nur Technologie. Die Entwicklung von KI-Systemen wie ChatGPT hat die Diskussion verändert. Es geht nicht nur um Technik, sondern um unsere Gesellschaft als Ganzes.

Systeme können nun Entscheidungen treffen und Inhalte erstellen. Das wirft wichtige Fragen auf. Wie verantwortungsbewusst nutzen wir diese Macht? Wer ist verantwortlich, wenn etwas schiefgeht?

Die KI Revolution zeigt, dass technische Fähigkeiten nicht genug sind. Es ist wichtig, ethische Standards zu setzen. Mit mehr Leistung kommt auch mehr Verantwortung.

Dies gilt besonders in sensiblen Bereichen wie Finanzen, Gesundheit und Justiz.

Der Wendepunkt durch ChatGPT und die neue Ära der KI

ChatGPT von OpenAI im November 2022 war ein wichtiger Moment. In nur zwei Monaten erreichte es 100 Millionen Nutzer. Es machte KI-Technologie für alle zugänglich.

ChatGPT kann natürliche Texte generieren und komplexe Fragen beantworten. Es versteht und spricht verschiedene Sprachen.

Diese Fähigkeiten zeigen, wie weit KI gekommen ist. Plötzlich konnten alle diese Technologie nutzen. Das veränderte alles.

Menschen stellten sich neue Fragen. Was bedeutet das für meine Arbeit? Kann diese Technologie manipuliert werden? Wie sicher sind meine Daten?

Von der Effizienzsteigerung zur gesellschaftlichen Verantwortung

Früher war der Fokus auf Effizienz. Unternehmen wollten schneller und sparsamer sein. Aber das reicht nicht mehr.

Heute erkennen Führungskräfte, dass KI auch eine gesellschaftliche Verantwortung hat. In der Finanzbranche sieht man das besonders deutlich.

| Bereich | Traditioneller Fokus | Heutiger Ansatz |

|---|---|---|

| Risk Management | Schnellere Risikoberechnung | Faire Bewertung ohne Diskriminierung |

| Kundeninteraktion | Automatisierte Antworten | Transparente und nachvollziehbare Kommunikation |

| Prozessautomatisierung | Maximale Effizienzgewinne | Balance zwischen Automatisierung und menschlicher Kontrolle |

| Datenverwertung | Breite Datennutzung | Datenschutz und Privatsphäre schützen |

Unternehmen, die nur auf Effizienz setzen, verlieren Vertrauen. KI muss ethisch eingesetzt werden. Das ist für langfristigen Erfolg unerlässlich.

ChatGPT hat uns eine Lektion beigebracht. Jetzt müssen wir diese Erkenntnis umsetzen. Als Führungskräfte müssen wir KI mit Ethik verbinden. Das ist die nächste Phase der KI Revolution.

Die versteckten Risiken: Wenn KI-Systeme diskriminieren

Künstliche Intelligenz verspricht Effizienz und faire Entscheidungen. Doch hinter vielen KI-Systemen verbergen sich versteckte Vorurteile. Diese führen zu systematischer Benachteiligung und betreffen Millionen Menschen täglich.

Die Ursache liegt in den Trainingsdaten. KI-Modelle lernen aus historischen Daten, die Vorurteile widerspiegeln. So werden alte Ungerechtigkeiten durch KI-Systeme verstärkt und automatisiert.

Das Beispiel der Kreditvergabe: Wie Vorurteile Algorithmen lenken

Ein Kunde beantragt einen Kredit bei einer Bank mit KI-System. Der Antrag wird automatisch abgelehnt. Der Grund wirkt objektiv, doch das System berücksichtigt versteckte Muster aus alten Daten.

Dieses Szenario ist kein Gedankenexperiment. Die Kreditvergabe KI zeigt, wie Bias KI entsteht:

- Historische Trainingsdaten enthalten gesellschaftliche Vorurteile

- Das System erkennt Muster, die mit bestimmten Gruppen verknüpft sind

- Entscheidungen folgen diesen Mustern – objektive Kriterien spielen eine Nebenrolle

- Bestimmte Bevölkerungsgruppen werden systematisch benachteiligt

Die Entscheidung wirkt automatisch und gerecht. Doch sie spiegelt Vorurteile Algorithmen wider, die in der Vergangenheit verankert sind.

Wie Diskriminierung in KI-Systemen entsteht

Bias KI entsteht nicht durch absichtliche Programmierung. Die Probleme entstehen subtil:

| Phase des KI-Lebenszyklus | Mögliche Diskriminierungsquellen | Auswirkungen |

|---|---|---|

| Datensammlung | Historische Daten spiegeln alte Diskriminierungen wider | KI lernt von unfairen Mustern |

| Datenaufbereitung | Fehlerhafte Klassifizierung von Gruppen | Systematische Verzerrungen entstehen |

| Modelltraining | Algorithmus optimiert für historische Muster | Vorurteile werden verstärkt |

| Anwendung | System trifft diskriminierende Entscheidungen | Menschen werden unfair behandelt |

Bei der Kreditvergabe KI bedeutet das: Ein Antragsteller wird abgelehnt. Nicht wegen seines Einkommens, sondern weil das System bestimmte Gruppen als „riskanter” einstuft. Das ist KI Diskriminierung in reiner Form.

Konsequenzen für Ihr Unternehmen

KI Diskriminierung ist mehr als ein ethisches Problem. Sie birgt konkrete Risiken:

- Rechtliche Konsequenzen: Die DSGVO und andere Gesetze verbieten Diskriminierung. Verstöße führen zu hohen Bußgeldern.

- Reputationsschäden: Wenn Kunden von unfairer KI-Behandlung erfahren, verlieren sie Vertrauen.

- Finanzielle Strafen: Regulierungsbehörden greifen ein und ahnden Verstöße.

- Verlust von Geschäftsmöglichkeiten: Talente und Kunden wenden sich ab.

Die Frage stellt sich: Wie können Sie sicherstellen, dass Ihre KI-Systeme fair sind? Der erste Schritt ist kritische Überprüfung der Trainingsdaten. Vorurteile Algorithmen entstehen in den Daten – dort müssen Sie ansetzen.

Erkennung und Prävention von KI Diskriminierung

Sie können Maßnahmen ergreifen, um Diskriminierung zu vermeiden:

- Überprüfen Sie Trainingsdaten auf Verzerrungen und historische Ungerechtigkeit

- Implementieren Sie Fairness-Metriken, um Bias KI zu messen

- Diversifizieren Sie Ihre Datenquellen

- Führen Sie regelmäßige Audits durch

- Schaffen Sie Transparenz in KI-Entscheidungen

Bei der Kreditvergabe KI bedeutet das: Prüfen Sie, ob Ihr System Bewerber fair behandelt. Messen Sie die Genehmigungsquoten nach Gruppen.

Sie sind nicht allein mit dieser Herausforderung. Unternehmen weltweit arbeiten daran, KI fairer zu gestalten. Der Weg beginnt mit dem Bewusstsein: Bias KI ist ein reales Risiko, das Sie kennen und proaktiv angehen müssen.

Ihr Vorteil: Unternehmen, die Diskriminierung aktiv bekämpfen, bauen Vertrauen auf. Sie gewinnen Kunden und Talente, die Wert auf Fairness legen. Ethische KI ist nicht nur verantwortungsvoll – sie ist auch geschäftlich sinnvoll.

Black Box Problem: Mangelnde Transparenz und Erklärbarkeit von KI-Entscheidungen

Künstliche Intelligenz beeinflusst unser Leben täglich. Doch viele KI-Systeme sind unsichtbar. Niemand kann genau erklären, wie sie Entscheidungen treffen.

Dieses Phänomen heißt Black Box Problem. Es zeigt, dass KI-Modelle nicht transparent sind. Ohne Transparenz entsteht Vertrauensverlust, besonders in sensiblen Bereichen.

Das Black Box Problem wächst mit der Komplexität der Systeme. Neuronale Netze haben Millionen von Parametern. Sie ermöglichen beeindruckende Leistungen, sind aber schwer zu verstehen.

Warum KI-Modelle als „Black Boxes” bezeichnet werden

KI-Systeme basieren auf mathematischen Prinzipien, die für Menschen schwer zu verstehen sind. Deep Learning Modelle verarbeiten Daten durch viele Schichten. Jede Schicht transformiert die Eingaben weiter.

Das Ergebnis ist ein komplexes Netzwerk. Selbst Experten können nicht genau sagen, welche inneren Prozesse zur Entscheidung führen.

Bei großen Sprachmodellen ist das Problem besonders groß. Sie lernen aus riesigen Datenmengen Muster. Aber niemand weiß genau, wie das funktioniert.

- Komplexe mathematische Strukturen erschweren die Nachverfolgung

- Millionen von Parametern erzeugen undurchschaubare Entscheidungswege

- Selbst Entwickler können einzelne Vorhersagen nicht erklären

- Die Funktionsweise lässt sich nicht in einfache Regeln übersetzen

Die Herausforderung der Nachvollziehbarkeit für Vertrauen

Vertrauen entsteht durch Verständnis. Ohne KI Transparenz sinkt das Vertrauen. Das gilt besonders in kritischen Bereichen.

| Bereich | Anforderung an Transparenz | Risiko ohne Erklärbarkeit KI |

|---|---|---|

| Medizin | Sehr hoch | Ärzte können Diagnosen nicht nachvollziehen |

| Justiz | Sehr hoch | Urteile werden als willkürlich wahrgenommen |

| Kreditvergabe | Hoch | Diskriminierung bleibt unentdeckt |

| Personalauswahl | Hoch | Bewerber können Ablehnung nicht anfechten |

Explainable AI (XAI) – erklärbare künstliche Intelligenz – wird immer wichtiger. Diese Ansätze machen KI-Entscheidungen nachvollziehbar. Sie zeigen auf, welche Daten und Faktoren zu einer Vorhersage führten.

Es gibt verschiedene Wege, KI Transparenz zu verbessern:

- Interpretierbare Modelle von Anfang an einsetzen

- Visualisierungstechniken nutzen, um Entscheidungen sichtbar zu machen

- Regelmäßige Audits durchführen, um Verzerrungen aufzudecken

- Mit Stakeholdern kommunizieren, wie Systeme funktionieren

- Dokumentation schaffen, die KI-Prozesse erklärbar macht

Nachvollziehbarkeit ist nicht nur ethisch wichtig. Es ist auch wirtschaftlich vorteilhaft. Organisationen, die ihre KI-Systeme transparent gestalten, gewinnen schneller Akzeptanz. Sie erfüllen leichter gesetzliche Anforderungen. Vertrauen wird zur Wettbewerbsstärke – und das beginnt mit echter KI Transparenz und echter Erklärbarkeit KI.

Bias und Diskriminierung: Wenn Vorurteile in Algorithmen einprogrammiert werden

KI-Systeme lernen aus Daten. Diese Daten zeigen oft die Vorurteile unserer Gesellschaft. Das bedeutet, dass Algorithmen, die auf verzerrten Informationen trainiert werden, Diskriminierung verstärken können.

Die Voreingenommenheit KI zeigt sich in vielen Bereichen. Bei Bewerbungsverfahren können Systeme Frauen benachteiligen. Gesichtserkennungssysteme erkennen Menschen mit dunkler Haut schlechter. Kreditvergabe-Algorithmen lehnen Anträge aus bestimmten Regionen ab.

Wie entstehen Vorurteile in KI-Systemen?

Algorithmic Bias entsteht durch verschiedene Mechanismen:

- Verzerrte Trainingsdaten: Wenn historische Daten Diskriminierung widerspiegeln, lernt die KI diese Muster

- Unausgewogene Datensätze: Zu wenig Daten von Minderheiten führen zu schlechteren Vorhersagen für diese Gruppen

- Problematische Zieldefinitionen: Falsch gesetzte Optimierungsziele verstärken Ungleichheiten

- Fehlende Diversität: Teams ohne vielfältige Perspektiven übersehen Bias-Probleme

Fairness KI muss von Anfang an eingeplant werden. Sie ist kein nachträglicher Gedanke, sondern ein zentraler Baustein verantwortungsvoller KI-Entwicklung.

Konkrete Beispiele aus der Praxis

| Bereich | Bias-Problem | Auswirkung |

|---|---|---|

| Bewerbungsverfahren KI | System bevorzugt männliche Kandidaten | Frauen werden systematisch ausgeschlossen |

| Gesichtserkennung | Höhere Fehlerquoten bei bestimmten Ethnien | Ungerechte Behandlung bei Sicherheitskontrollen |

| Kreditvergabe | Geografische oder ethnische Voreingenommenheit KI | Benachteiligung bei Finanzierung |

| Medizinische Diagnose | Trainingsdaten unterrepräsentieren Minderheiten | Schlechtere Behandlungsergebnisse |

Was Sie jetzt tun können

Identifizieren Sie Risikofaktoren in Ihren KI-Projekten. Untersuchen Sie Ihre Trainingsdaten auf Verzerrungen. Stellen Sie sicher, dass verschiedene Gruppen angemessen vertreten sind. Fairness KI erfordert kontinuierliche Überprüfung und Anpassung.

Sie tragen Verantwortung dafür, dass Ihre KI-Systeme gerecht wirken. Algorithmic Bias zu erkennen und zu bekämpfen schützt nicht nur Einzelne – es stärkt auch das Vertrauen in Ihre Technologien.

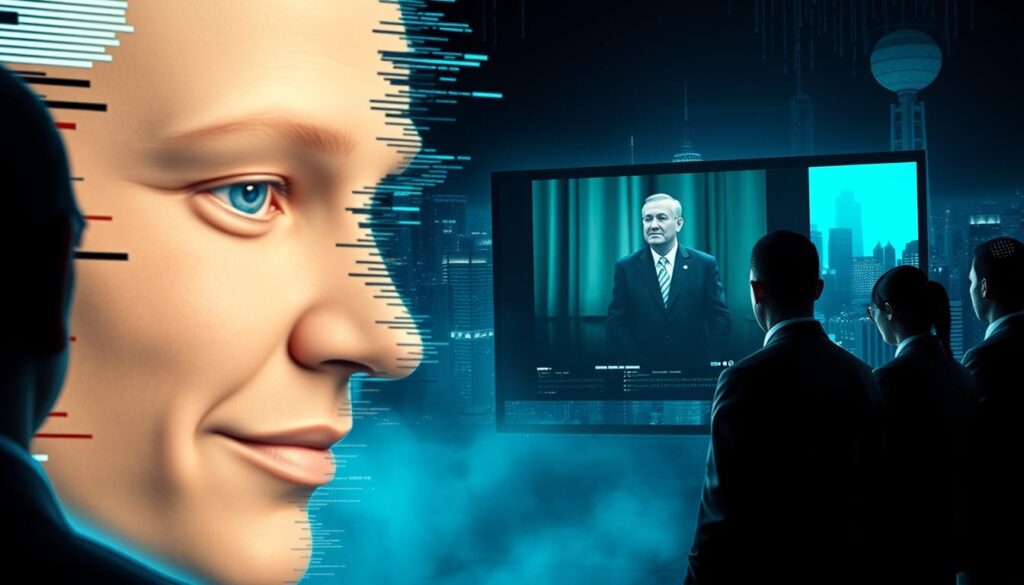

Sicherheitsrisiken durch KI: Von Deepfakes bis zur Manipulation demokratischer Prozesse

Künstliche Intelligenz bietet viele Vorteile. Doch es gibt auch neue Gefahren, die ernst genommen werden müssen. Diese Technologie kann missbraucht werden, um Vertrauen zu zerstören und demokratische Prozesse zu gefährden.

Die Risiken reichen von technischen Manipulationen bis zu schleichenden Veränderungen unserer Entscheidungsfreiheit. Wir zeigen Ihnen, wo die Gefahren lauern und wie Sie handeln können.

Automatisierte Desinformation und ihre Gefahren

Deepfakes sind Videos oder Bilder, die so echt wirken, als ob sie echt wären. Sie werden mit KI-Technologie erstellt. Diese gefälschten Inhalte verbreiten sich schnell in sozialen Netzwerken.

Die Gefahr ist real: Deepfakes können Wahlen beeinflussen, Unternehmensreputation zerstören und Vertrauen in Institutionen untergraben. Ein gefälschtes Video eines Politikers kann Millionen Menschen erreichen, bevor die Wahrheit ans Licht kommt.

Fake News KI geht noch weiter. Algorithmen generieren automatisch täuschende Texte, Bilder und Videos. Diese Desinformation KI läuft rund um die Uhr und passt sich an verschiedene Zielgruppen an. Sie arbeitet schneller, günstiger und skalierbarer als manuell erstellte Falschinformation.

- Automatische Erstellung überzeugender Inhalte

- Gezielt Angst und Wut schüren

- Verbreitung durch Bot-Netzwerke

- Schwer zu erkennen und zu widerlegen

- Langfristige Erosion des Vertrauens

Diese Desinformation KI bedroht die Grundlagen unserer Demokratie. Wähler erhalten verzerrte Informationen. Unternehmenschefs werden diffamiert. Wissenschaftliche Fakten werden angezweifelt.

Der Verlust menschlicher Autonomie durch übermäßige Automatisierung

Ein subtileres, aber ebenso ernstes Problem entsteht durch zu viel Automatisierung. Wenn KI-Systeme zu viele Entscheidungen treffen, verlieren Menschen die Kontrolle über ihr Leben und ihre Zukunft. Die menschliche Autonomie wird schleichend untergraben.

Stellen Sie sich vor: Ein Algorithmus entscheidet, ob Sie einen Kredit bekommen. Ein anderer bestimmt, ob Sie eingestellt werden. Ein dritter legt fest, welche Informationen Sie in den Nachrichten sehen. Sie haben keine Chance, diese Entscheidungen zu beeinflussen oder zu verstehen.

Die Risiken dieser menschlichen Autonomie Untergrabung sind groß:

| Bereich | Automatisiertes Risiko | Auswirkung auf Autonomie |

|---|---|---|

| Kreditvergabe | KI lehnt Antrag ab, ohne Begründung | Finanzielle Chancen blockiert |

| Personalentscheidungen | System filtert Bewerbungen vor | Berufliche Zukunft fremdbestimmt |

| Medizinische Diagnose | Algorithmus bestimmt Behandlung | Gesundheitsentscheidungen entzogen |

| Informationsfluss | Filter-Blasen durch Algorithmen | Zugang zu vielfältigen Meinungen begrenzt |

| Strafvollzug | KI berechnet Rückfallrisiko | Rehabilitation und Freiheit in Frage gestellt |

Kritische Entscheidungen brauchen menschliches Urteilsvermögen. Menschen können Kontext verstehen, Mitgefühl zeigen und ethische Fragen berücksichtigen. Maschinen können das nicht.

Was Sie tun sollten:

- Fragen Sie: Wo automatisiert unser Unternehmen wichtige Entscheidungen?

- Überprüfen Sie: Können betroffene Menschen diese Entscheidungen anfechten?

- Handeln Sie: Bauen Sie menschliche Kontrolle und Transparenz ein

- Schulen Sie: Teams müssen KI Sicherheitsrisiken erkennen

- Überwachen Sie: Kontrollieren Sie regelmäßig, ob Systeme fair arbeiten

Die Balance ist entscheidend. KI soll Menschen unterstützen, nicht ersetzen. Nutzen Sie Technologie als Werkzeug zur Verbesserung menschlicher Entscheidungen, nicht zur Umgehung von Verantwortung.

Deepfakes, Fake News KI und Automatisierung sind nicht abstrakte Risiken. Sie betreffen Ihre Mitarbeiter, Ihre Kunden und Ihre Gesellschaft. Mit dem richtigen Verständnis dieser KI Sicherheitsrisiken können Sie schützen statt zu gefährden.

Soziale Ungleichheit und Arbeitsplatzverluste durch KI-Automatisierung

Die KI Automatisierung verändert die Arbeitswelt schneller als je zuvor. Maschinen übernehmen Aufgaben, die früher Menschen erfüllt haben. Doch diese Entwicklung hat zwei Seiten. Sie schafft neue Chancen, erfordert aber auch umfassende Anpassungen.

Arbeitsplatzverluste KI entstehen nicht willkürlich. Bestimmte Branchen sind stärker betroffen als andere. Besonders gefährdet sind Tätigkeiten, die repetitiv und vorhersehbar sind. Logistik, Fertigung und einfache administrative Prozesse erleben massive Veränderungen.

| Berufsfeld | Automatisierungsrisiko | Neue Qualifikationen erforderlich | Wachstumspotenzial |

|---|---|---|---|

| Fertigung und Logistik | Sehr hoch | KI-Überwachung, Datenanalyse | Mittelhoch |

| Kundenservice | Hoch | Emotionale Intelligenz, Problemlösung | Hoch |

| Datenverarbeitung | Sehr hoch | KI-Verständnis, Interpretation | Gering |

| Kreative Berufe | Mittel | Technisches Verständnis, Strategisches Denken | Sehr hoch |

| Gesundheitswesen | Mittel | Menschliches Einfühlungsvermögen, KI-Integration | Sehr hoch |

Die Soziale Ungleichheit KI wird zum drängenden Problem. Wer Zugang zu hochwertiger KI-Bildung hat, profitiert enorm. Wer nicht, bleibt zurück. Diese Digitale Kluft vergrößert sich täglich. Unternehmen in wohlhabenderen Regionen investieren massiv in KI-Technologien. Kleinere Betriebe und Entwicklungsländer hinken hinterher.

Das bedeutet für Sie als Führungskraft klare Verantwortung. Sie gestalten mit, wie Ihre Organisation den Übergang gestaltet. Investitionen in Mitarbeitende zahlen sich aus. Umschulung, Weiterbildung und kontinuierliches Lernen sind keine Kosten – sie sind Investitionen in Ihre Zukunft.

Chancen statt Dystopien: KI als Augmentation von Menschlicher Arbeit

KI muss nicht ersetzen. Sie kann ergänzen. Wenn Sie Machine Learning und Deep Learning KI-Technologien richtig einsetzen, entstehen hybride Arbeitsmodelle. Menschen konzentrieren sich auf strategische, kreative und emotionale Aufgaben. Algorithmen erledigen die Routine.

- Augmentation statt Substitution: KI unterstützt Menschen, ersetzt sie nicht

- Gezielte Schulungsprogramme für betroffene Mitarbeitende

- Transparente Kommunikation über Automatisierungspläne

- Karrierepfade für neue, qualifizierte Rollen schaffen

- Diversität in KI-Entwicklung fördern und Bias vermeiden

Die Antwort auf Arbeitsplatzverluste KI liegt in proaktiver Gestaltung. Unternehmen, die ihre Teams mitnehmen, gewinnen Loyalität und Fachkompetenz. Gesellschaften, die Bildung fördern, bauen Brücken über die Digitale Kluft.

Die Verantwortungslücke: Wer haftet bei KI-Fehlern?

Ein autonomes System macht eine falsche Entscheidung und verursacht Schaden. Wer ist dafür verantwortlich? Entwickler, Betreiber oder das System selbst? Diese Fragen sind ein großes Problem der KI.

Wenn ein KI-System durch Lernen sich verändert, ist es schwer, Fehler zu verantworten.

Bei komplexen KI-Systemen gibt es viele Unsicherheiten. Viele Parteien sind beteiligt:

- Forschende und Entwickler von KI-Modellen

- Programmierer, die die Systeme umsetzen

- Trainer, die Daten für das Lernen bereitstellen

- Betreiber, die die KI im Einsatz überwachen

- Nutzer, die das System anwenden

Die Frage, wer für KI Fehler verantwortlich ist, wird immer wichtiger. Traditionelle Haftungskonzepte passen nicht zu KI. Ein KI-Modell kann durch Millionen von Daten trainiert werden. Es ist schwer zu sagen, welches Training zu einem Fehler geführt hat.

Das Problem der Zurechenbarkeit bei autonomen Systemen

Bei maschinellem Lernen und Deep Learning können Systeme sich selbst verändern. Das führt zu einer Verantwortungslücke. Niemand weiß genau, wer für Fehler haftet.

Ein Beispiel: Ein KI-System in der Medizin gibt eine falsche Diagnose. Der Patient erleidet Schaden. Wer ist dafür verantwortlich?

| Beteiligte Partei | Mögliche Verantwortung | Herausforderung bei der Zuordnung |

|---|---|---|

| Entwickler | Fehler im Algorithmus-Design | Schwer nachzuweisen, da sich Systeme durch Lernen verändern |

| Datenbeschaffung | Mangelhafte oder verzerrte Trainingsdaten | Ursprung von Bias-Fehlern oft unklar |

| Betreiber | Unzureichende Überwachung und Wartung | Grenzbereich zwischen technischer und organisatorischer Verantwortung |

| Nutzer | Falsche Verwendung des Systems | Kontext und Anwendungsgrenzen oft nicht klar definiert |

Die Verantwortungslücke entsteht, weil KI Fehler nicht einfach zugeordnet werden können. Ein KI-System kann Tausende von Entscheidungen treffen, bevor ein Fehler sichtbar wird. Der genaue Punkt, an dem der Fehler entstanden ist, bleibt oft verborgen.

Klare Regeln und Dokumentation sind wichtig. Man muss wissen, welche Daten verwendet wurden und wie das Modell trainiert wurde. Wer hat welche Entscheidungen getroffen? Diese Transparenz schließt die Verantwortungslücke und schafft faire Haftung.

Nur durch klare Haftungsregeln und Nachverfolgung lässt sich die Zurechenbarkeit KI sichern. Das ist wichtig für das Vertrauen in KI-Systeme.

KI Ethik: Grundprinzipien für den verantwortungsvollen Umgang mit künstlicher Intelligenz

KI Ethik ist wichtig für den sicheren Umgang mit künstlicher Intelligenz. Es ist ein Gebiet, das Philosophie, Recht, Informatik und Sozialwissenschaften verbindet. Es geht um Werte unserer Gesellschaft, nicht nur um Technik.

Verantwortungsvolle KI bedeutet, dass ethische Überlegungen immer wichtig sind. Sie begleiten ein KI-System von Anfang bis Ende. Von der Idee bis zur Anwendung und Überwachung sind ethische Fragen immer da.

Ein KI Rahmenwerk berücksichtigt viele Perspektiven. Unternehmen, Regierungen, Forschende und Zivilgesellschaft arbeiten zusammen. Sie entwickeln ethische Grundsätze KI.

Warum Ethik kein Hindernis ist, sondern ein Vorteil

Viele denken, Ethik hält zurück. Das ist ein Irrtum. Ethik schafft Vertrauen bei Kunden, Behörden und der Öffentlichkeit. Sie mindert Risiken und Haftungsgefahren.

Die wichtigsten Bereiche einer ethischen KI-Entwicklung sind:

- Transparenz und Erklärbarkeit von KI-Entscheidungen

- Schutz vor Diskriminierung und Bias

- Datenschutz und Privatsphäre

- Sicherheit und Robustheit der Systeme

- Menschliche Kontrolle und Verantwortlichkeit

- Fairness und Gerechtigkeit bei der Anwendung

Mit einer klaren verantwortungsvollen KI-Strategie wird Ihr Unternehmen vertrauenswürdig. Sie baut langfristige Beziehungen auf und sichert sich Vorteile im Markt.

Die sieben ethischen Prinzipien der EU für vertrauenswürdige KI

Die Europäische Union hat einen Weg für verantwortungsvolle KI gefunden. Die EU KI Prinzipien sind das Fundament für eine sichere KI-Landschaft. Diese Prinzipien entstanden aus intensiven Diskussionen der EU-Kommission und internationalen Experten.

Die Prinzipien basieren auf bewährten internationalen Standards. Die OECD KI Prinzipien ergänzen den europäischen Ansatz um globale Perspektiven. Zusammen schaffen sie die Grundlage für Vertrauenswürdige KI, die Menschen unterstützt und schützt.

Die sieben Prinzipien sind nicht isoliert zu betrachten. Sie bilden ein zusammenhängendes System, das ethisches Handeln in allen KI-Projekten sicherstellt:

- Menschliches Handeln und Aufsicht haben Vorrang

- Technische Robustheit und Sicherheit

- Verantwortlichkeit

- Vielfalt, Nicht-Diskriminierung und Fairness

- Transparenz

- Gesellschaftliches und ökologisches Wohlergehen

- Privatsphäre und Datenschutz

Menschliches Handeln und Aufsicht als oberstes Gebot

Das erste Prinzip der EU KI Prinzipien steht über allem anderen: Menschen müssen die Kontrolle behalten. KI-Systeme dienen als Werkzeuge zur Unterstützung menschlicher Entscheidungen, ersetzen diese aber nicht. Diese Maxime ist nicht verhandelbar.

In der Praxis bedeutet dies klare Regeln. Menschen müssen KI-Entscheidungen verstehen, überprüfen und bei Bedarf widersprechen können. Besonders bei wichtigen Entscheidungen – in Medizin, Justiz oder Sicherheit – bleibt die menschliche Verantwortung zentral. Die Vertrauenswürdige KI respektiert Grundrechte und Menschenwürde.

Ihre Aufgabe besteht darin, Aufsichtsmechanismen einzubauen. Schulen Sie Teams, um KI-Systeme kritisch zu bewerten. Legen Sie fest, wer am Ende Entscheidungen trifft.

Technische Robustheit, Sicherheit und Verantwortlichkeit

KI-Systeme müssen zuverlässig funktionieren. Sie dürfen nicht unerwartet ausfallen oder sich unvorhersehbar verhalten. Technische Robustheit ist ein Kernpunkt der Ethische Leitlinien EU.

Das bedeutet konkret: Systeme müssen Fehler, Störungen und Angriffe verkraften. Sie sollten sich sicher verhalten, auch wenn etwas schiefgeht. Tests und Überwachung sind ständige Aufgaben.

Verantwortlichkeit erfordert Klarheit. Dokumentieren Sie, wie Systeme funktionieren. Tracken Sie ihre Entscheidungen nach. Bestimmen Sie, wer bei Problemen handelt und trägt Konsequenzen.

| Prinzip | Bedeutung | Praktische Umsetzung |

|---|---|---|

| Menschliches Handeln und Aufsicht | Menschen bleiben Entscheidungsträger | Überprüfungsmechanismen, Eskalationsprozesse |

| Technische Robustheit und Sicherheit | Zuverlässige und sichere Systeme | Umfassende Tests, Fehleranalyse, Monitoring |

| Verantwortlichkeit | Klare Zuständigkeiten und Nachverfolgung | Dokumentation, Audit-Trails, Governance |

| Fairness und Nicht-Diskriminierung | Gleiche Behandlung aller Nutzer | Bias-Tests, diverse Trainings-Daten |

| Transparenz | Verständlichkeit von KI-Entscheidungen | Erklärbarkeit, Nachvollziehbarkeit |

| Gesellschaftliches Wohlergehen | Positive Auswirkungen auf Gemeinschaft | Impact-Analysen, Stakeholder-Dialog |

| Datenschutz und Privatsphäre | Schutz persönlicher Informationen | DSGVO-Compliance, Datensicherheit |

Die OECD KI Prinzipien unterstützen diesen europäischen Rahmen auf internationaler Ebene. Unternehmen, die diese Standards erfüllen, bauen Vertrauen auf. Kunden, Partner und Behörden erkennen Ihr Engagement für ethische KI an.

Beginnen Sie heute mit der Umsetzung. Audits helfen, Lücken zu erkennen. Schulungen stärken das Bewusstsein im Team. Die Investition in Vertrauenswürdige KI sichert Ihre Zukunft im digitalen Markt.

Der EU AI Act: Rechtsverbindliche Regelungen für KI-Systeme

Die KI Verordnung der Europäischen Union ist ein großer Schritt. Seit 2024 gibt der EU AI Act klare Regeln für die Entwicklung und Nutzung von KI in Europa. Es ist ein Gesetz, das man nicht ignorieren kann.

Der EU AI Act macht ethische Prinzipien zu Gesetzen. Unternehmen müssen sich an diese Regeln halten, wenn sie KI-Systeme entwickeln oder nutzen. Das betrifft alle, von großen Konzernen bis zu kleinen Betrieben in Deutschland und Europa.

Warum die KI Regulierung Europa braucht

Die AI Act Deutschland Implementation zeigt, wie wichtig KI-Systeme sind. Sie beeinflussen unser Leben in vielen Bereichen. Ohne klare Regeln gibt es Risiken für uns alle.

Der EU AI Act bringt Ordnung durch einen risikobasierten Ansatz:

- Minimales Risiko: Chatbots und einfache Empfehlungssysteme

- Begrenztes Risiko: KI-Systeme mit Transparenzanforderungen

- Hohes Risiko: Systeme in kritischen Bereichen wie Medizin und Justiz

- Unannehmbares Risiko: Systeme, die grundlegende Rechte gefährden

Was der EU AI Act für Ihr Unternehmen bedeutet

Die KI Verordnung ist eine Chance, nicht nur eine Bürde. Unternehmen, die sich an die Standards halten, bauen Vertrauen auf. Kunden wissen, dass ihre Daten sicher sind und Entscheidungen nachvollziehbar.

Compliance-Anforderungen betreffen vor allem:

- Dokumentation von KI-Systemen und deren Funktionsweise

- Transparenz gegenüber Nutzern und Behörden

- Regelmäßige Tests auf Fehler und Verzerrungen

- Bereitstellung von technischen Mitteln zur Überwachung

Die AI Act Deutschland Implementierung erfolgt Schritt für Schritt. Es gibt verschiedene Fristen für die Umsetzung. Das gibt Unternehmen Zeit, sich anzupassen.

Mit dem EU AI Act zeigen Sie, dass Ihr Unternehmen vertrauenswürdig ist. Sie zeigen, dass Sie KI verantwortungsbewusst nutzen. Sie schützen Grundrechte und fördern Innovation sicher und ethisch.

Risikokategorien im EU AI Act: Von minimalem bis zu unannehmbarem Risiko

Der EU AI Act bringt Klarheit in den Bereich der Künstlichen Intelligenz. Er teilt KI in vier Risikostufen ein. Diese Kategorien zeigen, welche KI-Systeme streng reguliert werden und welche weniger Anforderungen haben.

Die KI Risikoklassifizierung ist das Herzstück der neuen europäischen Regulierung. Jede Kategorie hat eigene Pflichten. Die Einteilung reicht von minimalem Risiko bis zu Anwendungen, die in der EU verboten sind.

- Minimales Risiko: Viele alltägliche KI-Anwendungen fallen hier rein. Chatbots oder Spracherkennungssysteme haben geringe Auswirkungen auf Menschen.

- Begrenztes Risiko: Diese Systeme brauchen Transparenzanforderungen. Sie müssen Nutzern klar machen, dass sie mit KI interagieren.

- Hohes Risiko: Hier greift die Hochrisiko KI ein. Diese Systeme brauchen umfangreiche Tests und Dokumentation.

- Unannehmbares Risiko: Das Unannehmbares Risiko KI ist in der EU verboten. Social Scoring und manipulative Systeme fallen darunter.

Hochrisiko-KI in Medizin, Verkehr und Justiz

Die Hochrisiko KI betrifft Bereiche, wo KI-Fehler großen Schaden anrichten können. Wenn ein System falsche Entscheidungen trifft, können Menschen zu Schaden kommen. Das ist der Grund für strikte Anforderungen an diese Systeme.

In der Medizin entscheidet KI über Diagnosen und Behandlungen. Ein Fehler kann den Patienten gefährden. Im Verkehr steuern KI-Systeme selbstfahrende Autos und analysieren Verkehrsdaten. Im Justizsystem beeinflussen KI-Systeme Urteile und Bewährungsentscheidungen.

| Bereich | KI-Anwendung | Anforderungen |

|---|---|---|

| Medizin | Diagnose-Assistenzsysteme | Klinische Validierung, ständige Überwachung |

| Verkehr | Autonome Fahrzeuge | Sicherheitstests, Dokumentation von Trainingsdaten |

| Justiz | Risikobewertungssysteme | Erklärbarkeit, Audit-Trails, Fairness-Tests |

| Bildung | Bewertungssysteme | Transparenz gegenüber Nutzern und Betroffenen |

| Kritische Infrastruktur | Kontrollsysteme für Energieversorgung | Robustheit, Sicherheitsmaßnahmen, Notfallplanung |

Für die Hochrisiko KI gelten konkrete Pflichten. Sie brauchen detaillierte Dokumentation. Das System muss regelmäßig getestet werden. Die Trainingsdaten müssen hochwertig sein. Menschliche Überwachung bleibt erforderlich. Diese Maßnahmen sollen sicherstellen, dass die KI zuverlässig und fair arbeitet.

Die KI Risikoklassifizierung hilft Ihnen, die richtigen Schritte zu planen. Kennen Sie die Anforderungen Ihrer Risikokategorie, können Sie gezielt Compliance-Maßnahmen umsetzen. So bauen Sie Vertrauen auf und arbeiten rechtskonform mit KI-Systemen.

Die Frage nach der elektronischen Person: Können Maschinen Verantwortung übernehmen?

Die Diskussion um KI-Ethik ist spannend. Eine zentrale Frage ist, ob wir Maschinen als rechtliche Personen anerkennen sollten. Das Europäische Parlament hat sich dieser Frage angenommen. Sie fordert die Überlegung einer elektronischen Person.

Diese Kategorie würde autonome Systeme für Schäden verantwortlich machen. Doch die Idee ist umstritten.

Das Konzept der E-Person KI klingt verlockend. Es könnte die Verantwortungslücke schließen. Eine elektronische Person könnte als Zwischenschicht dienen.

Sie könnte Versicherungen abschließen und Schadensersatz zahlen. Für Unternehmen würde das klare Grenzen schaffen.

Die Idee wirft aber tiefe philosophische Fragen auf. Verantwortung setzt voraus, dass jemand verstehen kann, was er tut. KI-Systeme verfügen über keine dieser Eigenschaften.

Sie folgen Algorithmen und treffen keine bewussten Entscheidungen. Sie haben keine Ziele, die aus eigenem Willen entstehen.

Warum das E-Person-Konzept problematisch ist

Die meisten Ethiker und Juristen lehnen die KI Rechtspersönlichkeit ab. Maschinen können nicht verstehen, was Verantwortung bedeutet. Sie können nicht bereuen.

Sie können nicht lernen, es besser zu machen, weil sie moralisch wachsen. Verantwortung braucht ein Bewusstsein dafür, dass man falsch gehandelt hat.

- KI-Systeme folgen Programmen, die Menschen geschrieben haben

- Sie können nicht selbstständig moralische Entscheidungen treffen

- Sie haben keine innere Motivation oder Gewissen

- Sie können nicht für ihre Handlungen „büßen” oder es besser machen

Die Maschinen Verantwortung auf Maschinen zu verschieben würde ein fundamentales Problem schaffen. Es würde menschliche Verantwortung verwässern. Die Menschen, die KI-Systeme entwickeln und einsetzen, würden sich möglicherweise weniger verantwortlich fühlen.

Alternative Lösungsansätze für die Verantwortungsfrage

Es gibt bessere Wege, Haftungsfragen zu klären. Experten schlagen mehrere Modelle vor:

| Lösungsansatz | Wie es funktioniert | Vorteile | Herausforderungen |

|---|---|---|---|

| Gefährdungshaftung | Der Betreiber haftet automatisch für Schäden, egal ob er schuld ist | Klare Verantwortung, starke Anreize zur Sicherheit | Kann zu hohen Versicherungskosten führen |

| Versicherungsmodelle | Spezielle Versicherungen decken KI-bedingte Schäden ab | Finanzieller Schutz für Geschädigte, Risiko verteilt | Versicherungen müssen neue Risiken bewerten lernen |

| Klare menschliche Haftung | Entwickler, Betreiber oder beide tragen Verantwortung | Behält moralische Verantwortung bei Menschen, klar zugeordnet | Kann schwierig sein zu bestimmen, wer genau haftet |

| Regulatorische Aufsicht | Behörden überwachen KI-Systeme und setzen Standards durch | Gesellschaftlicher Schutz, vorausschauend statt reaktiv | Erfordert Fachwissen und Ressourcen bei Regulierern |

Das klügste Modell verbindet diese Ansätze. Es behält menschliche Verantwortung an erster Stelle. Die E-Person KI bleibt eine Idee für Zukunftsdiskussionen, nicht für heute.

Wir brauchen klare Regeln, wer für KI-Systeme verantwortlich ist und wie Schäden ausgeglichen werden.

Sie sehen: Die Frage nach der elektronischen Person ist nicht nur eine Rechtsfrage. Sie berührt, wie wir Verantwortung in der Gesellschaft verstehen. Sie zeigt, dass technologischer Fortschritt Grenzen braucht.

Wir müssen klug entscheiden, welche Funktionen wir an Maschinen delegieren und welche wir als Menschen behalten müssen. Die Maschinen Verantwortung an Maschinen zu geben, würde uns genau davon ablenken.

Governance als Schlüssel: Wie Unternehmen KI-Ethik praktisch umsetzen

Ein gut durchdachtes Governance-Programm ist wichtig für verantwortungsvolle KI in Unternehmen. Es hilft, den gesamten Lebenszyklus der KI zu überwachen und zu steuern. Durch klare Richtlinien und Prozesse entsteht Transparenz und Verlässlichkeit.

Alle Beteiligten müssen wissen, was von ihnen erwartet wird. Ein effektives KI Governance Framework gibt Ihrem Unternehmen die Macht, ethische Standards zu setzen. So bauen Sie Vertrauen bei Kunden, Partnern und Stakeholdern auf.

Strukturen, Prozesse und Schulungen für verantwortungsvolle KI

Die Umsetzung von KI-Ethik beginnt mit klaren Strukturen. Ein KI-Ethik-Komitee ist wichtig, um Entscheidungen zu treffen und Standards zu setzen. Dieses Komitee sollte aus Vertretern aus verschiedenen Bereichen bestehen.

Es ist wichtig, Rollen und Verantwortlichkeiten klar zu definieren:

- KI-Ethik-Beauftragte als Ansprechpartner und Koordinatoren

- Projektleiter mit Verantwortung für ethische Bewertung

- Datenverantwortliche für Datenschutz und Qualität

- Compliance-Officer zur Überwachung von Richtlinien

Schulungen sind entscheidend für die verantwortungsvolle Nutzung von KI. Ihr Team muss die ethischen Fragen bei KI-Projekten verstehen. Trainieren Sie sie in folgenden Bereichen:

- Grundlagen ethischer KI und Bias-Erkennung

- Datenschutz und DSGVO-Konformität

- Transparenz und Erklärbarkeit von KI-Systemen

- Risikobewertung und Compliance-Anforderungen

Entwickeln Sie interne Richtlinien für die KI-Entwicklung. Diese sollten Anforderungen für jede Projektphase enthalten. Implementieren Sie Freigabeverfahren, die sicherstellen, dass nur ethisch vertretbare Systeme in den Betrieb gehen.

Kontinuierliche Überwachung des gesamten KI-Lebenszyklus

KI Governance ist kein einmaliges Projekt. Es erfordert kontinuierliche Überwachung vom Konzept bis zum Betrieb und darüber hinaus. Jede Phase des Lebenszyklus braucht Kontrolle und Bewertung.

| KI-Lebenszyklus Phase | Überwachungsfokus | Verantwortlicher Bereich |

|---|---|---|

| Planung und Design | Folgenabschätzung, Stakeholder-Analyse | Projektmanagement und Ethik-Komitee |

| Datenbeschaffung | Datenqualität, Bias-Risiken, Datenschutz | Datenverantwortliche und Compliance |

| Entwicklung und Training | Algorithmen-Überprüfung, Testverfahren | Entwicklungsteam mit Ethik-Oversight |

| Deployment | Sicherheitsprüfungen, Freigabeverfahren | Sicherheits- und Compliance-Team |

| Betrieb und Wartung | Performance-Monitoring, Abweichungsprüfung | Betriebsteam mit regelmäßigen Audits |

Implementieren Sie Monitoring-Systeme, die Ihre KI-Modelle laufend überwachen. Prüfen Sie regelmäßig, ob die Systeme noch ethischen Standards entsprechen. Bias, Fehlerquoten und unerwartete Effekte können sich im Betrieb zeigen.

Etablieren Sie Eskalationsmechanismen für Probleme. Wenn eine KI-Anwendung ethische Bedenken aufwirft, brauchen Sie schnelle Reaktionsprozesse. Dokumentieren Sie alle Entscheidungen und Maßnahmen transparant.

Das KI Governance Framework ist Ihr Werkzeug für nachhaltige Verantwortung. Durch strukturierte Governance zeigen Sie Ihren Stakeholdern, dass Sie KI bewusst und verantwortungsvoll einsetzen. Dies stärkt Ihr Vertrauen und schafft Wettbewerbsvorteile in einer von KI-Ethik getriebenen Zukunft.

Chancen ethischer KI: Vertrauen, Innovation und nachhaltige Wettbewerbsvorteile

Ethische KI ist nicht ein Hindernis, sondern ein Schlüssel zum Erfolg. Sie hilft, KI erfolgreich einzusetzen und nachhaltig zu wachsen. Wenn Sie KI als Werkzeug sehen, das ethisch und menschlich orientiert ist, entstehen neue Chancen.

Die ethische KI Vorteile starten mit Vertrauen. KI-Systeme, die vertrauenswürdig sind, stärken Beziehungen zu Kunden, Partnern und Mitarbeitern. Menschen vertrauen Technologien, die sie verstehen und nachvollziehen können.

Verantwortungsvolle KI fördert Innovation. Sie schafft Lösungen, die heute und morgen funktionieren. So entwickeln Sie Produkte und Dienstleistungen, die echte Probleme lösen und sozial verantwortlich sind.

Vertrauenswürdige KI Chancen bringen messbare Vorteile. Ein solider KI Wettbewerbsvorteil zeigt sich in:

- Bessere Reputation und Markenimage in Ihrer Industrie

- Geringere rechtliche Risiken und Compliance-Kosten

- Höhere Mitarbeitendenzufriedenheit und Bindung

- Zugang zu ethisch orientierten Märkten und Investoren

- Stärkere Kundenbeziehungen durch Transparenz

| Bereich | Vorteil ethischer KI | Geschäftlicher Nutzen |

|---|---|---|

| Kundenvertrauen | Transparente Entscheidungsfindung | Höhere Conversion-Raten und Kundenloyalität |

| Mitarbeiterengagement | Faire und diskriminierungsfreie Systeme | Bessere Leistung und niedrigere Fluktuation |

| Innovation | Fokus auf nachhaltige Lösungen | Neue Märkte und Geschäftsmodelle |

| Rechtliche Sicherheit | Compliance mit DSGVO und EU AI Act | Vermeidung von Bußgeldern und Reputationsschaden |

| Wettbewerbsposition | Verantwortungsvolle KI-Nutzung | Differenzierung vom Wettbewerb |

Nachhaltige KI schafft langfristigen Wert. Sie berücksichtigt Umwelt, Gesellschaft und Wirtschaft. So werden Sie ein Vorreiter in Ihrer Branche.

Der KI Wettbewerbsvorteil kommt von technischer Exzellenz und ethischer Verantwortung. Unternehmen, die dies tun, gewinnen die besten Talente und Kunden. Seien Sie ein Pionier für eine vertrauenswürdige KI-Zukunft.

Ihre Investition in ethische KI sichert die Zukunft Ihres Unternehmens. Starten Sie jetzt, KI-Ethik als strategischen Erfolg zu sehen. Inspirieren Sie Ihre Branche mit verantwortungsvoller Innovation.

Datenschutz und Privatsphäre: DSGVO-konforme KI-Systeme entwickeln

Der Schutz persönlicher Daten ist bei der Entwicklung von KI sehr wichtig. Der EU AI Act verlangt, dass KI-Systeme die DSGVO erfüllen müssen. Das bedeutet, dass Datenschutz bei KI nicht wegzudenken ist.

KI-Systeme verarbeiten viel Daten und treffen Entscheidungen über Menschen. Das bringt besondere Herausforderungen mit sich. Die Gefahr, dass vermeintlich anonymisierte Daten identifiziert werden können, steigt.

Die Prinzipien Privacy by Design und Privacy by Default sind wichtig. Sie müssen Datenschutz schon in der Planungsphase berücksichtigen. Eine umfassende Datenschutz-Folgenabschätzung hilft, Risiken früh zu erkennen.

Praktische Maßnahmen für DSGVO-konforme KI umfassen:

- Datensparsamkeit: Nur notwendige Daten erfassen und verarbeiten

- Pseudonymisierung: Persönliche Daten von Identifikatoren trennen

- Sichere Datenspeicherung: Verschlüsselung und Zugriffskontrolle implementieren

- Transparenzverpflichtungen: Betroffene über automatisierte Entscheidungen informieren

- Auskunftsrechte: Systeme so gestalten, dass Anfragen schnell beantwortet werden können

Bei der DSGVO KI müssen Sie auch die Rechtsgrundlage beachten. Einwilligung, berechtigte Interessen oder gesetzliche Verpflichtungen müssen klar sein. Das Recht auf Erklärung automatisierter Entscheidungen nach der DSGVO ist wichtig.

Datenschutz bei KI ist nicht nur eine Pflicht. Es schafft Vertrauen bei Nutzern und gibt einen Wettbewerbsvorteil. Unternehmen, die DSGVO-konforme KI entwickeln, zeigen Verantwortung und Sicherheitsbewusstsein.

Starten Sie heute mit einer Bestandsaufnahme Ihrer KI-Projekte. Überprüfen Sie die Rechtsgrundlagen und dokumentieren Sie Ihre Datenflüsse. So sichern Sie Ihre Systeme für die Zukunft.

Fazit

Künstliche Intelligenz ist mehr als nur Technik. Sie bringt uns vor große ethische und gesellschaftliche Fragen. Diese Fragen müssen wir aktiv angehen.

Es gibt viele Herausforderungen. Zum Beispiel Bias, Diskriminierung, mangelnde Transparenz und Verantwortungslücken. Aber es gibt auch Lösungen für diese Probleme.

Die Zukunft der KI hängt von drei Säulen ab. Erste Säule: ethische Prinzipien, die den Menschen zentrieren. Zweite Säule: klare Gesetze wie der EU AI Act. Dritte Säule: Governance-Strukturen in Organisationen.

Ein umfassendes Governance-Programm ist wichtig. Es bildet die Basis für Ihre Strategie. Transparenz, Überwachung und Zusammenarbeit sind dabei unerlässlich.

Die ethische Implementierung von KI ist eine Chance, nicht nur eine Pflicht. Sie schafft Vertrauen bei Kunden, Mitarbeitern und der Gesellschaft. Sie sichern langfristige Vorteile und machen Sie zum Vorreiter.

Starten Sie jetzt. Verankern Sie ethische Prinzipien in Ihrer Organisation. Bauen Sie Governance-Strukturen auf. Schulen Sie Ihre Teams ständig weiter. So gestalten Sie die Zukunft der KI selbst.