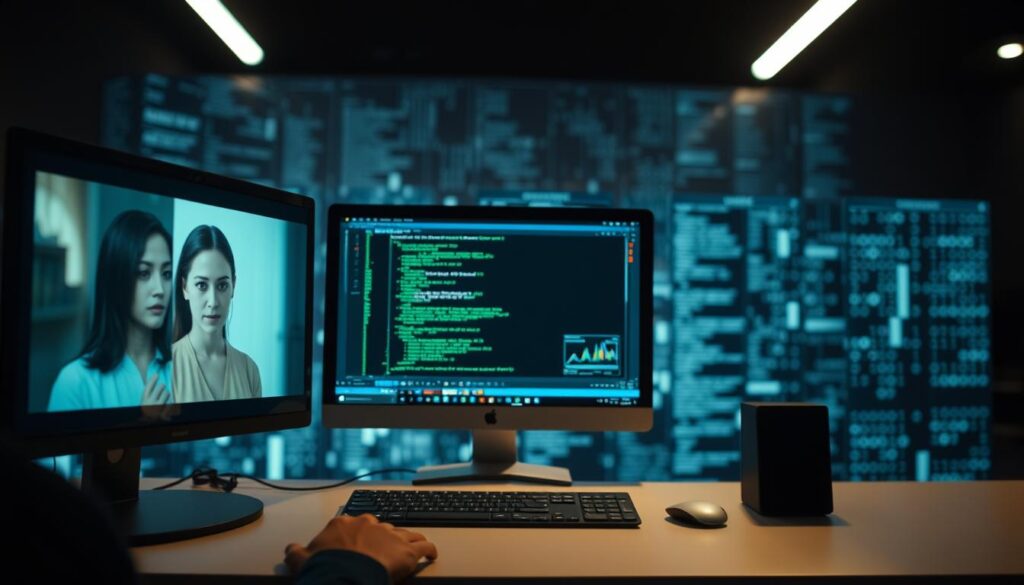

Deepfakes erkennen und absichern mit KI

Können Sie wirklich wissen, ob das Video Ihres CEO echt ist? Viele Menschen haben Zweifel. Neue Technologien lassen uns Gesichter tauschen und Stimmen klonen. Was einst unmöglich schien, ist heute möglich.

Die Zahlen sind alarmierend: 98 Prozent der Menschen erkennen KI Deepfakes nicht sofort. Das bedeutet, fast jeder kann auf eine Fälschung hereingehen. Es ist wichtig, dass Unternehmen und Einzelpersonen sich dieser Gefahr bewusst sind.

Deepfake erkennen wird eine wichtige Fähigkeit. Mit nur 20 Sekunden Audiomaterial können Kriminelle Ihre Stimme perfekt imitieren. Diese Technologie bedroht die Sicherheit von Unternehmen weltweit. Betrugsfälle mit gefälschten Gesichtern bei Identitätsprüfungen sind um 704 Prozent gestiegen.

Cyber-Sicherheit in der modernen Arbeitswelt geht über Passwörter und Firewalls hinaus. Es geht darum, zu verstehen, wie künstliche Intelligenz missbraucht werden kann. So können Sie Ihre Organisation wirksam schützen.

Dieser Leitfaden erklärt, wie KI Deepfakes entstehen. Sie lernen, gefälschte Videos und Audio-Aufnahmen zu erkennen. Wir zeigen Ihnen praktische Strategien, um Ihre Daten und Ihre Reputation zu schützen.

Wichtige Erkenntnisse

- 98 Prozent der Menschen erkennen professionelle Deepfakes nicht unmittelbar

- 20 Sekunden Audiomaterial reichen aus, um eine realistische Stimme zu klonen

- Deepfake-Betrugsfälle bei der Identitätsprüfung sind um 704 Prozent angestiegen

- KI-basierte Erkennungsmethoden sind der Schlüssel zur Abwehr

- Schulung und technische Schutzmaßnahmen schützen Ihr Unternehmen

- Rechtliche Rahmenbedingungen sind noch im Aufbau

- Verstehen Sie KI-Technologien, um zukunftssicher zu bleiben

Was sind KI Deepfakes und wie funktionieren sie

Deepfakes sind eine spannende und gleichzeitig beunruhigende Entwicklung in der KI. Sie kombinieren “Deep Learning” mit “Fake”. Dadurch entstehen synthetische Medien, die durch fortschrittliche KI-Modelle erstellt werden. Diese Technologie kann realistische Videos, Bilder und Audioaufnahmen erzeugen, die sehr echt wirken.

Unser Ziel ist es, Ihnen alles Wichtige über Deepfakes zu erklären. So können Sie diese Technologie besser verstehen und ihre Auswirkungen einschätzen.

Deepfakes analysieren Tausende von Bildern oder Videos einer Person. Dabei lernen sie subtile Muster zu erkennen. Dazu gehören Gesichtsbewegungen, Stimmmerkmale, Körperhaltung und Lichtreflexionen.

Diese Details werden in mathematische Modelle umgewandelt. So können neue, täuschend echte Inhalte generiert werden.

Definition und technologische Grundlagen von Deepfakes

Deepfakes entstehen durch spezialisierte KI-Systeme. Diese Systeme nachahmen menschliche Erscheinungsbilder und Verhalten. Die Tiefe dieser Netzwerke ermöglicht es, Muster zu erkennen, die unsichtbar für das menschliche Auge sind.

Das “Deep” im Deep Learning bezieht sich auf die vielen Schichten dieser künstlichen Netzwerke.

- Umfassende Datenanalyse von Bildmaterial und Videoaufnahmen

- Erfassung feiner Gesichtszüge und Ausdrücke

- Lernen von Sprachmuster und Intonation

- Nachbildung körperlicher Bewegungsabläufe

Generative Adversarial Networks (GANs) als Kerntechnologie

Die Deepfake-Technologie basiert auf einem revolutionären Konzept. Zwei künstliche Netzwerke treten gegeneinander an. Ein System erzeugt Fälschungen, während das andere deren Authentizität überprüft.

Diese gegenseitige Optimierung führt zu immer überzeugenderem Ergebnis.

| Komponente | Aufgabe | Entwicklung |

|---|---|---|

| Generator | Erstellt synthetische Inhalte und Fälschungen | Verbessert sich mit jeder Iteration |

| Diskriminator | Bewertet Echtheit der generierten Inhalte | Wird kritischer und anspruchsvoller |

| Feedback-Schleife | Treibt beide Systeme zu besserer Performance | Erzeugt realistische Ergebnisse |

Deep Learning und neuronale Netze im Deepfake-Prozess

Das maschinelle Lernen funktioniert durch wiederholte Anpassung. Der Generator erhält Rückmeldungen vom Diskriminator. Er optimiert seine Ausgabe über Hunderte oder Tausende von Durchläufen.

Dieser Prozess wiederholt sich, bis die Inhalte vom Diskriminator nicht mehr von echten Materialien unterschieden werden können.

Die Tiefe neuronaler Netze ermöglicht es, extrem subtile Merkmale zu erfassen. Ein solches System kann lernen, wie Licht auf Haut fällt, wie sich Muskeln unter der Oberfläche bewegen und wie natürliche Übergänge zwischen Gesichtsausdrücken aussehen.

Diese Detailgenauigkeit macht Deepfakes so täuschend realistisch.

Ihr Verständnis dieser technologischen Grundlagen bildet die Basis für alle Schutzmaßnahmen. Wir behandeln diese in den folgenden Abschnitten. Dieses Wissen befähigt Sie, die Bedrohungen richtig einzuordnen und wirksam dagegen vorzugehen.

Verschiedene Arten von Deepfake-Manipulationen

Die Welt der KI-Fälschungen hat sich stark verändert. Früher brauchte man teure Ausrüstung, heute reicht oft eine einfache Software. Es gibt drei Hauptarten von Deepfakes. Jede erfordert spezielle Techniken und Strategien, um sie zu erkennen.

- Visuelle Manipulation – Gesichtertausch und Mimik-Veränderungen in Videos und Bildern

- Audio-Manipulation – synthetische Stimmen und Stimmkonvertierungen

- Text-basierte Fälschungen – KI-generierte Nachrichten und Dokumente

Kombinierte Angriffe sind besonders gefährlich. Sie kombinieren Video, Audio und Text. So entsteht eine überzeugende Fälschung.

Um sich zu schützen, müssen Sie die Technologien und Schwierigkeiten der Deepfakes kennen. Die Einfachheit der Technologie bedeutet, dass professionelle Fälschungen möglich sind.

| Manipulationsform | Haupttechnologie | Erkennungsaufwand | Bedrohungslevel |

|---|---|---|---|

| Gesichts-Deepfakes | Face Swapping, GANs | Mittel bis Hoch | Hoch |

| Stimmen-Deepfakes | Text-to-Speech, Voice Conversion | Mittel | Mittel bis Hoch |

| Text-Fälschungen | Sprachmodelle, KI-Generierung | Niedrig bis Mittel | Mittel |

| Kombinierte Angriffe | Multi-Modal-Synthese | Sehr Hoch | Kritisch |

In den nächsten Abschnitten erfahren Sie mehr über die einzelnen Deepfake-Arten. So können Sie effektive Schutzmaßnahmen für Ihr Unternehmen entwickeln. Es ist wichtig, die Bedrohungslandschaft im Ganzen zu verstehen.

Fälschung von Gesichtern durch Face Swapping und Face Reenactment

Die Manipulation von Gesichtern ist eine der gefährlichsten Deepfake-Technologien. Wir erklären, wie Face Swapping und Face Reenactment funktionieren. Diese Technologien können Videos so täuschend echt machen, dass sie fast nicht zu unterscheiden sind.

Die Techniken sind schnell und einfach zugänglich. Moderne Grafikkarten erreichen Full-HD bis 4K. Sie arbeiten teilweise in Echtzeit und gefährden so Live-Videokonferenzen und digitale Authentifizierungsprozesse.

Face Swapping: Gesichtertausch in Videos

Face Swapping tauscht Gesichter in Videos aus. Ein Autoencoder-Verfahren nimmt Mimik und Beleuchtung von einem Gesicht und überträgt sie auf ein anderes. Für das Training braucht man nur 2 bis 5 Minuten Videomaterial.

- Minimaler Datenbedarf für das Training

- Hohe Videoqualität in Echtzeit möglich

- Automatische Anpassung von Hautfarben und Beleuchtung

- Funktioniert mit handelsüblichen Grafikkarten

Face Swapping ist einfach einsetzbar. Angreifer brauchen nur wenige Videoclips, um überzeugende Fälschungen zu erstellen.

Face Reenactment: Manipulation von Mimik und Kopfbewegungen

Face Reenactment geht über einfachen Gesichtertausch hinaus. Es erstellt ein 3D-Modell des Zielgesichts und ermöglicht die vollständige Kontrolle über Kopfposition, Mimik und Lippenbewegungen. Ein Angreifer kann einem Opfer Sätze in den Mund legen, die es nie gesprochen hat.

Die Gesichtsmanipulation durch Face Reenactment bietet präzise Steuerung:

- Erfassung des 3D-Gesichtsmodells

- Manipulation der Kopfposition und Neigung

- Steuerung von Mimik und Blickrichtung

- Kontrolle von Lippenbewegungen und Synchronisation

Die Authentizität dieser Fälschungen ist erschreckend. Selbst Experten können solche manipulierten Videos auf den ersten Blick nicht erkennen.

Synthetisierung neuer Pseudo-Identitäten

Die dritte Bedrohung sind vollständig künstlich erzeugte Gesichter. Neuronale Netze generieren neue Pseudo-Identitäten, die in der Realität nicht existieren. Diese synthetischen Personen ermöglichen Fake-Accounts und Social-Engineering-Angriffe ohne echtes Opfer.

| Manipulationstyp | Trainingsmaterial | Kontrolle | Anwendungsrisiko |

|---|---|---|---|

| Face Swapping | 2-5 Minuten Video | Begrenzt | Identitätsdiebstahl |

| Face Reenactment | Längeres Material nötig | Vollständig | Falsche Aussagen |

| Synthetische Identitäten | Kein echtes Material | Unbegrenzt | Betrug und Betrug |

Synthetische Identitäten sind besonders tückisch, da keine echte Person widersprechen kann. Kriminelle nutzen sie für Catfishing, Geldwäsche und organisierte Betrügereien.

Die Kombination aus Face Swapping, Face Reenactment und Gesichtsmanipulation schafft ein perfektes Ökosystem für Betrug. Traditionelle Sicherheitsmechanismen bieten keinen ausreichenden Schutz mehr. Biometrische Systeme, die auf Gesichtserkennung basieren, werden durch diese Technologien gezielt überlistet.

Im nächsten Abschnitt erfahren Sie, wie KI auch Stimmen manipuliert und welche Szenarien durch die Kombination von Bild- und Audio-Deepfakes entstehen.

Manipulation von Stimmen mittels KI-Technologie

Die Manipulation von Stimmen ist eine der gefährlichsten Formen von Audio-Deepfakes. Angreifer können Ihre Stimme mit moderner KI-Technologie täuschend echt nachahmen. Es gibt zwei Hauptverfahren: Text-to-Speech-Systeme und Voice Conversion. Diese Technologien bedrohen traditionelle Sicherheitsmechanismen wie Telefonauthentifizierung und biometrische Spracherkennung.

Text-to-Speech-Verfahren zur Stimmenerzeugung

Text-to-Speech wandelt geschriebenen Text in natürlich klingende Sprache um. Es nutzt tiefe neuronale Netze, um Ihre Stimmeigenschaften zu lernen. Moderne Systeme benötigen nur 20 Sekunden Audiomaterial für grundlegende Ergebnisse. Für täuschend echte Stimmenkopien trainieren die Algorithmen mit mehreren Stunden Ihrer Aufnahmen.

Diese Audioaufnahmen stammen oft aus öffentlichen Quellen:

- Interviews und Podcasts

- Videokonferenzen und Webinare

- Soziale Medien und YouTube-Videos

- Geschäftspräsentationen

- Pressemitteilungen

Die Voice Cloning Technologie wird immer präziser. Systeme wie Speechify zeigen, wie schnell realistische Sprachmodelle entstehen. Ein Angreifer kann damit persönliche Nachrichten, Anrufe oder Befehle in Ihrer Stimme erstellen.

Voice Conversion: Konvertierung vorhandener Audiodaten

Voice Conversion arbeitet nach einem anderen Prinzip. Diese Technik nimmt eine bestehende Audioaufnahme und wandelt nur die Stimme um. Der semantische Inhalt bleibt unverändert. Ein Krimineller kann seine eigene Nachricht aufnehmen und diese in Ihre Stimme konvertieren.

Der Prozess funktioniert in mehreren Schritten:

| Prozessschritt | Beschreibung | Sicherheitsrisiko |

|---|---|---|

| Audioaufnahme | Aufnahme der Ausgangsstimme (kann jede Person sein) | Leicht durchzuführen |

| Stimmmerkmale extrahieren | KI analysiert Tonhöhe, Tempo und Akzent | Hochpräzise Analyse möglich |

| Zielstimme anpassen | Merkmale werden auf Ihre Stimme übertragen | Täuschend echte Ergebnisse |

| Audio-Ausgabe | Neue Aufnahme in Ihrer Stimme entsteht | Für Menschen kaum erkennbar |

Diese Stimmenfälschung bedroht insbesondere telefonische Authentifizierungssysteme. Sprechen Sie mit Ihrem IT-Team über KI-Tools zum Transkribieren von Meetings und, um potenzielle Sicherheitslücken zu identifizieren.

Text-to-Speech und Voice Conversion täuschen sowohl Menschen als auch automatische Erkennungssysteme. Deshalb müssen Sie Ihre Sicherheitsprotokolle grundlegend überdenken. Telefonate und Sprachnachrichten gelten nicht länger als sichere Kommunikationsmittel.

Die Bedrohung wächst täglich. Sie benötigen mehrschichtige Sicherheitsmaßnahmen, um diese modernen Angriffsmethoden abzuwehren.

KI-generierte Textfälschungen und deren Einsatzbereiche

Deepfakes sind nicht nur in Bildern und Videos zu finden. KI-Textgenerierung ist eine große Gefahr. Moderne Sprachmodelle können aus wenigen Worten lange Texte machen, die echt wirken.

Diese Technologie nutzt tiefe neuronale Netze und große Datenmengen. So kann sie menschliche Schreibstile perfekt nachahmen.

KI-Textgenerierung hat viele Anwendungsbereiche. Man kann damit E-Mails, Blog-Artikel, Social-Media-Posts und Chat-Antworten schnell erstellen. Besonders gefährlich sind Chatbots und Social Bots. Sie können wie echte Menschen sprechen und Desinformation verbreiten.

- Personalisierte Phishing-E-Mails mit überzeugenden Inhalten

- Gefälschte Kundenrezensionen und Bewertungen

- Manipulative Social-Media-Kampagnen und Beiträge

- Täuschend echte automatisierte Kundenservice-Gespräche

- Gefälschte Nachrichtenartikel und Blog-Posts

Früher brauchte man Supercomputer, heute reicht Cloud-Dienste. Die Zugänglichkeit dieser Ressourcen wächst ständig. Textbasierte Angriffe sind besonders gefährlich, weil sie keine visuellen oder akustischen Warnsignale geben.

| Angriffstyp | Beschreibung | Erkennungsschwierigkeit |

|---|---|---|

| Chatbots | Automatisierte Gespräche zur Täuschung und Informationsbeschaffung | Sehr hoch |

| Social Bots | Fiktive Profile zur Verbreitung von Desinformation | Hoch |

| Phishing-E-Mails | Täuschend echte Nachrichten für Datenbeschaffung | Mittel bis hoch |

| Gefälschte Rezensionen | KI-generierte Bewertungen zur Markenmanipulation | Hoch |

Schützen Sie Ihre Kommunikationswege vor textbasierten Manipulationen. Lernen Sie, KI-generierte Texte zu erkennen. Diese Fähigkeit ist für Führungskräfte in der digitalen Welt unverzichtbar. Sie schützt Ihr Unternehmen vor teuren Sicherheitsverletzungen.

Bedrohungsszenarien durch Deepfake-Technologie

Deepfake-Technologien sind heute eine große Gefahr für Firmen. Sie gehen über einfache Cyberangriffe hinaus. Wir erklären, welche Risiken Ihr Unternehmen trägt.

Die Zahlen sind klar: 92 Prozent der Führungskräfte sind besorgt über den Missbrauch von KI. Dieses Problem ist real und die Methoden werden immer besser.

Überwindung biometrischer Sicherheitssysteme

Biometrische Sicherheit war einst sicher. Doch Deepfakes verändern das. Gesichts- und Spracherkennung können täuschen lassen.

Bei Fernidentifikationen haben Angreifer leichtes Spiel. Sie kontrollieren alles. Manipulierte Videos und Audio passieren unentdeckt durch.

- Gesichtserkennungssysteme erkennen manipulierte Gesichtszüge nicht zuverlässig

- Sprechererkennung wird durch KI-generierte Stimmen überwunden

- Videoidentifikation scheitert bei professionell erstellten Deepfakes

- Remote-Verfahren bieten Angreifern maximale Kontrolle

Social Engineering und Spear-Phishing-Angriffe

Social Engineering wird durch Deepfake-Betrug effektiver. Angreifer nutzen gefälschte Videos und Sprachnachrichten, um Mitarbeiter zu täuschen.

Spear-Phishing-Angriffe werden durch Deepfakes besser. Ein gefälschtes Videoanruf vom CEO wirkt überzeugender als jede E-Mail. Die Wirkung auf die Mitarbeiter ist stark.

- Gefälschte Videobotschaften von Führungskräften erzielen höhere Erfolgsquoten

- Manipulierte Audiomitteilungen wirken authentisch und vertrauenswürdig

- Kombinierte Angriffe mit Text, Bild und Video sind schwer zu durchschauen

- Mitarbeiter können Authentizität kaum noch überprüfen

CEO-Fraud und finanzielle Betrugsfälle

CEO-Fraud ist besonders gefährlich. Ein Mitarbeiter erhält einen Anruf, angeblich vom Chef. Er wird aufgefordert, Geld zu überweisen oder Daten freizugeben.

Die Zahlen zeigen das Schadenspotenzial:

| Vorfall | Jahr | Schaden | Organisation |

|---|---|---|---|

| Bankraub Dubai | 2020 | 35 Millionen Dollar | Internationale Bank |

| Energiekonzern UK | 2019 | 220.000 Euro | Britischer Energieversorger |

Diese Zahlen sind keine Theorie. Sie zeigen echte Verluste durch Deepfake-Betrug. Die Täter nutzen gefälschte Stimmen und Videos, um zu täuschen.

CEO-Fraud basiert auf bewährten Methoden. Deepfakes machen diese Angriffe jedoch viel effizienter. Die Opfer glauben oft, es sei echt.

Sie müssen wissen: Diese Bedrohungen sind real und jetzt. Ihr Unternehmen braucht heute Schutz gegen diese neuen Angriffe. Warten ist keine Option.

Typische Erkennungsmerkmale von Video-Deepfakes

Die Erkennung von Video-Deepfakes beginnt mit dem Auge. Sie können selbst erkennen, was nicht stimmt. KI-Systeme hinterlassen Spuren, die man sieht.

Sichtbare Übergänge und Hautfarbenunterschiede

Bei Video-Deepfakes sieht man oft sichtbare Übergänge. Diese zeigen sich besonders am Kopf.

- Farbliche Sprünge in der Hautstruktur

- Ungleichmäßige Beleuchtung an den Kanten

- Doppelte oder unscharfe Haarlinien

- Gespiegelte Augenbrauen oder Fehler in der Symmetrie

Die KI passt Beleuchtung und Hautstruktur nicht immer richtig an. Achten Sie besonders auf den Nackenbereich und die Ohrenkanten.

Unnatürliche Augenbewegungen und fehlende Mimik

Die Augen verraten Deepfakes am häufigsten. Achten Sie auf diese Warnsignale:

- Fehlende oder zu regelmäßige Blinzelbewegungen

- Starrer, ausdrucksloser Blick ohne natürliche Bewegung

- Augen, die Kopfbewegungen nicht flüssig folgen

- Starre Mimik ohne spontane Gesichtsausdrücke

Die Erkennung wird einfacher, wenn Sie auf mangelnde emotionale Reaktionen achten. Echte Menschen zeigen natürliche Ausdrucksbewegungen.

Verwaschene Konturen bei Zähnen und Details

Feine Details fallen Video-Deepfakes schwer. Prüfen Sie diese Bereiche:

- Zähne erscheinen verschwommen oder verzerrt

- Einzelne Haare wirken geklebt oder undefiniert

- Wimpern sind künstlich oder völlig fehlend

- Ohren zeigen Proportionsfehler oder fehlerhafte Strukturen

Die KI hat Schwierigkeiten mit extremen Gesichtsausdrücken und Profilansichten. Nutzen Sie diese Schwächen bei Ihrer visuellen Inspektion.

| Erkennungsmerkmal | Häufigkeit bei Deepfakes | Schweregrad |

|---|---|---|

| Sichtbare Übergänge und Hautfarbunterschiede | Sehr häufig | Mittel bis hoch |

| Unnatürliche Augenbewegungen | Extrem häufig | Hoch |

| Fehlende oder starre Mimik | Sehr häufig | Hoch |

| Verwaschene Zähne und Haare | Häufig | Mittel |

| Fehlerhafte Wimpern und Ohren | Häufig | Mittel bis hoch |

Diese manuelle Überprüfung ist Ihre erste Verteidigungslinie. Sie benötigen keine technischen Tools und können sofort reagieren. Die Fähigkeit zur visuellen Inspektion befähigt Sie, kritischer mit Videoinhalten umzugehen und Manipulationen schneller zu erkennen.

Audio-Deepfakes identifizieren: Artefakte und Warnsignale

Audio-Deepfakes sind eine große Gefahr. Sie sehen oft nicht so, wie sie sind. Aber Ihr Gehör kann helfen, sie zu erkennen. Wenn Sie wissen, was zu suchen ist, können Sie sie finden.

Es gibt typische Fehler, die man hören kann. Diese Fehler verraten, ob es sich um einen echten oder gefälschten Ton handelt.

Charakteristische Merkmale manipulierter Audioaufnahmen sind leicht zu erkennen. Achten Sie auf diese Anzeichen:

- Metallischer oder roboterhafter Klang: KI-generierte Stimmen klingen oft metallisch. Sie klingen unnatürlich und mechanisch.

- Aussprachefehler: Fremdsprachige Wörter oder ungewöhnliche Namen sind oft falsch. Das System kennt diese nicht gut.

- Monotone Betonung: Echte Stimmen haben Tonhöhen und Intensität. Audio-Deepfakes klingen flach und eintönig.

- Fehlende emotionale Nuancen: Natürliche Pausen, Lachen oder Seufzer fehlen. Sie wirken erzwungen.

- Unnatürliche Sprechweise: Akzente und Sprechrhythmen passen nicht zur Person. Die Replizierung ist ungenau.

- Merkwürdige Stille: Unregelmäßige Pausen zeigen, dass es sich um eine Fälschung handelt.

- Zeitverzögerungen: Hochwertige Fälschungen haben kleine Verzögerungen durch semantische Kontextverarbeitung.

Die folgende Übersicht zeigt typische Audio-Artefakte und ihre Erkennungsrate:

| Audio-Artefakt | Erkennungsmerkmale | Häufigkeit bei Deepfakes | Erkennungsschwierigkeit |

|---|---|---|---|

| Metallischer Sound | Künstlicher, roboterhafter Tonanstieg | Sehr häufig | Leicht zu erkennen |

| Aussprachefehler | Fehlerhafte Aussprache fremdsprachiger Wörter | Häufig | Leicht zu erkennen |

| Monotone Betonung | Flache, eintönige Sprachausgabe ohne Variation | Sehr häufig | Mittel |

| Fehlende Emotionen | Mangelnde natürliche Pausen und Nuancen | Häufig | Mittel |

| Falsche Sprechweise | Nicht authentische Akzente und Rhythmen | Häufig | Mittel bis schwer |

| Unnatürliche Pausen | Unregelmäßige oder zu lange Stille | Gelegentlich | Mittel |

| Verarbeitungsverzögerung | Minimale Zeitverzögerung bei hochwertigen Fälschungen | Selten | Schwer zu erkennen |

Praktische Techniken zur Identifikation von Audio-Deepfakes:

- Hören Sie Aufnahmen in ruhiger Umgebung mehrmals an. Erste Eindrücke täuschen.

- Vergleichen Sie verdächtige Aufnahmen mit authentischen Sprachproben der gleichen Person.

- Achten Sie auf Konsistenz in Tonqualität, Akzent und Sprechmuster während der gesamten Aufnahme.

- Nutzen Sie Kopfhörer für bessere Wahrnehmung feiner Audio-Artefakte.

- Überprüfen Sie den Kontext: Wann entstand die Aufnahme? Unter welchen Bedingungen?

Das geschulte Gehör bleibt ein mächtiges Werkzeug. Sie lernen, authentische Stimmen zu erkennen. So schützen Sie sich vor gefälschten Audioaufnahmen und bewahren die Integrität von Sprachnachrichten.

Automatisierte Erkennungsmethoden und KI-basierte Detektionssysteme

Bei der großen Menge an digitalen Inhalten wird manuelle Analyse schnell schwierig. Automatisierte Systeme sind eine vielversprechende Lösung. Sie nutzen künstliche Intelligenz, um Fälschungen zu entlarven. Wir erklären, welche Methoden funktionieren und wo die Grenzen liegen.

Bei der Erkennung von Deepfakes gibt es zwei Hauptmethoden. Experten untersuchen digitale Spuren mit speziellen Verfahren. Gleichzeitig trainieren Entwickler intelligente Maschinen, um verdächtige Inhalte selbstständig zu erkennen.

Medienforensische Analyseverfahren

Die medienforensische Analyse arbeitet wie ein digitaler Detektiv. Sie sucht nach unsichtbaren Spuren, die bei Manipulationen entstehen:

- Kompressionsmuster in Bilddaten

- Metadaten-Inkonsistenzen

- Statistische Anomalien im Pixelaufbau

- Frequenzanalysen von Audioinhalten

- Zeitstempel-Widersprüche

Fachleute können mit diesen Techniken Fälschungen nachvollziehbar identifizieren und dokumentieren. Die medienforensische Analyse liefert bewiesbare Ergebnisse für rechtliche Verfahren.

Machine Learning zur Deepfake-Erkennung

KI-Detektionssysteme nutzen die gleiche Technologie wie die Fälschungsmacher selbst. Tiefe neuronale Netze lernen aus großen Datenmengen echter und gefälschter Medien. Sie erkennen subtile Unterschiede, die dem menschlichen Auge verborgen bleiben.

| Erkennungsmethode | Genauigkeit | Stärken | Schwächen |

|---|---|---|---|

| Medienforensische Analyse | 75-85% | Nachvollziehbar, beweiskräftig | Zeitaufwändig, erfordert Fachkompetenz |

| Machine Learning Modelle | 65-75% | Automatisiert, schnell | Begrenzte Generalisierbarkeit |

| Hybridlösungen | 80-90% | Kombiniert beide Ansätze | Höhere Komplexität, mehr Ressourcen |

Die Herausforderung liegt in der mangelnden Generalisierbarkeit. Systeme funktionieren gut bei bekannten Fälschungsmethoden, versagen aber bei neuen Techniken. Das beste Modell der Deepfake Detection Challenge erreichte nur 65,18% Genauigkeit – kaum besser als Raten.

Ein weiteres Problem sind adversariale Angriffe. Fälscher fügen gezielt Rauschen hinzu, das KI-Detektionssysteme täuscht. Menschen sehen dieses Rauschen nicht, doch die Erkennungssoftware wird blind gemacht.

Automatisierte Deepfake-Erkennung bleibt ein wichtiges Werkzeug. Sie ersetzen jedoch nicht menschliche Expertise. Wir empfehlen einen mehrschichtigen Ansatz: KI-Detektionssysteme kombiniert mit medienforensischer Analyse und organisatorischen Schutzmaßnahmen schaffen erst echte Sicherheit.

Präventive Maßnahmen gegen Deepfake-Angriffe

Die beste Strategie zur Abwehr von Deepfake-Angriffen startet mit Menschen. Studien zeigen, dass viele Mitarbeiter nicht genug über Deepfake-Risiken wissen. Viele Führungskräfte kennen diese Bedrohungen gar nicht. Diese Wissenslücke ist die größte Schwachstelle in Ihrem Unternehmen.

Wir zeigen Ihnen, wie Sie Ihr Team durch gezielte Maßnahmen schützen können.

Schulung und Sensibilisierung von Mitarbeitern

Mitarbeiter, die Deepfake-Angriffe erkennen, sind Ihre erste Verteidigungslinie. Eine effektive Schulung vermittelt Wissen über Erkennungsmerkmale und Angriffsszenarien. Ihr Team lernt, verdächtige Videos und Audioinhalte zu erkennen.

Ein modernes Schulungsprogramm zur Mitarbeiterschulung umfasst:

- Regelmäßige Trainings mit realen Deepfake-Beispielen

- Simulationen von Social-Engineering- und Spear-Phishing-Angriffen

- Klare Handlungsanweisungen für verdächtige Situationen

- Monatliche Auffrischungskurse zu neuen Manipulationstechniken

- Rollen-spezifische Schulungen für Führungskräfte und Finance-Teams

Geschulte Mitarbeiter bewerten Medieninhalte differenzierter. Sie erkennen Artefakte wie unnatürliche Augenbewegungen oder verwaschene Konturen.

Kryptographische Verfahren zur Authentifizierung

Während Schulung auf menschliche Wachsamkeit setzt, bietet Technik zusätzliche Sicherheit. Digitale Signaturen und Authentifizierungsmethoden sind das technische Rückgrat Ihrer Deepfake-Abwehr. Diese digitale Authentifizierung bindet Medieninhalte eindeutig an eine Identität.

Kryptographische Sicherheitsmaßnahmen funktionieren nach diesem Prinzip:

| Verfahren | Funktionsweise | Schutzwirkung |

|---|---|---|

| Digitale Signaturen | Videos und Audios werden bei der Erstellung signiert | Manipulationen nach der Absicherung fallen sofort auf |

| Blockchain-Verifizierung | Inhalte werden in dezentralen Systemen registriert | Authentizität ist nachweisbar und manipulationssicher |

| Integritätsschutz | Hashs sichern die Originalversion eines Inhalts | Jede Änderung wird erkannt und dokumentiert |

| Kameragebundene Signierung | Geräte versiegeln Videos bereits bei der Aufnahme | Authentische Inhalte direkt ab der Quelle gesichert |

Innovative Ansätze arbeiten daran, dass Kameras Videos kryptographisch versiegeln, während sie aufgenommen werden. Diese Technologie transformiert den Schutz von Authentizität und Integrität.

Ein ganzheitlicher Ansatz kombiniert beide Ebenen: Ihre Mitarbeiterschulung entwickelt menschliche Urteilskraft. Machine Learning und Deep Learning Technologien bauen technische Barrieren auf. Diese Kombination ist deutlich stärker als jede isolierte Maßnahme.

Prävention kostet weniger als die Bewältigung erfolgreicher Angriffe. Unternehmen, die jetzt investieren, schützen ihre Reputation, ihre Mitarbeiter und ihre finanziellen Ressourcen nachhaltig.

Technische Schutzmaßnahmen und Sicherheitsprotokolle

Die Bedrohung durch Deepfakes wächst rasant. Unternehmen müssen ihre KI-Sicherheit verstärken, um sich zu schützen. Bis 2026 werden sich 30% der Unternehmen nicht mehr vollständig auf traditionelle Identitätsprüfung als Vertrauensgrundlage verlassen. Das signalisiert einen fundamentalen Wandel in der Cybersicherheit.

Technische Schutzmaßnahmen bilden das Fundament Ihrer Verteidigungsstrategie. Sie benötigen mehrschichtige Systeme, die zusammenarbeiten. Keine einzelne Methode kann alle Bedrohungen abwehren. Die Kombination verschiedener Verfahren erhöht die Sicherheit erheblich.

Sicherheitsprotokolle für Ihr Unternehmen sollten folgende Elemente enthalten:

- Mehrschichtige Authentifizierung: Verbinden Sie biometrische Verfahren mit Passwörtern, Tokens und kontextbasierten Faktoren

- Lebendigkeitserkennung: Prüfen Sie, ob eine echte Person vor der Kamera steht, durch spezifische Bewegungsaufforderungen

- Mikroausdrucks-Analyse: Erkennen Sie minimale, unwillkürliche Gesichtsbewegungen, die Deepfakes nicht reproduzieren können

- Kontinuierliche Überwachung: Nutzen Sie KI-gestützte Anomalie-Erkennungssysteme für alle Kommunikationskanäle

Für kritische Transaktionen empfehlen wir zusätzliche technische Schutzmaßnahmen:

- Implementieren Sie Rückrufverfahren bei ungewöhnlichen Anfragen

- Führen Sie das Vier-Augen-Prinzip bei Finanztransfers ein

- Nutzen Sie Out-of-Band-Bestätigung über separate Kanäle

- Dokumentieren Sie alle Sicherheitsvorfälle systematisch

| Schutzmaßnahme | Funktionsweise | Effektivität gegen Deepfakes | Implementierungsaufwand |

|---|---|---|---|

| Mehrschichtige Authentifizierung | Kombination von Biometrie, Passwort und Token | Sehr hoch | Mittel |

| Lebendigkeitserkennung | Prüfung echter Bewegungen und Reaktionen | Hoch | Mittel |

| Mikroausdrucks-Analyse | Analyse minimaler Gesichtsbewegungen | Sehr hoch | Hoch |

| Anomalie-Erkennung | KI-gestützte Überwachung von Mustern | Hoch | Mittel |

| Out-of-Band-Bestätigung | Bestätigung über separate Kommunikationskanäle | Sehr hoch | Niedrig |

Die Grundlagen von Machine Learning und Deep Learning ermöglichen es Ihnen, diese Systeme optimal zu nutzen und zu verstehen.

Beginnen Sie mit einer Risikobewertung Ihrer Prozesse. Priorisieren Sie Bereiche mit hohem finanziellem oder reputationellem Risiko. Starten Sie mit Pilotprojekten in kritischen Abteilungen. So bauen Sie schrittweise ein robustes Sicherheitssystem auf.

KI-Sicherheit ist kein einmaliges Projekt. Sie benötigen regelmäßige Updates und Anpassungen. Neue Deepfake-Techniken entstehen ständig. Ihre Sicherheitsprotokolle müssen mit diesen Entwicklungen Schritt halten. Etablieren Sie daher ein kontinuierliches Monitoring und regelmäßige Schulungen für Ihr Team.

Rechtliche Rahmenbedingungen und regulatorische Ansätze

Die Deepfake-Technologie bringt neue Herausforderungen für Gesellschaft und Recht. Regulierungsbehörden weltweit erkennen die Risiken. Sie schaffen rechtliche Rahmenbedingungen, um Missbrauch zu verhindern.

Als Unternehmen müssen Sie diese Entwicklungen verstehen. So können Sie rechtssicher handeln und das Vertrauen Ihrer Kunden bewahren.

Gesetzliche Regelungen in der EU

Die Europäische Union führt bei der Regulierung von künstlicher Intelligenz. Der Regulierungsentwurf der EU-Kommission schafft rechtliche Rahmenbedingungen für synthetische Medien.

Die EU-Regulierung teilt Risikostufen ein. Deepfake-Systeme gelten als Hochrisiko. Das bedeutet für Sie:

- Dokumentationspflichten für KI-Systeme

- Transparenzanforderungen beim Einsatz

- Haftung bei Schäden durch Deepfakes

- Meldepflichten bei Sicherheitsverstößen

- Compliance-Prozesse in Ihrem Unternehmen

Internationale Regierungen erlassen eigene Gesetze gegen Deepfake-Missbrauch. Länder wie Großbritannien, Kanada und Australien schaffen Straftatbestände. Diese betreffen nicht-konsensuale synthetische Medien und Wahlbeeinflussung.

Kennzeichnungspflicht für synthetische Medien

Ein zentrales Element ist die Kennzeichnungspflicht. Alle mit Deepfake-Technologie erstellten Materialien müssen gekennzeichnet werden. Diese Transparenz schützt Nutzer vor Täuschung.

| Medientyp | Kennzeichnungsanforderung | Rechtsfolge bei Verstoß |

|---|---|---|

| Synthetische Videos | Deutliche Markierung als KI-generiert erforderlich | Geldbuße bis 6 % des Jahresumsatzes |

| Manipulierte Audio-Inhalte | Quellangabe und Kennzeichnung nötig | Strafrechtliche Verfolgung möglich |

| Gefälschte Porträts | Explizite Angabe als synthetisch erforderlich | Schadensersatzpflicht bei Täuschung |

| Marketing-Inhalte mit KI | Offenlegung des KI-Einsatzes nötig | Abmahnung und Unterlassungsansprüche |

Für Ihr Unternehmen bedeutet das: Nutzen Sie KI-generierte Inhalte für Marketing oder Produktpräsentationen, diese müssen klar gekennzeichnet sein. Verstöße können rechtliche Konsequenzen und Reputationsschäden nach sich ziehen.

Die EU-Regulierung schafft Abschreckung. Die Verbreitung ungekennzeichneter Deepfakes wird strafbar. Das erschwert Angreifern die Nutzung dieser Technologie für Betrug, Verleumdung oder Wahlbeeinflussung erheblich.

Verfolgen Sie die regulatorische Entwicklung aktiv. Etablieren Sie Compliance-Prozesse frühzeitig. So positionieren Sie Ihr Unternehmen als verantwortungsvoller KI-Nutzer und schaffen Vertrauen bei Kunden und Partnern.

Herausforderungen bei der Deepfake-Abwehr

Die Herausforderungen bei Deepfakes wachsen schneller als die Schutzmaßnahmen. Es ist ein ständiger Kampf zwischen Fälschungstechnologie und Erkennungsmethoden. Die Technologie entwickelt sich so schnell, dass Abwehrsysteme hinterherhinken.

Ein großes Problem ist die mangelnde Generalisierbarkeit. Erkennungssysteme funktionieren nur mit den Methoden, auf die sie trainiert wurden. Neue Techniken können diese Systeme leicht überwinden.

Jede Innovation in der KI-Entwicklung für Fälschungen erfordert neue Erkennungsmodelle. Diese müssen ständig aktualisiert werden.

Die Bedrohung wird durch sinkende Hürden für Angreifer größer. Früher benötigte man spezialisiertes Wissen, heute reicht Benutzerfreundlichkeit. Cloud-basierte Tools und Open-Source-Software machen die Technologie gefährlich zugänglich. Weniger Expertise bedeutet mehr potenzielle Täter.

- Adversariale Angriffe schwächen KI-Detektionssysteme

- Trainingsdaten für Fälschungen werden kontinuierlich kleiner

- Echtzeit-Generierung von Deepfakes wird zunehmend möglich

- Neue Fälschungsmethoden entstehen schneller als Erkennungstools

Das Katz-und-Maus-Spiel zwischen Erstellung und Erkennung verlangt ständige Wachsamkeit. Es gibt keine endgültige Lösung. Stattdessen braucht man mehrschichtige Strategien, die sich anpassen.

Regelmäßige Schulungen, technische Updates und optimierte Prozesse sind wichtig. Eine realistische Einschätzung dieser Herausforderungen hilft, nachhaltige Schutzkonzepte zu entwickeln.

Fazit

Deepfakes sind eine echte Gefahr für Ihr Unternehmen. Jedes fünfte Mal passiert ein Deepfake-Vorfall weltweit. Die Technik wird immer einfacher und die Fälschungen besser.

Um sich zu schützen, braucht es einen umfassenden Plan. Technische Schritte wie mehrschichtige Authentifizierung sind wichtig. Auch organisatorische Prozesse wie Verifikationsprotokolle helfen. Nur so wird Ihre Organisation digital.

Nun können Sie Deepfakes erkennen und verstehen. Sie wissen, wie Sie sich schützen können. Dieser Schutz ist in der digitalen Welt unerlässlich. Starten Sie jetzt mit Schulungen und prüfen Sie Ihre Sicherheitsprotokolle.