Deepfakes erkennen und absichern mit KI

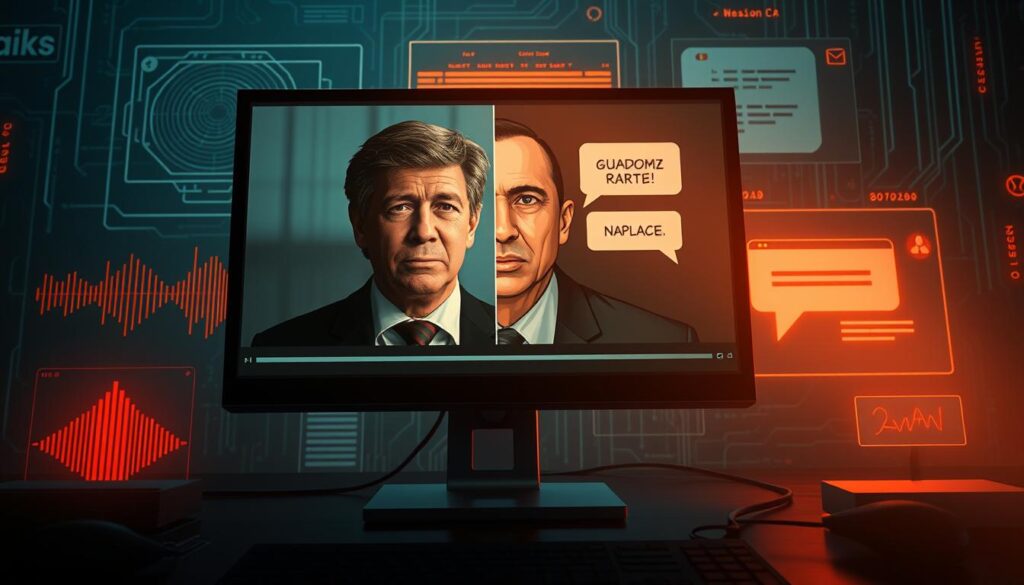

Können Sie noch vertrauen, was Sie sehen und hören? KI Deepfakes werden täglich realistischer. Sie sind kaum noch von echten Inhalten zu unterscheiden. Das stellt Ihr Unternehmen vor neue Herausforderungen.

Die Zahlen sind beeindruckend und gleichzeitig besorgniserregend. 98 Prozent der Menschen erkennen hochwertige Deepfakes nicht. Ein Viertel aller Nutzer wurde bereits durch gefälschte Videos oder Audiodaten getäuscht. Kleine und mittlere Unternehmen sind genauso anfällig.

Das Alarmierende: Nur 20 Sekunden Audiomaterial reichen aus, um Ihre Stimme zu klonen. Mit dieser Technik lassen sich überzeugende Sprachfälschungen erstellen. Ihre digitale Identität wird zur potenziellen Angriffsfläche.

Wir zeigen Ihnen, welche Risiken aus dieser Entwicklung für Ihr Unternehmen entstehen. Sie lernen, wie Deepfake erkennen funktioniert. Unsere Expertise befähigt Sie, sich und Ihre Organisation zu schützen. Mit diesem Wissen wappnen wir Sie für die Zukunft der digitalen Sicherheit.

Die Dimension dieser Bedrohung zu verstehen ist entscheidend. Sie schützen damit nicht nur Ihr Unternehmen, sondern auch Ihre persönliche Reputation. Die Herausforderung ist real, doch Sie können sich vorbereiten. Wir führen Sie durch die wichtigsten Erkenntnisse zum Thema KI Deepfakes.

Wichtigste Erkenntnisse

- 98 Prozent der Menschen können hochwertige Deepfakes nicht erkennen

- 20 Sekunden Audiomaterial ermöglichen das Klonen einer Stimme

- Ein Viertel aller Nutzer wurde bereits durch Deepfake-Technologie getäuscht

- Deepfake erkennen ist eine unverzichtbare Kompetenz für Führungskräfte

- KI-basierte Erkennungsmethoden bieten wirksamen Schutz

- Präventive Maßnahmen reduzieren das Risiko erheblich

Was sind KI Deepfakes und wie funktionieren sie

Deepfakes sind künstliche Medieninhalte, die auf fortschrittlicher Technologie basieren. Der Name “Deepfake” kombiniert “Deep Learning” mit “Fake”. Er beschreibt, wie man diese Manipulationen macht. Um die Risiken zu verstehen und sich zu schützen, ist ein Grundverständnis wichtig.

Wir erklären, wie diese Systeme arbeiten und welche Technologien dahinterstecken.

Definition und technologische Grundlagen von Deepfakes

Deepfakes sind digitale Fälschungen, die durch künstliche Intelligenz entstehen. Sie basieren auf Deep Learning. So können sie realistische Manipulationen wie Gesichtsaustausch oder Stimmenklonierung schaffen.

Die Technologie nutzt große Datenmengen zur Schulung. Tausende von Bildern oder Audiodateien werden als Trainingsmaterial verwendet. Der Prozess umfasst mehrere Schritte:

- Datensammlung aus Quellenmaterial

- Extraktion von charakteristischen Merkmalen

- Umwandlung in mathematische Vektoren

- Generierung neuer, manipulierter Inhalte

Generative Adversarial Networks (GANs) als Kerntechnologie

Generative Adversarial Networks sind das Herz der Deepfake-Technologie. Es handelt sich um ein System mit zwei konkurrierenden Komponenten, die gegeneinander arbeiten.

Der Generator erstellt gefälschte Inhalte aus Trainingsdaten. Der Diskriminator bewertet, ob diese Inhalte echt sind. Dieser “Wettkampf” verbessert beide Systeme ständig:

| Komponente | Aufgabe | Ziel |

|---|---|---|

| Generator | Erzeugt gefälschte Inhalte | Täuschend echte Fälschungen erstellen |

| Diskriminator | Bewertet die Authentizität | Echte von gefälschten Inhalten unterscheiden |

Durch den iterativen Prozess werden beide Netzwerke immer besser. Der Generator schafft überzeugendere Fälschungen. Der Diskriminator wird besser im Erkennen von Manipulationen. So entstehen hochwertige, täuschend echte Deepfakes.

Deep Learning und neuronale Netze im Deepfake-Prozess

Neuronale Netze mit mehreren Schichten erkennen und reproduzieren komplexe Muster. Deep Learning ermöglicht es ihnen, abstrakte Konzepte zu lernen und anzuwenden.

Der Aufbau erfolgt in mehreren Ebenen:

- Eingabeschicht erfasst Rohdaten

- Verborgene Schichten extrahieren Merkmale

- Ausgabeschicht generiert das Endergebnis

Jede Schicht verarbeitet die Informationen auf höherem Abstraktionsniveau. So können feinste Details wie Augenbewegungen und Gesichtsausdrücke reproduziert werden.

Die Rechenleistung moderner Systeme hat sich stark verbessert. Früher brauchte man Stunden für akzeptable Ergebnisse. Heute genügen Minuten an Quellenmaterial. Diese Entwicklung macht die Technologie zugänglicher und gefährlicher. Man kann die Bandbreite von Deepfake-Anwendungen besser einschätzen und Schutzmaßnahmen ergreifen.

Verschiedene Arten von Deepfake-Manipulationen

Deepfakes entstehen durch verschiedene Technologien. Es gibt visuelle, audio- und textbasierte Manipulationen. Jede Form nutzt spezifische Techniken und birgt Risiken für Sicherheit und Vertrauen.

Es gibt verschiedene Methoden zur Manipulation. Video-Deepfakes sind die sichtbarsten. Sie können Gesichter austauschen oder Mimik verändern.

Audio-Deepfakes manipulieren Stimmen. Textbasierte Fälschungen erzeugen glaubwürdige Inhalte ohne Bilder.

Die echte Gefahr liegt in der Kombination aller drei Formen. Angreifer können visuelle, audio- und textbasierte Veränderungen kombinieren. So entstehen überzeugende Fälschungen, die schwer zu erkennen sind.

| Manipulationsform | Eingesetzte Technologie | Hauptrisiken | Erkennungsschwierigkeit |

|---|---|---|---|

| Video-Deepfakes (Gesichter) | Face Swapping, Face Reenactment, GANs | Identitätsraub, Rufschädigung, Betrugsfälle | Mittel bis Hoch |

| Audio-Deepfakes (Stimmen) | Text-to-Speech, Voice Conversion, neuronale Netze | CEO-Fraud, Social Engineering, Finanzbetrüge | Hoch |

| Text-Deepfakes | Large Language Models, Transformer-Netzwerke | Desinformation, Phishing, Nachahmung von Schriftstil | Sehr Hoch |

| Kombinierte Angriffe | Multi-modale KI-Systeme | Umfassender Identitätsraub, komplexe Betrügereien | Extrem Hoch |

Die Qualität der Fälschungen steigt stetig. Früher war das nur Experten möglich. Jetzt können auch Laien mit einfachen Tools Fälschungen erstellen.

Es ist wichtig, verschiedene Erkennungsstrategien zu entwickeln. Jede Deepfake-Art erfordert spezifische Abwehrmaßnahmen. Video-Deepfakes benötigen bildbasierte Analyseverfahren. Audio-Fälschungen erfordern akustische Forensik. Textbasierte Fälschungen brauchen linguistische Prüfungen.

Die Bedrohungen aus dem Darknet zeigen, wie professionell organisierte Kriminelle diese Technologien nutzen. Dieses Wissen ist die Grundlage für Ihre Sicherheitsstrategie. Ein wirksames Schutzkonzept muss alle drei Bereiche abdecken.

Fälschung von Gesichtern durch Face Swapping und Face Reenactment

Die Manipulation von Gesichtern in Videos ist sehr gefährlich. Wir erklären, wie diese Techniken funktionieren und welche Risiken sie bergen. So können Sie Ihr Unternehmen besser schützen.

Face Swapping: Gesichtertausch in Videos

Face Swapping tauscht das Gesicht einer Person gegen das einer anderen aus. Man braucht nur wenige Minuten hochwertiges Video, um das zu tun.

Moderne Grafikkarten ermöglichen Training in Full-HD-Qualität. Manche Systeme arbeiten sogar in Echtzeit. So entstehen Videos, die sehr echt wirken.

- Benötigte Trainingsmaterialien: 2-5 Minuten Video pro Person

- Ausgabequalität: Meist Full-HD bis 4K

- Verarbeitungsgeschwindigkeit: Von mehreren Stunden bis zu Echtzeit

- Erkennungsrisiko: Niedrig bis mittelhoch

Face Reenactment: Manipulation von Mimik und Kopfbewegungen

Face Reenactment ist eine weitere Technik. Ein 3D-Modell des Zielgesichts wird erstellt. Der Angreifer kann die Kopfbewegungen und Mimik genau steuern.

Durch diese Technik entstehen Videos, in denen Personen Dinge sagen, die sie nie sagten. Es ist sehr gefährlich für Desinformation.

Face Reenactment benötigt mehr als Face Swapping:

- Erstellung eines präzisen 3D-Modells des Zielgesichts

- Erfassung von Bewegungsmustern und Mimik

- Synchronisation mit Audioquellen

- Rendering und Nachbearbeitung des Materials

Synthetisierung neuer Pseudo-Identitäten

Die dritte Methode schafft komplett neue Identitäten. Diese Personen existieren nicht wirklich. Angreifer nutzen diese Identitäten für Fake-Profile oder Social Engineering.

Diese Technik ist sehr gefährlich. Sie kann zu Betrügereien oder Desinformationskampagnen führen.

| Manipulationsmethode | Benötigte Daten | Ausgabequalität | Erkennungsrisiko | Zeitaufwand |

|---|---|---|---|---|

| Face Swapping | 2-5 Minuten hochwertiges Videomaterial | Full-HD bis 4K | Niedrig bis mittelhoch | Mehrere Stunden |

| Face Reenactment | 10-15 Minuten Videomaterial mit Mimik | Full-HD bis 4K | Mittelhoch | 8-24 Stunden |

| Synthetische Identitäten | Große Bilddatensätze (1.000+ Fotos) | Full-HD bis 4K | Mittelhoch | Tage bis Wochen |

Schulung und technische Schutzmaßnahmen sind wichtig. Jede Technik erfordert spezifische Schutzstrategien. Trainieren Sie Ihre Mitarbeiter, diese Manipulationen zu erkennen, und setzen Sie auf mehrschichtige Sicherheitssysteme.

Manipulation von Stimmen mittels KI-Technologie

Die Manipulation von Stimmen ist eine der gefährlichsten KI-Technologien. Gesichtsmanipulationen können manchmal erkannt werden, aber Stimmenfälschungen sind oft schwer zu erkennen. Es gibt drei Hauptmethoden, die diese Täuschungen ermöglichen.

Die Technologien nutzen unterschiedliche Ansätze und Eingaben. Wir erklären, wie sie funktionieren und welche Risiken sie bergen.

Text-to-Speech-Verfahren zur Stimmenerzeugung

Text-to-Speech (TTS) wandelt Text in gesprochene Sprache um. Es nutzt geschriebenen Text und neuronale Netze, um Worte zu erzeugen. Diese Systeme analysieren Schriftzeichen und wandeln sie in akustische Signale um.

Moderne TTS-Engines nutzen Deep Learning, um die Sprachqualität zu verbessern. Sie benötigen viel Trainingsdaten, um überzeugend zu klingen. Beispiele sind Google Cloud Text-to-Speech und Amazon Polly.

- Schrifttext wird in phonetische Elemente zerlegt

- Neuronale Netze berechnen Tonhöhe und Geschwindigkeit

- Sprachsynthese erzeugt authentisch wirkende Audiodateien

- Betrüger nutzen TTS zur Erstellung überzeugender Nachrichten

Voice Conversion: Konvertierung vorhandener Audiodaten

Voice Conversion wandelt bestehende Aufnahmen in andere Stimmen um. Diese Technologie benötigt eine Ausgangsaufnahme und ändert deren akustische Merkmale.

Im Gegensatz zu TTS bleibt der Inhalt unverändert. Nur die Stimmmerkmale werden neu. Das ermöglicht echte Fälschungen von Sprachmaterial.

Eng verbunden mit Voice Conversion ist Voice Cloning. Es benötigt mehr Trainingsmaterial, um eine Stimme vollständig zu rekonstruieren. Längere Trainingszeiten verbessern die Qualität der geklonten Stimme.

| Verfahren | Eingabematerial | Benötigte Dauer | Anwendungsbereich |

|---|---|---|---|

| Text-to-Speech | Geschriebener Text | Sekunden bis Minuten | Chatbots, Navigation, Ansagen |

| Voice Conversion | Existierende Audioaufnahme | 1-10 Minuten | Stimmänderung, Sprecherwechsel |

| Voice Cloning | Umfangreiche Sprachsamples | 20 Sekunden bis mehrere Stunden | Personalisierte Sprachassistenten, Deepfakes |

Audio-Deepfakes kombinieren verschiedene Methoden für maximale Täuschung. Betrüger nutzen TTS für schnelle Massenproduktion und Voice Cloning für hochwertige personalisierte Angriffe. Diese Kombination macht die Erkennung schwieriger.

Die Folgen dieser Entwicklungen sind ernst: Alle Verfahren gefährden Authentifizierungssysteme. Spracherkennung als Sicherheitsmerkmal wird weniger wirksam. Deshalb sind mehrschichtige Sicherheitsprotokolle unerlässlich. Biometrische Systeme benötigen zusätzliche Verifikationsebenen.

- Stimmerkennung allein reicht nicht als Sicherheitsfaktor

- Multi-Faktor-Authentifizierung wird unverzichtbar

- Zeitbasierte und Kontextprüfungen gehören zur Strategie

- Regelmäßige Sicherheitsaudits schützen Systeme

KI-generierte Textfälschungen und deren Einsatzbereiche

Künstliche Intelligenz kann heute Texte erstellen, die fast wie von Menschen geschrieben wirken. Sie hilft, E-Mails zu verfassen, Blog-Artikel zu erstellen und Social-Media-Posts zu generieren. Diese Technologie arbeitet so schnell und genau, dass viele die Quelle nicht erkennen.

Die Gefahr liegt in der Geschwindigkeit und Skalierbarkeit dieser Technologien. Chatbots und Social Bots nutzen synthetische Texte für täuschend echte Konversationen. Sie können wie echte Menschen kommunizieren und bauen Vertrauen auf, das später ausgenutzt wird. Social Bots verbreiten Informationen in großem Maßstab und manipulieren öffentliche Meinungen.

Die benötigten Ressourcen werden zunehmend zugänglich. Früher brauchte man Fachkenntnisse und teure Software. Heute stehen diese Tools jedem zur Verfügung. Die Verbreitung beschleunigt sich exponentiell.

Einsatzbereiche von automatisierter Textfälschung

Automatisierte Textfälschung ist besonders gefährlich in mehreren Bereichen:

- Phishing-E-Mails mit personalisierten Inhalten – Diese wirken täuschend echt und zielgerichtet

- Gefälschte Kundenrezensionen – Sie beeinflussen Kaufentscheidungen massiv

- Manipulative Social-Media-Kampagnen – Sie verbreiten sich viral und ungeprüft

- Täuschend echte Chatbot-Gespräche – Chat-Antworten automatisieren ermöglicht perfekte Täuschung

| Bedrohungstyp | Charakteristiken | Zielgruppe | Verbreitungsgeschwindigkeit |

|---|---|---|---|

| Phishing-E-Mails | Personalisiert, dringend wirkend, Vertrauensperson imitierend | Arbeitskräfte, Führungskräfte | Sehr schnell (Minuten) |

| Gefälschte Rezensionen | Grammatikalisch korrekt, emotionale Sprache, Details genannt | Käufer, Konsumenten | Schnell (Stunden) |

| Social-Media-Posts | Viral-tauglich, aktuell bezogen, kontrovers | Öffentlichkeit, Nutzer | Exponentiell (Echtzeit) |

| Chatbot-Gespräche | Natürlicher Dialog, kontextgerecht, hilfreich wirkend | Chat-Nutzer, Messenger-User | Sehr schnell (Echtzeit) |

Warum diese Fälschungen so überzeugend wirken

Die Kombination aus maschinellem Lernen und neuronalen Netzen macht diese Fälschungen so überzeugend. Die Systeme lernen von Millionen echten Texten und reproduzieren menschliche Schreibmuster perfekt. Sie verstehen Kontext, Emotionen und kulturelle Nuancen.

Sie müssen Ihre Kommunikationswege schützen. Mitarbeiter sollten lernen, textbasierte Angriffe zu erkennen. Wir befähigen Sie, verdächtige Muster zu identifizieren. Achten Sie auf:

- Ungewöhnliche Absender-Adressen oder leichte Schreibfehler in vertrauten Kontakten

- Dringende Handlungsaufforderungen ohne klare Begründung

- Generische Anrede statt persönlicher Namen

- Links oder Anhänge, die Sie vorher nicht erwartet haben

- Tonalität, die nicht zur bekannten Person passt

Sie verstehen nun, warum kritisches Hinterfragen digitaler Kommunikation unverzichtbar ist. Jede Nachricht verdient Ihre Aufmerksamkeit und Überprüfung.

Bedrohungsszenarien durch Deepfake-Technologie

Deepfakes sind eine große Gefahr für Firmen. Sie ermöglichen es Angreifern, überzeugende Fälschungen zu machen. Diese werden oft für Betrug genutzt.

Die Folgen sind ernst. Firmen verlieren viel Geld. Ihre Ruf wird auch geschädigt.

Überwindung biometrischer Sicherheitssysteme

Biometrische Systeme sind sicher. Doch Deepfakes können sie umgehen. Sie täuschen Gesichtserkennung und Sprachauthentifizierung.

Angreifer nutzen diese Schwachstellen. Sie erschaffen digitale Identitäten, die echt wirken. So bekommen sie Zugang zu wichtigen Daten.

Social Engineering und Spear-Phishing-Angriffe

Deepfakes machen Social Engineering wirksamer. Angreifer nutzen gefälschte Videos und Sprachnachrichten. Sie schicken auch gefälschte E-Mails.

Nachgeahmte Videokonferenzen täuschen Mitarbeiter. Diese personalisierten Angriffe sind besonders effektiv. Sie zielen auf wichtige Positionen.

CEO-Fraud und finanzielle Betrugsfälle

CEO-Fraud ist sehr gefährlich. Ein Angreifer ruft als Führungskraft an. Er fordert Geld, und der Mitarbeiter überweist es.

Es gibt viele solcher Fälle:

| Vorfall | Jahr | Schaden | Angriffsart |

|---|---|---|---|

| Bankraub Dubai | 2020 | 35 Millionen Dollar | Voice-Deepfake in Geldtransfer |

| Energiekonzern UK | 2019 | 220.000 Euro | Gefälschter Sprachanruf einer Führungskraft |

| Internationale Fälle | 2021-2024 | Millionen Euro | Kombinierte Deepfakes (Video und Audio) |

Diese Fälle zeigen, wie ernst es ist. Der Bankraub in Dubai 2020 war ein großer Schlag. Seitdem gibt es weltweit viele solcher Angriffe.

Die Folgen sind schwer:

- Finanzielle Verluste durch Geldtransfers

- Schäden für die Reputation

- Kundenzufriedenheit sinkt

- Rechtliche Probleme

- Mitarbeiter werden unsicher

Es ist wichtig, aktiv zu schützen. Firmen müssen vorsorgen. Schulung, Sicherheitssysteme und Protokolle helfen.

Typische Erkennungsmerkmale von Video-Deepfakes

Video-Deepfakes haben viele visuelle Fehler, die man lernen kann. Diese Fehler entstehen, weil die KI nicht so gut wie echte Gesichter ist. So kann man manipulierte Videos erkennen und sich schützen.

Sichtbare Übergänge und Hautfarbenunterschiede

Ein auffälliges Merkmal sind die Übergänge an der Naht um das Gesicht. Die KI kann diese Übergänge nicht so gut machen wie echte Gesichter. Man sieht, wie die Hautfarbe und -textur plötzlich wechselt.

Achten Sie auf diese Details:

- Unterschiede in der Hautstruktur an Kinn und Nacken

- Farbabweichungen entlang der Wangenknochen

- Doppelte Augenbrauen oder unscharfe Augenbrauenränder

- Ungleichmäßige Beleuchtung zwischen Gesicht und Körper

Unnatürliche Augenbewegungen und fehlende Mimik

Die Augen verraten Deepfakes besonders zuverlässig. Beobachten Sie das Augenblinzeln genau: Es kann völlig fehlen oder extrem selten auftreten. Manchmal blinzelt die Person zu häufig oder rhythmisch, was unnatürlich wirkt.

Weitere Indikatoren sind:

- Leerer Blick ohne echte Emotion

- Starre Mimik während des Sprechens

- Begrenzte Mimik beim Lächeln oder Stirnrunzeln

- Unsymmetrische Augenbewegungen

Die Profilansicht wird von KI-Systemen oft unzureichend erlernt. Videos, die hauptsächlich aus Profilen bestehen, zeigen häufig fehlerhafte Proportionen.

Verwaschene Konturen bei Zähnen und Details

Scharfe Konturen wie Zähne oder Augen wirken verwaschen in manipulierten Videos. Die KI kann feine Details nicht genau reproduzieren. Beim genauen Hinsehen werden Sie mehrere Fehler gleichzeitig beobachten.

| Merkmal | Normale Videos | Deepfake-Videos |

|---|---|---|

| Zahnkanten | Scharfe, deutliche Linien | Verschwommene Grenzen ohne klare Kanten |

| Einzelne Haare | Individuelle Struktur erkennbar | Unscharfe Ränder und fehlende Details |

| Augenwimpern | Präzise Konturen | Verwaschene Konturen und Unschärfe |

| Ohren | Korrekte Anatomie und Proportion | Proportionsfehler und merkwürdige Formen |

| Lippen und Mund | Klare Grenzen zwischen Haut und Mund | Verschwommene Grenzen und unscharfe Ränder |

| Belichtung | Konsistente Lichtquellen | Unstimmige Belichtung verschiedener Gesichtsbereiche |

Die Identifikation erfordert Aufmerksamkeit und regelmäßige Übung. Wenn Sie mehrere Merkmale gleichzeitig beobachten, ist eine Manipulation sehr wahrscheinlich. So können Sie Video-Artefakte mit bloßem Auge erkennen, indem Sie systematisch auf diese Warnsignale achten.

Audio-Deepfakes identifizieren: Artefakte und Warnsignale

Audio-Deepfakes sind eine große Gefahr. Künstliche Intelligenz kann Stimmen sehr echt nachahmen. Doch es gibt Hinweise, die Sie erkennen können. Mit dem richtigen Wissen können Sie verdächtige Audiodateien finden und Ihr Unternehmen schützen.

Die meisten KI-generierten Audiofälschungen zeigen typische Zeichen. Ein metallischer Sound ist oft leicht zu erkennen. Dieser Klang kommt von Unvollkommenheiten im Netzwerk. Achten Sie auf Qualitätseinbußen, die natürliche Sprache nicht zeigen.

- Falsche Aussprache besonders bei fremdsprachigen Wörtern – KI-Systeme haben Schwierigkeiten mit ungewöhnlichen Lautmustern

- Monotone Sprachausgabe ohne natürliche Betonungsvariationen – sehr häufig und leicht erkennbar

- Falsche Sprechweise mit Akzenten und Betonungen, die nicht zum Zielsprecher passen

- Unnatürliche Geräusche im Hintergrund oder zwischen Worten

- Hohe Verzögerung bei qualitativ hochwertigen Fälschungen durch Verarbeitungspausen

| Erkennungsmerkmal | Häufigkeit | Erkennungsschwierigkeit | Beschreibung |

|---|---|---|---|

| Metallischer Sound | Sehr häufig | Leicht | Artifizielle Klangtextur durch neuronale Netzwerke |

| Falsche Aussprache | Häufig | Mittelschwer | Fehlerhafte Lautbildung bei fremdsprachigen Wörtern |

| Monotone Sprachausgabe | Sehr häufig | Leicht | Fehlende emotionale Intonation und Betonung |

| Falsche Sprechweise | Häufig | Mittelschwer | Unstimmige Akzente und Betonungsmuster |

| Unnatürliche Geräusche | Sehr häufig | Leicht | Artefakte zwischen Worten oder im Hintergrund |

| Hohe Verzögerung | Häufig | Mittelschwer | Zeitliche Pausen bei qualitativ hochwertigen Fälschungen |

Besonders wichtig: Achten Sie auf fehlende Emotionen in der Sprachausgabe. Echte Menschen betonen Wörter unterschiedlich. Deepfakes klingen oft roboterisch. Dieser Unterschied ist leicht zu erkennen.

Um verdächtige Audio-Signale zu identifizieren, nutzen Sie mehrere Methoden. Hören Sie genau hin. Nutzen Sie spezialisierte Software. Vergleichen Sie mit Originalaufnahmen. So schützen Sie Ihr Unternehmen.

Das Wichtigste: Seien Sie skeptisch gegenüber unerwarteten Audiodateien. Besonders bei sensiblen Anfragen. Bitten Sie um Bestätigung über alternative Kanäle. So bauen Sie eine Schutzschicht auf.

Traditionelle bildforensische Methoden zur Deepfake-Erkennung

Künstliche Intelligenz hilft uns, Deepfakes zu erkennen. Aber klassische Methoden sind auch wichtig. Sie nutzen wissenschaftliche Prinzipien, um Manipulationen zu finden. So können wir Schäden verhindern.

Analyse auf statistische Inkonsistenzen zwischen Bildteilen

Ein wichtiger Ansatz ist die Analyse auf statistische Inkonsistenzen zwischen verschiedenen Bildteilen. Echte Fotos haben einzigartige Muster. Diese entstehen durch Kamera, Objektiv und Licht.

Bei gefälschten Bildern sind diese Muster anders. Man kann Fälschungen erkennen, wenn man diese Unterschiede findet.

- Unterschiedliche Rauschcharakteristiken durch Effekte der Bildkompression

- Ungleichmäßiges Bild- und Sensorrauschen in einzelnen Bereichen

- Abweichende Farbverteilungen zwischen Original und eingefügtem Element

- Unterschiedliche Schärfewerte in verschiedenen Bildregionen

Diese Unstimmigkeiten lassen sich mit Statistik messen und zeigen.

Erkennung duplizierter Copy-and-Paste-Bildbereiche

Ein Zeichen für gefälschte Bilder ist die Wiederverwendung von Bildteilen. Die Erkennung funktioniert einfach: Software sucht nach ähnlichen Bildbereichen.

Bei echten Fotos findet man das selten. Bei Deepfakes sieht man es oft. Die Technik arbeitet so:

- Aufteilung des Bildes in Segmente

- Vergleich der Segmente auf Ähnlichkeit

- Kennzeichnung verdächtiger Bereiche

- Bewertung des Manipulationsgrades

Metadaten- und Dateistrukturanalyse

Jedes digitale Bild hat unsichtbare Informationen – die Metadaten. Die Analyse der Metadaten zur Aufnahmesituation zeigt Details wie Kamera und Datum. Bei Fälschungen sind diese oft falsch.

Die Analyse der Dateistruktur prüft die Anordnung der Daten. Echte Fotos folgen bestimmten Standards. Mehrfache Kompression zeigt Manipulationen.

| Forensische Methode | Was wird geprüft | Manipulationssignal |

|---|---|---|

| Rauschanalyse | Konsistenz des Bild- und Sensorrauschens | Unterschiedliche Rauchmuster in Bildteilen |

| Copy-Move-Detection | Duplizierte Bildbereiche | Identische oder sehr ähnliche Regionen |

| Kompressionsanalyse | Detektion mehrfacher Kompression | Mehrfache JPEG-Kompressionsartefakte |

| Metadaten-Check | EXIF-Daten zu Kamera und Objektiv | Fehlende oder widersprüchliche Informationen |

| Dateistruktur | Reihenfolge der Datenbereiche | Abweichungen vom Standard-Format |

Diese Methoden sind wichtig für die Erkennung von Deepfakes. Sie sind einfach und schnell. Sie sind eine gute Ergänzung zu KI-Methoden für Ihre Sicherheit.

KI-basierte Detektionsverfahren: Deep Learning gegen Deepfakes

Deep-Learning-Modelle kämpfen gegen manipulierte Medien. Sie erkennen verdächtige Muster in Videos und Bildern. Doch die Genauigkeit liegt bei etwa 65 Prozent.

Die Generalisierbarkeit dieser Modelle ist eine große Herausforderung. Sie funktionieren gut bei ähnlichen Daten, aber bei Veränderungen sinkt die Genauigkeit. Wenn Deepfakes mit neuen Techniken erstellt werden, versagen viele Systeme.

Die Erkennungsrate fällt dann stark ab.

KI-spezifische Angriffe sind ein großes Risiko. Angreifer können Detektionsverfahren täuschen, indem sie unsichtbares Rauschen in Videos einweben. Für das menschliche Auge bleibt das Material unverändert, doch Erkennungssysteme werden täuscht.

Warum vollständige Automatisierung nicht ausreicht

Reine KI-Lösungen bieten keine vollständige Sicherheit. Selbst hochentwickelte Netzwerke haben Grenzen:

- Begrenzte Genauigkeitsquoten bei Massenprüfungen

- Anfälligkeit gegenüber adversarialen Attacken

- Schlechte Generalisierbarkeit auf unbekannte Deepfake-Typen

- Falsch-positive und falsch-negative Ergebnisse

Der kombinierte Sicherheitsansatz

Die effektivste Strategie kombiniert traditionelle Methoden mit KI-Techniken. Das Bundesamt für Sicherheit in der Informationstechnik empfiehlt mehrstufige Erkennungssysteme. Diese nutzen verschiedene Ansätze.

| Erkennungsmethode | Stärken | Schwächen |

|---|---|---|

| Deep Learning | Schnell, automatisiert, große Datenmengen | Anfällig für adversariale Angriffe, geringe Generalisierbarkeit |

| Traditionelle Forensik | Zuverlässig, schwer zu täuschen, detaillierte Analyse | Zeitaufwändig, erfordert Experten |

| Kombinierter Ansatz | Höchste Zuverlässigkeit, deckt Schwächen ab | Komplexere Implementierung, höhere Kosten |

Ein kombiniertes System filtert verdächtige Inhalte zunächst mit KI. Danach prüfen Experten kritische Fälle mit klassischen Verfahren. Diese Schichtung schließt Lücken, die KI-spezifische Angriffe ausnutzen könnten.

Sie benötigen einen ganzheitlichen Schutz, der sowohl moderne als auch bewährte Technologien nutzt. So wird die Generalisierbarkeit Ihrer Sicherheitssysteme erheblich verbessert.

Multimodale Analyse zur Erkennung von Deepfake-Manipulationen

Um Deepfakes zu erkennen, braucht man eine umfassende Strategie. Man untersucht mehrere Datenquellen gleichzeitig. So erkennt man Manipulationen zuverlässig.

In Videoclips werden Bild und Ton analysiert. Dieser Ansatz hilft, gefälschte Inhalte genauer zu erkennen. Traditionelle Methoden sind oft weniger genau.

Die Kombination von visuellen und akustischen Informationen ist neu. Audio und Video müssen synchron sein. Unnatürliche Übergänge zeigen oft eine Manipulation.

Detektions-Heatmaps zeigen, wo Unstimmigkeiten sind. Sie helfen, echte Gesichter von Deepfake-Angriffen zu unterscheiden.

Konsistenzprüfung zwischen Bild und Ton

Die Synchronisation von Video und Audio ist wichtig. Live-Demonstrator zeigen, wie man Deepfakes erkennt. Echte Videos haben perfekte Synchronisation.

Gefälschte Videos haben oft zeitliche Versätze. Moderne Systeme prüfen dies ständig.

Moderne Systeme prüfen:

- Lippensynchronisation mit dem gesprochenen Text

- Natürlichkeit der Tonfrequenzen und Sprachmuster

- Kohärenz zwischen Mimik und akustischen Signalen

- Hintergrundgeräusche und deren Konsistenz

Vision Transformers und Convolutional Neural Networks

Zwei Schlüsseltechnologien sind wichtig. Vision Transformers erkennen subtile Unregelmäßigkeiten. Convolutional Neural Networks analysieren Bildebenen.

Diese Technologien arbeiten zusammen:

| Technologie | Stärken | Anwendungsbereich |

|---|---|---|

| Vision Transformers | Globale Kontextanalyse, subtile Gesichtsmuster | Emotionale Inkonsistenzen, unnatürliche Ausdrücke |

| Convolutional Neural Networks | Lokale Merkmalsextraktion, Artefakterkennung | Verschwommene Konturen, Hautfarbenübergänge |

Die Kombination beider Systeme ist sehr genau. Sie erkennen sowohl globale als auch lokale Anomalien. Ihr Unternehmen wird so besser vor Deepfake-Angriffen geschützt.

Präventive Maßnahmen und Schutzstrategien für Unternehmen

Der Schutz vor Deepfake-Technologie erfordert einen umfassenden Ansatz. Unternehmen müssen ihre Abwehrstrategien auf mehreren Ebenen aufbauen. So entstehen robuste Sicherheitssysteme gegen manipulierte Inhalte.

Die Kombination aus Schulung, technischen Verfahren und rechtlichen Rahmenbedingungen ist wichtig. Sie bildet die Grundlage für einen effektiven Schutz.

Die EU-Kommission fordert Kennzeichnung von Deepfakes. Dies setzt neue Standards für die Industrie. Unternehmen sollten sich bereits jetzt auf diese Entwicklungen vorbereiten.

Ein proaktives Handeln schützt Ihre Organisation vor erheblichen Risiken.

Mitarbeiterschulung und Sensibilisierung

Die Aufklärung und Schulung potentiell betroffener Personen ist essentiell. Ihre Mitarbeiter müssen das Wissen über Angriffsmöglichkeiten entwickeln. Die Kenntnis typischer Artefakte hilft ihnen, manipulierte Inhalte zu erkennen.

Effektive Schulungsprogramme sollten folgende Inhalte abdecken:

- Erkennung visueller Anomalien in Videos und Bildern

- Identifikation unnatürlicher Sprach- und Audiomuster

- Bewusstsein für Social-Engineering-Techniken

- Praktische Übungen mit realen Deepfake-Beispielen

- Meldeverfahren bei verdächtigen Inhalten

Regelmäßige Trainings erhöhen die Wachsamkeit im Team erheblich. Ein geschulter Mitarbeiter erkennt Manipulationen schneller als ungeschulte Personen.

Kryptographische Verfahren zur digitalen Authentifizierung

Kryptographische Verfahren bilden die technische Säule Ihrer Verteidigungsstrategie. Diese Verfahren ermöglichen es, die Quelle des Materials eindeutig an Identität zu binden. Dadurch entsteht maximale Sicherheit für sensible Inhalte.

Wichtige Elemente kryptographischer Sicherung:

- Digitale Signaturen beim Aufnahmeprozess

- Authentizität und Integritätsschutz durch Verschlüsselung

- Blockchain-basierte Verifikationssysteme

- Zertifikatsverwaltung für autorisierte Quellen

Diese Technologien stellen sicher, dass Ihr Material nicht ohne Erkennung verändert werden kann. Die digitale Signatur beim Aufnahmeprozess schafft einen unveränderlichen Nachweis der Echtheit.

Mehrschichtige Authentifizierungsprotokolle implementieren

Ein einzelnes Sicherheitssystem reicht nicht aus. Mehrschichtige Authentifizierungsprotokolle bieten umfassenden Schutz. Jede Schicht ergänzt die andere und schließt Sicherheitslücken.

| Authentifizierungsebene | Funktion | Schutzeffekt |

|---|---|---|

| Biometrische Verifizierung | Identifikation durch Gesicht, Stimme oder Fingerabdruck | Schutz vor unbefugtem Zugriff |

| Kryptographische Signaturen | Digitale Kennzeichen bei Erstellung | Nachweis der Authentizität und Herkunft |

| Metadaten-Kontrolle | Überprüfung von Zeitstempel und Geräteangaben | Erkennung nachträglicher Manipulationen |

| KI-basierte Analyse | Automatische Überprüfung auf Anomalien | Schnelle Erkennung von Deepfakes |

| Manuelles Review | Überprüfung durch geschultes Personal | Sicherheit bei kritischen Inhalten |

Die Implementierung dieser Protokolle erfordert strategische Planung. Beginnen Sie mit einer Risikoanalyse Ihrer Abläufe. Identifizieren Sie Bereiche, in denen Deepfakes besonders schädlich wären. Konzentrieren Sie Ihre Ressourcen auf diese kritischen Punkte.

Rechtliche Rahmenbedingungen unterstützen Ihre Schutzmaßnahmen. Informieren Sie Ihr Team über relevante Gesetze und Verordnungen. Dieses Wissen stärkt das Bewusstsein für die Ernsthaftigkeit des Themas in Ihrem Unternehmen.

Weiterbildung und aktuelle Entwicklungen in der Deepfake-Forensik

Die Technologie zur Erstellung von Deepfakes entwickelt sich schnell. Es ist wichtig, dass Sie Ihre Kenntnisse ständig aktualisieren. So können Sie Manipulationen zuverlässig erkennen.

2022 begann die Entwicklung mit Stable-Diffusion 1.4. Dieses Modell hatte noch deutliche Artefakte. Es zeigte verzerrte Details und falsche Proportionen.

2023 verbesserte sich die Qualität deutlich. Stable-Diffusion XL brachte wesentlich realistischere Ergebnisse. Es hatte stimmiges Licht und erkennbare Objekte, aber Fehler in feinen Strukturen.

2024 erreichte Flux.1 Dev neue Qualitätsstandards. Es hatte überzeugende Beleuchtung und Tiefenschärfe. Die Unschärfe im Hintergrund wirkte authentisch.

2025 sind Z-Image Turbo-Bilder kaum von Smartphone-Aufnahmen zu unterscheiden. Sie zeigen glaubwürdige Szenerien, korrekte Details und stimmige Farben.

| Jahr | Modell | Qualitätsmerkmale | Erkennbare Fehler |

|---|---|---|---|

| 2022 | Stable-Diffusion 1.4 | Grundlegende Struktur | Deutliche Artefakte, falsche Proportionen, fehlerhafte Gliedmaßen |

| 2023 | Stable-Diffusion XL | Stimmiges Licht, erkennbare Objekte | Fehler in feinen Strukturen, Hautunterschiede |

| 2024 | Flux.1 Dev | Überzeugende Beleuchtung, Tiefenschärfe | Subtile Unregelmäßigkeiten bei genauer Analyse |

| 2025 | Z-Image Turbo | Wie typische Smartphone-Aufnahme | Kaum sichtbar ohne spezialisierte Forensik |

Sie müssen ständig lernen, um mit der Entwicklung Schritt zu halten. Spezialisierte Weiterbildungskurse sind unverzichtbar.

Fraunhofer SIT Kurse zur Echtheitsprüfung

Das Fraunhofer-Institut für Sichere Informationstechnologie bietet Weiterbildungskurse an. Der Kurs “Echtheitsprüfung für digitale Bild-/Videodaten” ist dreitägig. Er verbindet theoretische Grundlagen mit praktischer Anwendung.

- Aktuelle Forschungsergebnisse in der Deepfake-Detektion

- Theoretische Grundlagen von Forensikmethoden

- Live-Demos zur Deepfake-Erzeugung und Echtzeit-Erkennung

- Betreute PC-Übungen mit echtem Bildmaterial

- Simulation von Angriffsszenarien auf Video-Calls

Sie lernen, Bildmaterial auf Echtheit zu prüfen. Die Übungen zeigen, wie Sie Bildqualität und Erkennungsraten testen. Dies ist für Sicherheitsbeauftragte, Medienschaffende, Ermittler und Behördenmitarbeiter wichtig.

Aktuelle Angriffstools und Detektionsverfahren

Sie müssen stets auf dem Laufenden bleiben. Die Angreifer verbessern ihre Technologien ständig. Ihre Abwehrmaßnahmen müssen mit dieser Entwicklung Schritt halten.

- Überwachen Sie neue Generative-Modelle und ihre Fähigkeiten

- Testen Sie neue Detektionssoftware regelmäßig

- Schulen Sie Ihre Mitarbeiter in modernen Erkennungsmethoden

- Teilnehmen Sie an Fachkonferenzen und Workshops

- Folgen Sie aktuellen Publikationen von Forschungsinstitutionen

Die Schulung in Machine-Learning und Deep-Learning Technologien ist wichtig. Sie verstehen die technischen Hintergründe von Deepfakes besser. So können Sie Detektionsmethoden kritisch bewerten.

Investieren Sie in Ihr Wissen und das Ihrer Teams. Weiterbildung ist ein wichtiger Sicherheitsfaktor in einer Welt mit zunehmend realistischer KI-generierter Inhalte. Ihre Kompetenz schützt Ihr Unternehmen vor Manipulationen und Betrügereien.

Fazit

Sie haben viel über Deepfake-Technologie gelernt. Techniken wie Face Swapping und Voice Cloning sind gefährlich. Sie stellen große Risiken für Firmen und Privatpersonen dar.

Es gibt viele Bedrohungen, wie das Überwinden von Sicherheitssystemen. Auch Social Engineering und Phishing sind große Probleme. Weltweit entstehen durch diese Aktivitäten Millionen von Schäden.

Um sich zu schützen, ist ein proaktiver Ansatz wichtig. Wissen über Erkennungsmerkmale hilft dabei, gefälschte Inhalte zu erkennen. Moderne Methoden wie Bildforensik und KI-Technologien sind nützlich.

Es ist wichtig, sich auf mehreren Ebenen zu schützen. Schulung sensibilisiert Teams für Gefahren. Kryptographie und Authentifizierungsprotokolle stärken die Sicherheit.

Weiterbildung ist wichtig, da sich Deepfake-Technologie entwickelt. Nutzen Sie unsere Schulung in Machine Learning und Deep Learning, um Ihre Teams auf dem neuesten Stand zu halten. Investieren Sie in Schulung und Technologie, um Ihr Unternehmen zu schützen.