Überwachung durch KI: Wo liegt die Grenze?

Spüren Sie manchmal, dass jemand Sie beobachtet? Künstliche Intelligenz (KI) überwacht uns schon lange nicht mehr nur in Filmen. Sie ist in unserem Alltag, von Grenzkontrollen bis zu Werbung, präsent. Die Frage ist nicht mehr, ob KI überwacht, sondern wo die Grenzen liegen.

Union und SPD wollen KI in Deutschland viel mehr einsetzen. Sie will sie in Bildung, Arbeitsmarkt und Sicherheit nutzen. Weltweit nutzt man KI schon in der Migrationskontrolle, von der Überwachung bis zu Entscheidungen über Asyl.

Verstehen Sie diese Entwicklungen. Als Fachkraft oder Führungskraft treffen Sie täglich digitale Entscheidungen. Die Fähigkeit, KI-Systeme zu bewerten, wird immer wichtiger. Wir erklären, wie KI überwacht und zeigen, wo ethische und rechtliche Grenzen liegen.

Wichtigste Erkenntnisse

- KI Überwachung prägt bereits heute Alltag, Arbeitswelt und Grenzsicherung

- Union und SPD erweitern rechtliche Rahmenbedingungen für Künstliche Intelligenz Überwachung in Deutschland

- KI Systeme birgen Risiken durch algorithmische Verzerrungen und mangelnde Transparenz

- Biometrische Systeme und automatisierte Entscheidungen werfen grundlegende Fragen zu Menschenrechten auf

- Sie benötigen Orientierungswissen, um KI-Technologien professionell und ethisch zu bewerten

- Regulierung und demokratische Kontrolle sind entscheidend für den verantwortungsvollen KI-Einsatz

KI im Alltag: Unsichtbare Begleiter überall

Künstliche Intelligenz beeinflusst Ihren Alltag mehr, als Sie denken. Viele nutzen täglich intelligente Systeme, ohne es zu merken. KI ist in unserem Alltag allgegenwärtig und hilft uns bei vielen Dingen.

Systeme sammeln Daten über Ihr Verhalten und Vorlieben. Wir erklären, wie diese Technologien funktionieren und was sie bedeuten. So können Sie besser mit Ihren Daten umgehen.

Navigationssysteme und Sprachassistenten

Google Maps ist ein Beispiel für künstliche Intelligenz in der Navigation. Es hilft, den Verkehr zu optimieren. Wenn Sie eine Route suchen, analysiert es Millionen von Daten.

Sprachassistenten wie Alexa und Siri verändern, wie wir mit Technologie kommunizieren. Sie steuern Geräte und beantworten Fragen. Für viele sind sie unverzichtbar geworden.

- Google Maps erfasst Ihre genaue Position und Fahrthistorie

- Sprachassistenten speichern Ihre Befehle und Anfragen dauerhaft

- Bewegungsmuster werden analysiert und für Vorhersagen genutzt

- Verkehrsdaten werden mit anderen Nutzerdaten kombiniert

Die Technologie hinter diesen Systemen basiert auf maschinellem Lernen. Jeder Befehl trainiert das System weiter. Ein Smart Home bietet Komfort, erfasst aber auch detaillierte Daten.

Personalisierte Empfehlungen durch künstliche Intelligenz

Streaming-Dienste wie Netflix und Spotify lernen Ihre Vorlieben kennen. Online-Shops zeigen Ihnen Produkte, die Sie mögen könnten. Diese Empfehlungen basieren auf Algorithmen.

Die Personalisierung funktioniert durch ständige Datenanalyse. Das System erstellt ein Profil Ihrer Vorlieben. Dieses Profil wird ständig aktualisiert.

| Plattform | Erfasste Daten | Personalisierungsziel |

|---|---|---|

| Netflix | Schau- und Pausierverhalten, Suchverlauf | Optimale Filmempfehlungen für höhere Verweildauer |

| Amazon | Suchverlauf, Käufe, Warenkorbaktivitäten | Relevante Produktvorschläge zur Steigerung des Umsatzes |

| Spotify | Gehörte Lieder, Skip-Rate, Playlist-Erstellung | Personalisierte Playlists und Künstlerempfehlungen |

| Likes, Kommentare, Verweildauer bei Posts | Erhöhte Nutzerengagement und Werbeeffektivität |

Diese Empfehlungssysteme schaffen einen unsichtbaren Überwachungsmechanismus. Die KI im Alltag baut ein präzises Bild Ihrer Persönlichkeit auf. Jede Interaktion wird verwertet.

Das Verständnis dieser Prozesse ist wichtig. Es hilft Ihnen, über Ihre digitale Privatsphäre informierte Entscheidungen zu treffen. Der Komfort dieser Systeme hat seinen Preis: Ihre persönlichen Informationen.

Künstliche Intelligenz in der Bildung: Chancen und Risiken

KI in der Bildung verändert, wie wir lernen und unterrichten. Es bietet neue Wege für personalisiertes Lernen. Doch es gibt auch Herausforderungen, die wir gemeinsam betrachten.

Personalisiertes Lernen wird durch KI-Systeme möglich. Diese Systeme analysieren den Lernfortschritt der Schüler. Sie erkennen Wissenslücken und passen den Unterricht an.

Die ChatGPT-Debatte in Schulen und Universitäten

ChatGPT und ähnliche KI-Modelle stellen Fragen in Schulen und Universitäten. Lehrkräfte sind besorgt um akademische Integrität und Plagiate. Schüler nutzen die Tools, um Hausaufgaben schnell zu machen.

Es fehlen klare Regelungen und Kontrollmechanismen.

Viele Bildungseinrichtungen wissen nicht, wie sie mit dieser Realität umgehen sollen:

- ChatGPT-Texte sind schwer von echten Schülerarbeiten zu unterscheiden

- Einige Schulen verbieten die Tools komplett

- Andere versuchen, sie pädagogisch einzubinden

- Lehrkräfte benötigen Fortbildungen zur kritischen Bewertung

Datenerfassung und das Risiko der Bildungsungleichheit

KI-Systeme sammeln Daten über Schüler. Sie erfassen kognitive Fähigkeiten und Lerngeschwindigkeit. Diese Informationen ermöglichen personalisiertes Lernen, werfen aber Datenschutzfragen auf.

Die größte Bedrohung ist die Bildungsungleichheit. Schüler ohne Zugang zu Computern bleiben zurück. Sie profitieren nicht von den Chancen, die KI bietet:

| Aspekt | Schüler mit Zugang | Schüler ohne Zugang |

|---|---|---|

| Personalisiertes Lernen | Individuelle Lernpfade, angepasstes Tempo | Standardunterricht für alle |

| Lernunterstützung | KI-Tutoren 24/7 verfügbar | Abhängig von Lehrkraft und Familie |

| Datenbasierte Förderung | Gezielte Unterstützung bei Schwächen | Weniger individuelle Rückmeldung |

| Vorbereitung auf digitale Zukunft | Frühe digitale Kompetenzen | Spätere oder unzureichende Entwicklung |

Länder mit besserer technischer Ausstattung gewinnen Vorteile. Ihre Schüler erlangen schneller Kompetenzen. Länder mit schlechterer Infrastruktur fallen zurück.

Chancen verantwortungsvoll nutzen

Als Führungskraft oder Bildungsprofessional sollten Sie folgende Schritte in Betracht ziehen:

- Klare Richtlinien für ChatGPT und KI-Tools in Ihrer Einrichtung entwickeln

- Lehrkräfte in kritischer Bewertung von KI-generierten Inhalten schulen

- Infrastruktur ausbauen, um Bildungsungleichheit zu verringern

- Datenschutzstandards etablieren und kommunizieren

- Schüler zu ethischem Umgang mit KI befähigen

KI in der Bildung bietet großes Potenzial. Personalisiertes Lernen wird bald Standard sein. Aber nur, wenn wir Risiken erkennen und aktiv gestalten, profitieren alle Schüler. Die Zeit, diese Verantwortung zu übernehmen, ist jetzt.

KI am Arbeitsplatz: Effizienz oder Jobverlust?

Künstliche Intelligenz verändert die Arbeitswelt. Sie bringt große Effizienz, aber auch Fragen zur Zukunft der Jobs. Als Führungskraft müssen Sie verstehen, wie KI funktioniert und Ihre Verantwortung.

Automatisierung monotoner Aufgaben

Intelligente Systeme sind perfekt für Routinearbeiten. Sie übernehmen heute viele Aufgaben in Unternehmen:

- Dateneingabe und Datenverarbeitung

- Rechnungsprüfung und Buchhaltung

- Terminvereinbarungen und Ressourcenplanung

- E-Mail-Sortierung und Dokumentenverwaltung

Chatbots und Kundensupport-Systeme beantworten Anfragen rund um die Uhr. Das spart Zeit und Geld. Aber Menschliche Fähigkeiten bleiben unverzichtbar. Kreativität, Empathie und Urteilsvermögen können Maschinen nicht ersetzen.

Das Verständnis von Machine-Learning und Deep-Learning-Technologien hilft, KI richtig einzusetzen.

Datenschutz bei KI-gestützten Personalprozessen

KI Recruiting verändert die Personalauswahl. Systeme analysieren Lebensläufe und erstellen detaillierte Profile. Das ist effizient, birgt aber Risiken.

| Prozessschritt | Datenvolumen | Datenschutzrisiko |

|---|---|---|

| Lebenslauf-Analyse | Persönliche Daten, Berufserfahrung | Unbefugte Weitergabe möglich |

| Kandidaten-Filterung | Qualifikationen, Suchprofile | Diskriminierungspotenzial hoch |

| Persönlichkeitsbewertung | Psychologische Merkmale | Mangelnde Transparenz |

| Hintergrund-Screening | Online-Verhalten, Social-Media-Daten | Privatsphäre stark gefährdet |

Der Datenschutz bei KI ist ein großes Thema. Ihre Systeme verarbeiten viel Daten über Kandidaten. Die DSGVO fordert strikte Kontrollen:

- Transparente Algorithmen nutzen, die Bewerber verstehen

- Daten sparsam sammeln – nur was nötig ist

- Regelmäßige Audits machen, um Verzerrungen zu vermeiden

- Bewerberrechte schützen, einschließlich Einsichtsrecht

KI am Arbeitsplatz hat großes Potenzial. Es ist Ihre Aufgabe, Effizienz und Ethik zu vereinen. Investieren Sie in transparente Systeme und schaffen Sie eine Kultur, die Technologie unterstützt, nicht ersetzt.

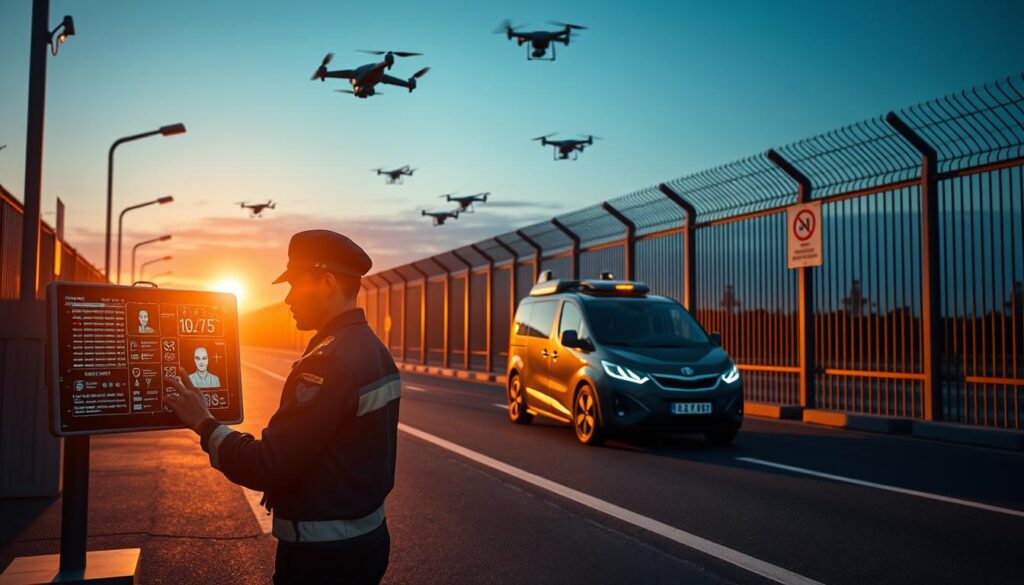

KI Überwachung an europäischen Grenzen

Die Grenzen Europas werden immer mehr durch KI geschützt. Moderne Grenzüberwachung kombiniert Technologie mit Sicherheit. Hier erfahren Sie, wie KI die europäischen Außengrenzen verändert und was das bedeutet.

Das Eurosur System ist eine der fortschrittlichsten Grenzüberwachungsinfrastrukturen. Es nutzt Satelliten, Drohnen und Sensoren, um die Grenzen zu überwachen. KI analysiert diese Daten in Echtzeit. Besonders im Mittelmeerraum wird diese Technologie eingesetzt.

An Landgrenzen und Flughäfen werden KI Grenzkontrollen durch Algorithmen durchgeführt. Diese erkennen Gesichter und Objekte automatisch. So können Personen schneller identifiziert werden.

Die EU-Grenzschutzagentur Frontex nutzt KI, um Migrationsbewegungen zu analysieren. Durch Predictive Analytics können Muster vorhergesagt werden. Das hilft bei der Planung und Steuerung von Ressourcen.

Technologische Systeme und ihre Anwendung

Verschiedene Technologien ermöglichen eine umfassende Grenzüberwachung:

- Satellitendaten erfassen große Flächen

- Drohnen liefern hochauflösende Bilder

- Sensornetzwerke erkennen Bewegungen automatisch

- KI-Algorithmen verarbeiten alle Daten schnell

Dieses Wissen hilft, die technischen Grundlagen zu verstehen. Es ermöglicht fundierte Diskussionen über digitale Sicherheit. Die Balance zwischen Schutz und Privatsphäre bleibt eine zentrale Herausforderung.

Biometrische Systeme und Identitätsprüfung durch KI

Biometrische Systeme nutzen künstliche Intelligenz, um Menschen zu identifizieren. Sie erfassen Daten wie Fingerabdrücke, Iris-Scans und Gesichtsbilder. An europäischen Grenzen sind sie wichtig für die Sicherheit.

In Deutschland setzt die Bundespolizei diese Technologien an Verkehrsknotenpunkten ein. Sie ermöglichen schnelle Überprüfungen. Doch Fragen zur Privatsphäre und Fairness bleiben.

Wir erklären, wie diese Technologien funktionieren. Und wir zeigen, welche Auswirkungen sie auf Reisende und Asylsuchende haben.

Gesichtserkennung und Fingerabdruckanalyse

Die Gesichtserkennung analysiert geometrische Merkmale im Gesicht. KI-Algorithmen erstellen digitale Signaturen. So kann man Menschen in Sekunden identifizieren.

Die Fingerabdruckanalyse erfasst einzigartige Muster auf Fingerkuppen. Eurodac speichert Fingerabdrücke von Asylbewerbern. So können Behörden schnell prüfen, ob jemand schon in der EU Asyl beantragt hat.

Automatisierte Systeme erkennen gefälschte Reisedokumente. Sie analysieren Sicherheitsmerkmale und Druckqualität.

| Biometrisches Merkmal | Erfassungsmethode | Hauptanwendung | Genauigkeit |

|---|---|---|---|

| Gesicht | Kamera mit KI-Analyse | Grenzkontrolle, Verkehrsknotenpunkte | 95–99 Prozent |

| Fingerabdruck | Digitale Scanner | Eurodac-Datenbank, Asylverfahren | 99–99,8 Prozent |

| Iris-Scan | Spezielle Kamera | Hochsicherheitsbereiche | 99,99 Prozent |

| Dokument | Automatisierte Prüfung | Fälschungserkennung | 97–98 Prozent |

Spracherkennungssoftware zur Herkunftsbestimmung

Eine umstrittene Anwendung nutzt Sprachanalyse zur Herkunftsbestimmung. Das BAMF testete Software, die Dialekte analysiert. Ziel ist es, die Herkunftsregion von Asylbewerbern zu bestimmen.

Diese Technologie verspricht Effizienz. Doch es gibt Probleme. Sprecher derselben Sprache können große regionale Unterschiede aufweisen. Menschen, die lange im Ausland lebten, sprechen anders als im Herkunftsland.

Spracherkennungssoftware schneidet bei solchen Variationen schlecht ab. Das führt zu Fehlern und falschen Entscheidungen über Asylverfahren.

- Dialekte innerhalb eines Landes sind oft sehr unterschiedlich

- Migration und Mehrsprachigkeit beeinflussen die Aussprache

- KI-Systeme erfassen kulturelle Nuancen nur begrenzt

- Diskriminierungsrisiken entstehen bei Minderheitensprachen

Sie verstehen damit die technischen Möglichkeiten dieser Systeme, lernen aber auch ihre erheblichen Grenzen kennen. Biometrische Systeme bieten neue Sicherheitschancen. Die praktische Umsetzung erfordert aber kritische Bewertung und ständige Verbesserung.

Automatisierte Asyl- und Visumsentscheidungen

Automatisierte Entscheidungen werden immer wichtiger, wenn Menschen Asyl oder ein Visum beantragen. Länder weltweit nutzen KI und Algorithmen, um viele Anträge schnell zu bearbeiten. Doch diese Technik birgt Risiken für Menschenrechte.

Kanada nutzt Algorithmen, um Visumanträge zu sortieren. Das Ziel ist, die Bearbeitungszeit zu verkürzen. In den USA analysieren Algorithmen umfassende Datenprofile von Antragstellern.

- Reiseverlauf und Aufenthaltshistorie

- Finanzielle Verhältnisse

- Aktivitäten in sozialen Medien

- Potenzielle Sicherheitsrisiken

Das deutsche BAMF verwendet maschinelle Übersetzungen bei Asylanhörungen. Automatisierte Dokumentenprüfung hilft bei der Bearbeitung. Diese Technologien sollen Ressourcen sparen und Verzögerungen verringern.

Algorithmische Entscheidungen bringen Herausforderungen mit sich. Systeme können bestimmte Gruppen benachteiligen. Datenfehler führen zu unfairen Ergebnissen.

| Land | Technologie | Einsatzbereich |

|---|---|---|

| Kanada | Automatisierte Vorsortierung | Visumantragsbearbeitung |

| USA | Risikobewertungsalgorithmen | Sicherheits- und Betrugsscreening |

| Deutschland (BAMF) | Maschinelle Übersetzung | Asylanhörungen und Dokumentenprüfung |

Das Recht auf individuelle Beurteilung ist ein Kernprinzip des Asylrechts. Standardisierte Algorithmen gefährden dieses Recht. Jeder Mensch verdient eine persönliche Prüfung seiner Situation.

Transparenz ist wichtig. Es muss klar sein, wie diese Systeme funktionieren und welche Daten sie nutzen. Kontrollmechanismen und Überprüfungsmöglichkeiten sind nötig, um Gerechtigkeit zu sichern. Als Führungskraft oder Entscheidungsträger:in müssen Sie ethische und rechtliche Fragen durchdringen und verantwortungsvoll handeln.

KI-Lügendetektoren: Wenn Algorithmen über Wahrheit entscheiden

Stellen Sie sich vor, Sie reisen nach Europa. Vor der Einreise müssen Sie online Fragen beantworten. Eine Webcam beobachtet Ihr Gesicht. Ein Algorithmus entscheidet, ob Sie lügen.

Dies ist keine Science-Fiction. Es war Realität mit dem iBorderCtrl-Projekt.

Ein KI Lügendetektor klingt verlockend für Sicherheitsbehörden. Aber die Technologie ist fragwürdig. Wir erklären, warum automatisierte Systeme zur Lügenerkennung problematisch sind.

Das iBorderCtrl-Projekt und seine Probleme

Die Europäische Union investierte 4,5 Millionen Euro in das iBorderCtrl-Projekt. Die Universität Hannover bekam 375.000 Euro. Das Ziel war ambitioniert: automatisierte Grenzkontrolle durch künstliche Intelligenz.

Das System arbeitete in zwei Schritten:

- Reisende beantworteten vor der Ankunft online Kontrollfragen

- Eine Webcam zeichnete ihre Gesichtsausdrücke während der Befragung auf

- Das Automatic Deception Detection System (ADDS) bewertete das Risiko automatisch

Das iBorderCtrl-Projekt wurde an ungarischen, griechischen und lettischen Grenzen getestet. Was die Entwickler nicht öffentlich machten: Das System war unzuverlässig.

Ein Test 2019 zeigte die Probleme deutlich. Eine Journalistin beantwortete alle 16 Fragen wahrheitsgemäß. Der Algorithmus sagte, sie habe bei vier Fragen gelogen. Die Entwickler gaben zu: Das System hatte erhebliche Fehlerquoten. Im Jahr 2022 wurde die Firma Silent Talker Limited aufgelöst.

Mikroexpressionen und ihre fragwürdige Interpretation

Die Technologie basiert auf einer umstrittenen Theorie. Die Software “Silent Talker” analysiert Mikroexpressionen – winzige Gesichtsbewegungen, die nur Bruchteile einer Sekunde dauern.

Das System untersucht:

- Augenöffnung und -bewegung

- Winkel des Kopfes und des Mundes

- Andere nonverbale Merkmale

Hier liegt das Hauptproblem: Wissenschaftler weltweit bezweifeln, dass Mikroexpressionen zuverlässig Lügen anzeigen. Menschen lügen nicht alle auf die gleiche Weise. Angst, Stress oder kulturelle Unterschiede beeinflussen Gesichtsausdrücke massiv.

Ein KI Lügendetektor, der auf dieser pseudowissenschaftlichen Basis arbeitet, diskriminiert systematisch. Menschen mit Angststörungen oder Autismus können fehlgedeutet werden. Das iBorderCtrl-Projekt zeigte: Algorithmen können nicht objektiv zwischen Wahrheit und Falschheit unterscheiden.

Ihr Wissen schützt Sie: Verstehen Sie die Grenzen dieser Technologien. Hinterfragen Sie automatisierte Entscheidungssysteme kritisch. Fordern Sie Transparenz ein, wenn KI über Ihre Rechte entscheidet.

Cybersecurity und KI: Schutz oder Gefahr?

KI Sicherheit bringt ein Paradoxon mit sich. Die Technologie schützt Unternehmen und Behörden, birgt aber große Risiken. Es ist wichtig, die Rolle von KI-Systemen zu verstehen.

Die KI Bedrohungserkennung arbeitet auf beeindruckendem Niveau. Moderne Kameras mit KI erkennen verdächtige Bewegungen. Sie können Waffen erkennen und das Sicherheitspersonal alarmieren.

KI als Schutzschild in der Cybersecurity

Im Cybersecurity-Bereich erkennt KI Bedrohungen schneller als alte Systeme:

- Analyse von Netzwerkverkehr und automatische Anomalieerkennung

- Blockade von Angriffen, bevor Schaden entsteht

- Echtzeit-Überwachung von Millionen Transaktionen

- Früherkennung von Geldwäsche und Identitätsdiebstahl

Banken wie die Deutsche Bank und Behörden nutzen diese Systeme. KI analysiert Transaktionen in Sekunden und erkennt verdächtige Aktivitäten.

Die dunkle Seite: KI als Angriffswaffe

Die gleiche KI-Technologie ermöglicht auch Cyberangriffe. Hacker nutzen KI für Angriffe und Phishing-Kampagnen. Deepfakes werden in großen Mengen produziert.

Autoritäre Staaten nutzen KI für Überwachung. KI ist neutral. Ihre Wirkung hängt von der Nutzung ab.

| KI-Anwendung | Schutzfunktion | Sicherheitsrisiko |

|---|---|---|

| Netzwerk-Monitoring | Erkennung von Cyberangriffen | Automatisierte Attacken auf Infrastruktur |

| Biometrische Systeme | Sichere Authentifizierung | Missbrauch für Massenüberwachung |

| Transaktionsanalyse | Betrugerkennung | Umgehung durch KI-generierte Muster |

| Video-Überwachung | Automatische Bedrohungserkennung | Verdachtslose Überwachung ganzer Bevölkerungen |

Verantwortungsvolle Nutzung von KI ist wichtig. KI Sicherheit ist kein absoluter Zustand. Überprüfen Sie regelmäßig, wie Sie KI einsetzen.

Wer entwickelt KI-Überwachungstechnologien?

Die Entwicklung von Überwachungssystemen ist ein Teamwerk. Staatliche Behörden, große Technologiekonzerne und spezialisierte KI Entwickler arbeiten zusammen. Diese Zusammenarbeit formt die Grenzsicherungsindustrie weltweit.

Die EU-Grenzschutzagentur Frontex fördert technologische Neuerungen. Mittel kommen aus Programmen wie Horizon 2020 und dem Fonds für innere Sicherheit. Deutschland investiert in biometrische Systeme und automatisierte Dokumentenanalyse.

Staatliche und privatwirtschaftliche Akteure

Regierungen und private Unternehmen arbeiten eng zusammen. Die USA, Kanada und Australien kooperieren mit spezialisierten Anbietern. Diese entwickeln maßgeschneiderte Lösungen für die Grenzüberwachung.

Wichtige Akteure in diesem Bereich sind:

- Palantir – spezialisiert auf Datenanalyse und Informationsintegration für Sicherheitsbehörden

- Anduril – entwickelt autonome Überwachungssysteme und Drohnen

- Elbit Systems – israelischer Rüstungskonzern mit umfangreichen Grenzsicherungslösungen

- Nationale Polizeibehörden und Grenzschutzbehörden

- Forschungsinstitute und Universitäten

Internationale Organisationen wie die Internationale Organisation für Migration (IOM) und das Flüchtlingshilfswerk der Vereinten Nationen (UNHCR) setzen KI-Anwendungen ein. Diese Tools unterstützen Registrierung, Überwachung und Verteilung von Hilfsgütern.

Der milliardenschwere Grenzsicherungskomplex

Die Grenzsicherungsindustrie ist ein wichtiger Wirtschaftszweig. Milliarden Euro fließen in neue Technologien. Diese Investitionen verbinden staatliche Sicherheitsinteressen mit privaten Gewinnzielen.

| Bereich | Finanzierungsquelle | Technologie-Fokus | Hauptakteure |

|---|---|---|---|

| EU-Grenzschutz | Horizon 2020, ISF-Fonds | Biometrische Systeme, Datenintegration | Frontex, nationale Behörden |

| Deutschland | BAMF, Bundespolizei-Budget | Sprachanalyse, Dokumentenerkennung | Regionale Sicherheitsbehörden |

| Nordamerika & Ozeanien | Nationale Sicherheitsbudgets | Autonome Überwachung, KI-Analytik | Palantir, Anduril, lokale Agenturen |

| Mittlerer Osten | Private und staatliche Mittel | Grenztechnologie, Drohnen | Elbit Systems, Regierungen |

EU-Forschungsförderung wird zur Industrieförderung. Unternehmen entwickeln Systeme mit öffentlichen Mitteln. Die Grenzsicherungsindustrie wächst dadurch ständig.

Private KI Entwickler profitieren von staatlichen Aufträgen. Diese Verflechtung schafft wirtschaftliche Anreize für ständige Technologieerweiterung.

Sie sollten diese Machtstrukturen verstehen. Als verantwortungsvolle Führungskraft benötigen Sie Durchblick in diesem Netzwerk. Kompetentes Wissen über Akteure und Finanzströme ermöglicht informierte Entscheidungen in Ihrer Organisation.

Diskriminierung und algorithmische Verzerrungen

KI-Systeme sind nicht neutral. Sie lernen aus Trainingsdaten, die oft Vorurteile enthalten. Wenn diese Daten Vorurteile widerspiegeln, verstärken KI-Systeme diese Muster. Das nennt man Bias KI.

Das Phänomen hat reale Konsequenzen für Menschen an den Grenzen Europas.

Bei Gesichtserkennungssystemen zeigt sich der Bias KI deutlich. Studien zeigen, dass solche Systeme dunkelhäutige Menschen weniger zuverlässig erkennen. Die Fehlerquote bei dunkler Hautfarbe kann um ein Vielfaches höher sein als bei hellhäutigen Personen.

Dies führt zu Fehlidentifikationen und unverhältnismäßigen Kontrollen.

KI-Verzerrungen betreffen nicht nur Gesichtserkennung. Risikobewertungsalgorithmen klassifizieren bestimmte Nationalitäten oder ethnische Gruppen als “risikoreich”. Ohne objektive Grundlage.

Diese Systeme verfestigen systemischen Rassismus technologisch. Sie machen Diskriminierung unsichtbar.

Wie algorithmische Diskriminierung entsteht

Algorithmen lernen von der Vergangenheit. Wenn Trainingsdaten ungleich behandelt wurden, lernen KI-Systeme diese Ungleichheit als normal.

- Unausgewogene Trainingsdaten mit überrepräsentierten Gruppen

- Historische Bias, die in Statistiken festgehalten sind

- Fehlende Überprüfung auf diskriminierende Effekte vor dem Einsatz

- Mangelnde Vielfalt bei der Entwicklung von KI-Systemen

Die Chancen und Risiken von Bias in KI-Systemen müssen Sie als Führungskraft beachten. Verstehen Sie, wie algorithmische Diskriminierung funktioniert, um sie zu erkennen.

Folgen für marginalisierte Gruppen

Menschen aus bestimmten Regionen erleben überproportionale Überwachung. Sie werden häufiger kontrolliert, überprüft und verdächtigt. Das allein aufgrund von KI-Entscheidungen, die auf verzerrten Daten basieren.

| Auswirkung | Betroffene Gruppen | Konsequenzen |

|---|---|---|

| Fehlerhafte Gesichtserkennung | Menschen mit dunklerer Hautfarbe | Falsche Identifikationen, unrechtmäßige Verhaftungen |

| Risikobewertung | Bestimmte Nationalitäten und ethnische Gruppen | Unverhältnismäßige Einreiseverweigerungen |

| Verhaltensprofiling | Marginalisierte Bevölkerungsgruppen | Erhöhte Kontrollhäufigkeit und verdächtigendes Verhalten von Grenzbeamten |

KI-Verzerrungen sind kein Zufall. Sie entstehen, wenn Entwickler die Perspektiven marginalisierter Gruppen nicht einbeziehen. Als Ihr Mentor zeigen wir Ihnen, wie Sie diese Systeme erkennen und ändern können.

Fordern Sie Transparenz ein. Hinterfragen Sie Algorithmen. Setzen Sie auf Vielfalt in Ihren Teams – das ist zukunftsorientierte Führung.

Rechtliche Rahmenbedingungen für KI-Einsatz

Die Regulierung von Künstlicher Intelligenz ist wichtig für moderne Gesellschaften. Es ist wichtig, zu wissen, welche Gesetze den Einsatz von KI-Systemen bestimmen. Ein gutes Verständnis dieser Gesetze hilft, KI-Technologien verantwortungsvoll zu nutzen und Risiken zu vermeiden.

Im Bereich der Überwachung und Grenzkontrolle gibt es viele Schutzbestimmungen.

EU-Datenschutz-Grundverordnung und KI-Gesetz

Die DSGVO und KI sind wichtig für den Datenschutz in Europa. Die Datenschutz-Grundverordnung regelt, wie mit biometrischen Daten umgegangen werden darf. Sie sichert Ihnen das Recht auf Auskunft und Löschung Ihrer Daten.

Das EU AI Act ergänzt diese Regelungen. Es klassifiziert KI-Systeme nach Risiko. Systeme mit hohem Risiko müssen strengere Anforderungen erfüllen. Manche Anwendungen sind sogar verboten, wie automatisierte Entscheidungen, die Menschenrechte verletzen.

- DSGVO: Schutz biometrischer Daten und Auskunftsrechte

- EU AI Act: Risikobasierte Regulierung

- EU-Grundrechtecharta: Garantie von Privatsphäre und Nichtdiskriminierung

Die Europäische Grundrechtecharta schützt Ihre Privatsphäre und verhindert Diskriminierung. Für Organisationen bedeutet das, dass KI-Systeme transparent und diskriminierungsfrei sein müssen. Mehr Informationen finden Sie in der umfassenden Übersicht zu rechtlichen Rahmenbedingungen.

Internationale Menschenrechtsstandards

Es gibt weltweit Menschenrechtsschutzbestimmungen. Der Internationale Pakt über bürgerliche und politische Rechte (ICCPR) schützt das Recht auf Privatsphäre und persönliche Freiheit.

| Regelwerk | Fokus | Relevanz für KI-Überwachung |

|---|---|---|

| ICCPR Artikel 17 | Schutz der Privatsphäre | Verbietet willkürliche Datenerfassung |

| ICCPR Artikel 9 | Freiheit und Sicherheit | Schützt vor automatisierter Überwachung |

| Genfer Flüchtlingskonvention 1951 | Asylrecht und Nicht-Zurückweisung | Fordert Prüfung durch Menschen, nicht nur Algorithmen |

Die Menschenrechte KI sind besonders für schutzbedürftige Gruppen wichtig. Die Genfer Flüchtlingskonvention verlangt faire Asylverfahren. Automatisierte Entscheidungen gefährden diesen Schutz.

Die Zivilgesellschaft fordert mehr Transparenz bei KI-Anwendungen in der Migrationspolitik. Sie haben ein Recht zu wissen, wie automatisierte Systeme über Ihre Rechte entscheiden. Dies ist ein grundlegendes Anliegen für Freiheiten und Sicherheit.

- Rechtlicher Rahmen KI verankert die Balance zwischen Innovation und Schutz

- Nationale Gesetze müssen internationale Standards beachten

- Transparenz und Kontrolle sind nicht optional, sondern erforderlich

Sie als Führungskraft oder Fachperson sollten diese Regelwerke nicht als Hindernis sehen. Sie sind wichtige Orientierungspunkte für verantwortungsvolle Innovation. Der Rechtlicher Rahmen KI schafft Vertrauen und Akzeptanz für neue Technologien. Organisationen, die diese Anforderungen erfüllen, gewinnen an Glaubwürdigkeit und Wettbewerbsfähigkeit.

Transparenz und demokratische Kontrolle von KI-Systemen

Viele KI-Systeme sind unsichtbar. Die Öffentlichkeit weiß oft nicht, wie sie entscheiden. Das fehlt an Transparenz, was das Vertrauen in den Staat schwächt.

Betroffene können nicht anfechten, wenn sie die Gründe nicht kennen. Das ist ein großes Problem.

Wer trägt die Verantwortung, wenn ein Algorithmus einen Fehler macht? Ist es der Staat, der das System einsetzt? Oder der private Auftragnehmer? Oder die Softwareentwickler? Diese Fragen zeigen ein großes Problem: Die Rechenschaftspflicht ist nicht geregelt.

Wissenschaftler und Menschenrechtsorganisationen fordern einen anderen Weg. Sie wollen gründliche Tests vor dem Einsatz. Sie fordern verpflichtende Transparenzberichte. Sie verlangen unabhängige Kontrollinstanzen. Die demokratische Kontrolle muss gestärkt werden.

Das UN-Hochkommissariat für Menschenrechte schlägt sogar vor, bestimmte Migrationstechnologien zu stoppen.

Die EU-Kommission verlangt ethische Überprüfungen für Forschungsprojekte. Unabhängige Experten bewerten diese Projekte. Sie prüfen, ob sie ethischen Grundsätzen entsprechen. Sie können Entscheidungen mit Hilfe von KI besser verstehen und bewerten.

Warum Transparenz wichtig ist

Transparenz KI-Systeme bedeutet Schutz für Bürger. Menschen müssen verstehen, wie Maschinen über sie entscheiden. Sie brauchen echte Chancen, sich zu wehren. Das ist ein Grundrecht in der Demokratie.

- Betroffene können Entscheidungen anfechten

- Experten können Fehler aufdecken

- Die Öffentlichkeit kann mitdiskutieren

- Institutionen werden verantwortlicher

Lösungen für bessere Kontrolle

Es gibt konkrete Wege, um KI Kontrolle zu verbessern. Organisationen müssen handeln. Regierungen müssen klare Regeln schaffen. Unternehmen müssen offener arbeiten.

| Maßnahme | Nutzen | Verantwortliche |

|---|---|---|

| Transparenzberichte veröffentlichen | Öffentlichkeit versteht Algorithmen besser | Entwickler und Behörden |

| Unabhängige ethische Überprüfungen | Experten erkennen Risiken früh | Externe Gutachter |

| Beratungsgremien mit Bürgern | Menschen haben Mitspracherecht | Staat und Zivilgesellschaft |

| Regelmäßige Tests auf Diskriminierung | Verzerrungen werden gefunden | Wissenschaftler und Behörden |

| Klare Haftungsregeln | Rechenschaftspflicht ist definiert | Gesetzgeber |

Die demokratische Kontrolle von KI-Systemen ist keine Option. Sie ist eine Notwendigkeit. Sie schützen die Grundrechte aller Menschen. Sie stärken das Vertrauen in Institutionen. Sie führen zu besseren Entscheidungen. Sie müssen diese Entwicklung unterstützen. Die Zukunft hängt davon ab, dass wir Technologie menschlich gestalten.

Fazit

Die Zukunft der KI wird von neuen Systemen geprägt, die unsere Grenzen und Sicherheitsprozesse verändern. Das künftige EU-Einreise-/Ausreisesystem (EES) und ETIAS nutzen schon automatische Risikoanalysen. Es gibt Projekte zur Emotionserkennung und vorausschauenden Polizeiarbeit, obwohl Experten und Aktivisten viele Fragen haben.

KI-Systeme beeinflussen das Leben von Menschen in schwierigen Situationen. Menschen auf der Flucht, Reisende und Bürger spüren das täglich. Es ist wichtig, die menschlichen Kosten zu bedenken. Technologie darf nicht auf Kosten von Menschenrechten und Würde.

Um Machine Learning und Deep Learning richtig zu nutzen, braucht man ein tiefes Verständnis. KI und Gesellschaft sind eng verbunden. Wir brauchen klare Regeln, unabhängige Kontrolle und ein menschenzentriertes Design.

Jetzt können wir KI-Überwachungstechnologien besser bewerten. Wir können ihre Chancen nutzen und Risiken minimieren. Die Frage „Wo liegt die Grenze?” müssen wir als Gesellschaft beantworten. Wir brauchen Expertise, Verantwortungsbewusstsein und den Mut, unbequeme Fragen zu stellen.